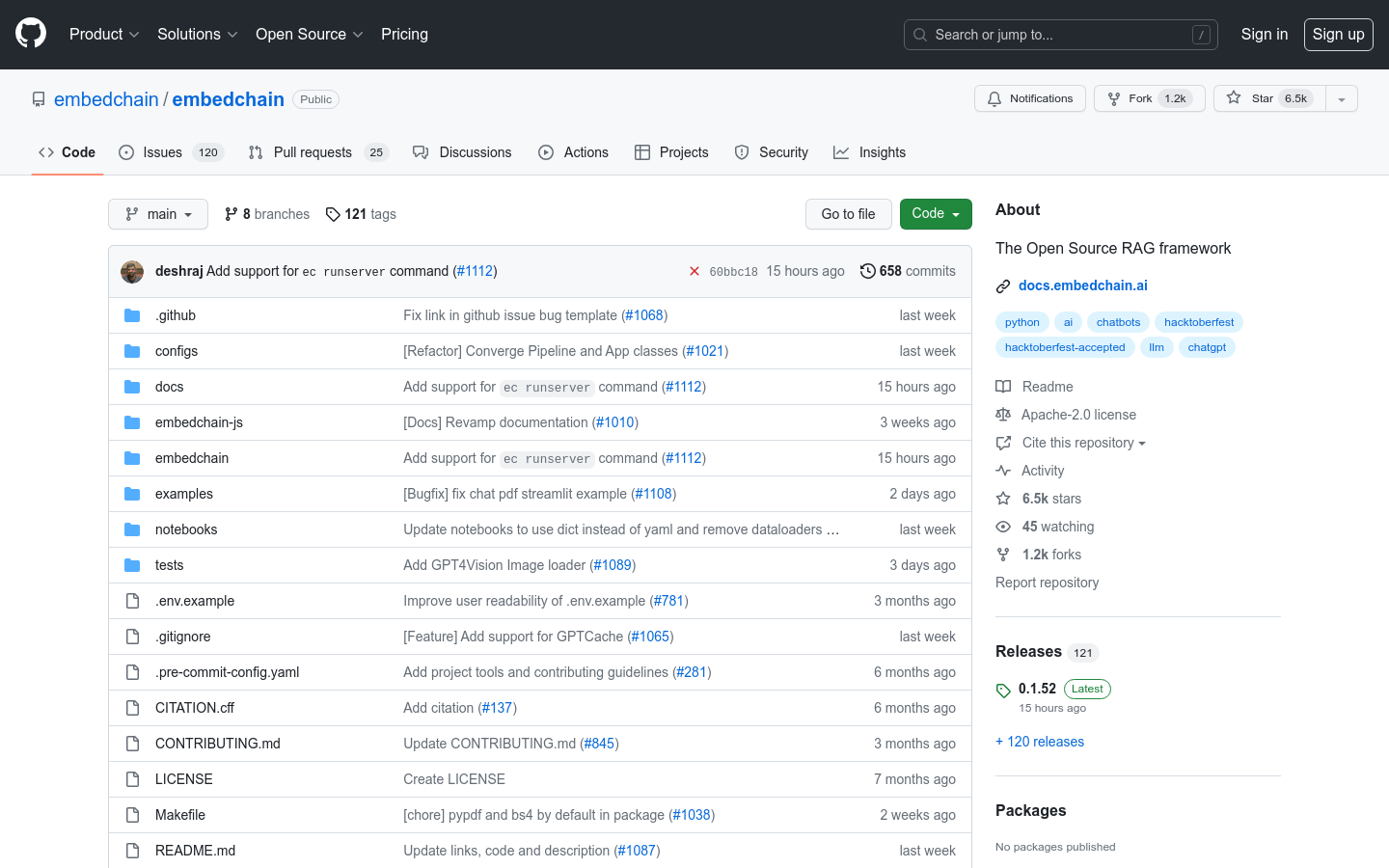

Embedchain 是一个开源的 RAG 框架,旨在简化 AI 应用的创建和部署。它以 “常规但可配置” 为设计原则,既适用于软件工程师,也适用于机器学习工程师。Embedchain 简化了 RAG 应用的创建过程,提供了一个无缝的管理各种非结构化数据的流程。它可以高效地将数据分成可管理的块,生成相关的嵌入,并将它们存储在矢量数据库中以实现优化的检索。借助各种多样的 API,它使用户能够提取上下文信息、找到精确的答案或参与交互式聊天对话,所有这些都根据他们自己的数据进行定制。

需求人群:

"用于创建和部署 AI 应用,处理非结构化数据,并提取上下文信息或进行交互式聊天对话。"

产品特色:

创建和部署 AI 应用

处理非结构化数据

生成嵌入并进行优化检索

提供多种 API,满足不同的需求

浏览量:203

最新流量情况

月访问量

4.93m

平均访问时长

00:06:29

每次访问页数

6.10

跳出率

36.08%

流量来源

直接访问

54.82%

自然搜索

31.76%

邮件

0.04%

外链引荐

11.31%

社交媒体

1.86%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.56%

德国

3.93%

印度

9.82%

俄罗斯

5.43%

美国

18.51%

易用、灵活、高效的开源大模型应用开发框架。

Agently是一个开源的大模型应用开发框架,旨在帮助开发者快速构建基于大语言模型的AI agent原生应用。它通过提供一系列工具和接口,简化了与大型语言模型的交互过程,使得开发者可以更专注于业务逻辑的实现。Agently框架支持多种模型,易于安装和配置,具有高度的灵活性和扩展性。

开源的RAG应用日志工具

RAG-logger是一个为检索增强生成(Retrieval-Augmented Generation, RAG)应用设计的开源日志工具。它是一个轻量级的、针对RAG特定日志需求的开源替代方案,专注于为RAG应用提供全面的日志记录功能,包括查询跟踪、检索结果记录、LLM交互记录以及逐步性能监控。它采用基于JSON的日志格式,支持每日日志组织、自动文件管理和元数据丰富化。RAG-logger以其开源、轻量级和专注于RAG应用的特性,为开发者提供了一个有效的工具来监控和分析RAG应用的性能。

开源的 RAG 框架

Embedchain 是一个开源的 RAG 框架,旨在简化 AI 应用的创建和部署。它以 “常规但可配置” 为设计原则,既适用于软件工程师,也适用于机器学习工程师。Embedchain 简化了 RAG 应用的创建过程,提供了一个无缝的管理各种非结构化数据的流程。它可以高效地将数据分成可管理的块,生成相关的嵌入,并将它们存储在矢量数据库中以实现优化的检索。借助各种多样的 API,它使用户能够提取上下文信息、找到精确的答案或参与交互式聊天对话,所有这些都根据他们自己的数据进行定制。

一个集成了Django、Llamaindex和Google Drive的RAG应用框架。

Omakase RAG Orchestrator是一个旨在解决构建RAG应用时遇到的挑战的项目,它通过提供一个综合的Web应用程序和API来封装大型语言模型(LLMs)及其包装器。该项目整合了Django、Llamaindex和Google Drive,以提高应用的可用性、可扩展性和数据及用户访问管理。

基于Qwen>=2.0的Agent框架和应用,支持函数调用、代码解释器、RAG和Chrome扩展。

Qwen-Agent是一个基于Qwen>=2.0构建的Agent框架,它具备指令遵循、工具使用、规划和记忆能力。该框架提供了如浏览器助手、代码解释器和自定义助手等示例应用。Qwen-Agent的主要优点包括其高度的可扩展性和模块化设计,允许开发者根据需要集成不同的工具和功能。产品背景信息显示,Qwen-Agent旨在为开发者提供一个强大的工具集,以构建和部署基于大型语言模型的应用程序。Qwen-Agent在GitHub上开源,允许社区贡献和协作。

开源本地RAG,集成ChatGPT和MCP能力

Minima是一个开源的、完全本地化的RAG(Retrieval-Augmented Generation)模型,具备与ChatGPT和MCP(Model Context Protocol)集成的能力。它支持三种模式:完全本地安装、通过ChatGPT查询本地文档以及使用Anthropic Claude查询本地文件。Minima的主要优点包括本地化处理数据,保护隐私,以及能够利用强大的语言模型来增强检索和生成任务。产品背景信息显示,Minima支持多种文件格式,并允许用户自定义配置以适应不同的使用场景。Minima是免费开源的,定位于需要本地化AI解决方案的开发者和企业。

一个为RAG(检索增强生成)AI助手设计的React组件,可快速集成到Next.js应用中。

该产品是一个React组件,专为RAG(检索增强生成)AI助手设计。它结合了Upstash Vector进行相似性搜索、Together AI作为LLM(大型语言模型)以及Vercel AI SDK用于流式响应。这种组件化设计使得开发者可以快速将RAG能力集成到Next.js应用中,极大地简化了开发流程,同时提供了高度的可定制性。其主要优点包括响应式设计、支持流式响应、持久化聊天历史以及支持暗黑/浅色模式等。该组件主要面向需要在Web应用中集成智能聊天功能的开发者,尤其是那些使用Next.js框架的团队。它通过简化集成过程,降低了开发成本,同时提供了强大的功能。

开源的RAG基础聊天工具,与文档对话。

kotaemon是一个开源的、基于RAG(Retrieval-Augmented Generation)模型的工具,旨在通过聊天界面与用户文档进行交互。它支持多种语言模型API提供商和本地语言模型,提供了一个干净、可定制的用户界面,适用于终端用户进行文档问答以及开发者构建自己的RAG问答流程。

掌握RAG技术,提升AI生成内容的准确性和相关性。

Retrieval-Augmented Generation (RAG) 是一种前沿技术,通过整合外部知识源来增强生成模型的能力,提高生成内容的质量和可靠性。LangChain是一个强大的框架,专为构建和部署稳健的语言模型应用而设计。本教程系列将提供全面的、分步骤的指南,帮助您使用LangChain实现RAG,从基础RAG流程的介绍开始,逐步深入到查询转换、文档嵌入、路由机制、查询构建、索引策略、检索技术以及生成阶段,最终将所有概念整合到一个实际场景中,展示RAG的强大和灵活性。

PIKE-RAG 是一种专注于领域知识和推理增强生成的模型。

PIKE-RAG 是微软开发的一种领域知识和推理增强生成模型,旨在通过知识提取、存储和推理逻辑增强大型语言模型(LLM)的能力。该模型通过多模块设计,能够处理复杂的多跳问答任务,并在工业制造、矿业和制药等领域显著提升了问答准确性。PIKE-RAG 的主要优点包括高效的知识提取能力、强大的多源信息整合能力和多步推理能力,使其在需要深度领域知识和复杂逻辑推理的场景中表现出色。

开源框架,加速大型视频扩散模型

FastVideo是一个开源框架,旨在加速大型视频扩散模型。它提供了FastHunyuan和FastMochi两种一致性蒸馏视频扩散模型,实现了8倍推理速度提升。FastVideo基于PCM(Phased-Consistency-Model)提供了首个开放的视频DiT蒸馏配方,支持对最先进的开放视频DiT模型进行蒸馏、微调和推理,包括Mochi和Hunyuan。此外,FastVideo还支持使用FSDP、序列并行和选择性激活检查点进行可扩展训练,以及使用LoRA、预计算潜在和预计算文本嵌入进行内存高效微调。FastVideo的开发正在进行中,技术高度实验性,未来计划包括增加更多蒸馏方法、支持更多模型以及代码更新。

开源的AI代理/RAG应用的监控与分析工具

Laminar是一个开源的监控和分析工具,专为AI代理和RAG应用设计,提供类似于DataDog和PostHog的功能。它基于OpenTelemetry进行自动监控,支持快速、可靠的数据收集和分析。Laminar使用Rust编写,具有高性能和可靠性,适用于大规模数据处理。它通过提供详细的追踪、事件和分析功能,帮助开发者和企业优化AI应用的性能和用户体验。

一个适合学习、使用、自主扩展的RAG系统。

Easy-RAG是一个检索增强生成(RAG)系统,它不仅适合学习者了解和掌握RAG技术,同时也便于开发者使用和进行自主扩展。该系统通过集成知识图谱提取解析工具、rerank重新排序机制以及faiss向量数据库等技术,提高了检索效率和生成质量。

开源AI编码代理框架,重写Claude Code架构,多代理编排、工具调用

Claw Code是一个开源的AI编码代理框架,它是对Claude Code架构的全新Python和Rust重写。该项目起源于2026年3月31日Claude Code源代码泄露事件,开发者Sigrid Jin开始进行无版权代码复制的重写工作。项目具有高模块化结构,Rust代码占比72.9%以实现高性能运行,Python代码占27.1%用于代理编排和大语言模型集成。其主要优点包括多代理编排可并行处理复杂任务、工具调用灵活且有细粒度权限控制、支持多种传输协议的MCP集成、具备高性能的查询引擎和多会话记忆系统等。价格方面,该项目是开源免费的,定位为为开发者提供一个强大、灵活且开源的AI编码辅助解决方案。

基于RAG(Retrieval-Augmented Generation)技术的智能对话系统

RAG Web UI 是一个基于 RAG 技术的智能对话系统,它结合了文档检索和大型语言模型,能够为企业和个人提供基于知识库的智能问答服务。该系统采用前后端分离架构,支持多种文档格式(如 PDF、DOCX、Markdown、Text)的智能管理,包括自动分块和向量化处理。其对话引擎支持多轮对话和引用标注,能够提供精准的知识检索和生成服务。该系统还支持高性能向量数据库(如 ChromaDB、Qdrant)的灵活切换,具有良好的扩展性和性能优化。作为一种开源项目,它为开发者提供了丰富的技术实现和应用场景,适合用于构建企业级知识管理系统或智能客服平台。

华为开源自研AI框架

华为开源自研AI框架MindSpore。自动微分、并行加持,一次训练,可多场景部署。支持端边云全场景的深度学习训练推理框架,主要应用于计算机视觉、自然语言处理等AI领域,面向数据科学家、算法工程师等人群。主要具备基于源码转换的通用自动微分、自动实现分布式并行训练、数据处理、以及图执行引擎等功能特性。借助自动微分,轻松训练神经网络。框架开源,华为培育AI开发生态。

一键式无服务器RAG平台

SciPhi是一个开源的端到端RAG平台,使构建、部署和优化系统变得简单。它提供直观的框架和抽象,可与LangChain等解决方案相比较。通过SciPhi,您可以轻松启动和扩展最好的RAG系统,并选择各种托管和远程提供商以满足您的需求。无论是自托管还是云部署选项都可用。

统一高效的RAG检索微调和推理框架

RAG-Retrieval是一个全链路的RAG检索微调和推理框架,支持多种RAG Reranker模型的推理,包括向量模型、迟交互式模型和交互式模型。它提供了一个轻量级的Python库,使得用户能够以统一的方式调用不同的RAG排序模型,简化了排序模型的使用和部署。

开源的深度研究工具,旨在通过开源框架复现类似Deep Research的功能

Open-source DeepResearch 是一个开源项目,旨在通过开源的框架和工具复现类似 OpenAI Deep Research 的功能。该项目基于 Hugging Face 平台,利用开源的大型语言模型(LLM)和代理框架,通过代码代理和工具调用实现复杂的多步推理和信息检索。其主要优点是开源、可定制性强,并且能够利用社区的力量不断改进。该项目的目标是让每个人都能在本地运行类似 DeepResearch 的智能代理,使用自己喜爱的模型,并且完全本地化和定制化。

基于RAG框架的可靠输入和可信输出系统

GoMate是一个基于Retrieval-Augmented Generation (RAG)框架的模型,专注于提供可靠输入和可信输出。它通过结合检索和生成技术,提高信息检索和文本生成的准确性和可靠性。GoMate适用于需要高效、准确信息处理的领域,如自然语言处理、知识问答等。

基于Linux环境快速部署开源大模型的教程

该项目是一个围绕开源大模型的全流程指导教程,包括环境配置、模型部署、高效微调等,简化开源大模型的使用和应用,让更多普通学习者能够使用开源大模型。项目面向对开源大模型感兴趣且想自主上手的学习者,提供详细的环境配置、模型部署和微调方法。

微信机器人框架,可定制、强大、快速、开源。

WechatFerry是一个微信机器人框架,旨在为用户提供一站式的微信操作解决方案。它通过集成WCF SDK客户端,支持消息监听、消息发送及群聊操作等功能。同时,它还提供了Agent库,帮助用户轻松实现历史消息处理、数据库操作和复杂业务逻辑。此外,WechatFerry还提供了与Wechaty兼容的免费PC Hook协议,以及Nuxt框架的集成工具包,使得开发者可以快速构建和调试微信机器人应用。

一个用于构建Retrieval-Augmented Generation (RAG)应用的开源项目。

bRAG-langchain是一个开源项目,专注于Retrieval-Augmented Generation (RAG)技术的研究与应用。RAG是一种结合了检索和生成的AI技术,通过检索相关文档并生成回答,为用户提供更准确、更丰富的信息。该项目提供了从基础到高级的RAG实现指南,帮助开发者快速上手并构建自己的RAG应用。其主要优点是开源、灵活且易于扩展,适合各种需要自然语言处理和信息检索的应用场景。

Cradle框架:用于控制计算机的多模态代理

Cradle框架旨在使基础模型能够通过与人类相同的通用接口(屏幕作为输入,键盘和鼠标操作作为输出)执行复杂的计算机任务。该框架在Red Dead Redemption II游戏中进行了案例研究,展示了其在复杂环境中的泛化和适应能力。

AI原生数据应用开发框架

DB-GPT是一个开源的AI原生数据应用开发框架,利用AWEL(Agentic Workflow Expression Language)和代理(agent)技术,简化了大型模型应用与数据的结合。它通过多模型管理、Text2SQL效果优化、RAG框架优化、多代理框架协作等技术能力,使企业和开发者能够以更少的代码构建定制化应用。DB-GPT在数据3.0时代,基于模型和数据库,为构建企业级报告分析和业务洞察提供了基础数据智能技术。

全面管理的AI搜索基础设施,支持RAG。

Ducky是一种全面管理的AI检索服务,专为那些需要快速准确结果的开发人员而设计。它支持语义搜索,包括检索增强生成(RAG),并且提供了简单明了的Python SDK,可以快速构建出色的搜索功能。

© 2026 AIbase 备案号:闽ICP备08105208号-14