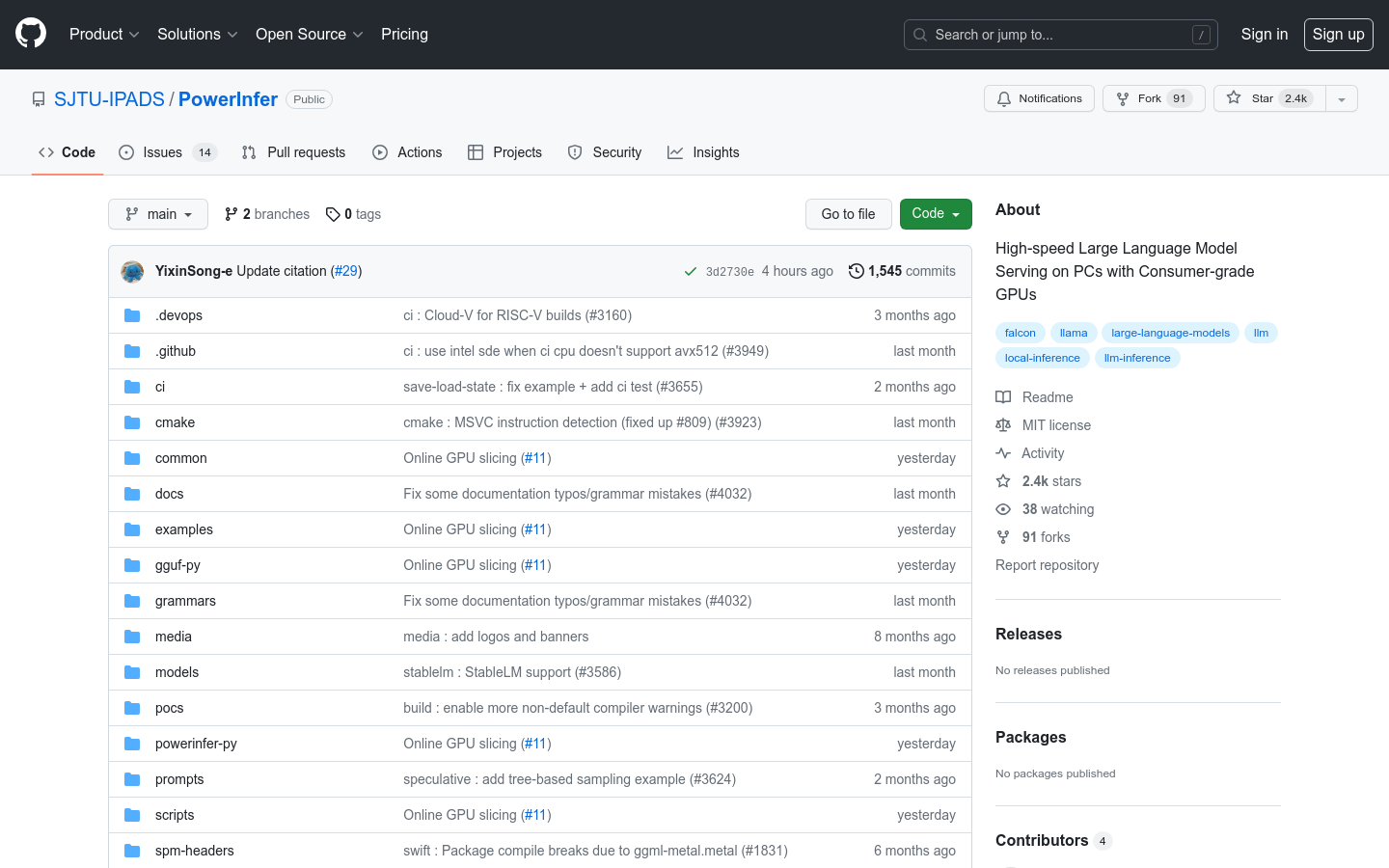

PowerInfer 是一个在个人电脑上利用消费级 GPU 进行高速大型语言模型推理的引擎。它利用 LLM 推理中的高局部性特点,通过预加载热激活的神经元到 GPU 上,从而显著降低了 GPU 内存需求和 CPU-GPU 数据传输。PowerInfer 还集成了自适应预测器和神经元感知的稀疏运算符,优化神经元激活和计算稀疏性的效率。它可以在单个 NVIDIA RTX 4090 GPU 上以平均每秒 13.20 个标记的生成速率进行推理,比顶级服务器级 A100 GPU 仅低 18%。同时保持模型准确性。

需求人群:

"PowerInfer 适用于在本地部署大型语言模型的高速推理。"

产品特色:

利用稀疏激活和 “热”/“冷” 神经元概念进行高效的 LLM 推理

无缝集成 CPU 和 GPU 的内存 / 计算能力,实现负载均衡和更快的处理速度

与常见的 ReLU 稀疏模型兼容

设计和深度优化用于本地部署在消费级硬件上,实现低延迟的 LLM 推理和服务

向后兼容性,支持与 llama.cpp 相同的模型权重进行推理,但不会有性能提升

浏览量:331

最新流量情况

月访问量

4.93m

平均访问时长

00:06:29

每次访问页数

6.10

跳出率

36.08%

流量来源

直接访问

54.82%

自然搜索

31.76%

邮件

0.04%

外链引荐

11.31%

社交媒体

1.86%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.56%

德国

3.93%

印度

9.82%

俄罗斯

5.43%

美国

18.51%

高速大型语言模型本地部署推理引擎

PowerInfer 是一个在个人电脑上利用消费级 GPU 进行高速大型语言模型推理的引擎。它利用 LLM 推理中的高局部性特点,通过预加载热激活的神经元到 GPU 上,从而显著降低了 GPU 内存需求和 CPU-GPU 数据传输。PowerInfer 还集成了自适应预测器和神经元感知的稀疏运算符,优化神经元激活和计算稀疏性的效率。它可以在单个 NVIDIA RTX 4090 GPU 上以平均每秒 13.20 个标记的生成速率进行推理,比顶级服务器级 A100 GPU 仅低 18%。同时保持模型准确性。

高效为大型语言模型提供服务

FP6-LLM是一种用于大型语言模型的全新支持方案,通过六位量化(FP6)有效地减小了模型大小,并在各种应用中始终保持模型质量。我们提出了TC-FPx,这是第一个完整的GPU内核设计方案,统一支持各种量化位宽的浮点权重。我们将TC-FPx内核集成到现有推理系统中,为量化的LLM推理提供了全新的端到端支持(称为FP6-LLM),实现了推理成本和模型质量之间更好的权衡。实验证明,FP6-LLM使得使用单个GPU进行LLaMA-70b推理成为可能,实现的规范化推理吞吐量比FP16基准高1.69倍至2.65倍。

高效的 Intel GPU 上的 LLM 推理解决方案

这是一种在 Intel GPU 上实现的高效的 LLM 推理解决方案。通过简化 LLM 解码器层、使用分段 KV 缓存策略和自定义的 Scaled-Dot-Product-Attention 内核,该解决方案在 Intel GPU 上相比标准的 HuggingFace 实现可实现高达 7 倍的令牌延迟降低和 27 倍的吞吐量提升。详细功能、优势、定价和定位等信息请参考官方网站。

网易有道开发的轻量级推理模型,可在单个GPU上部署,具备类似o1的推理能力。

Confucius-o1-14B是由网易有道团队开发的推理模型,基于Qwen2.5-14B-Instruct优化而成。它采用两阶段学习策略,能够自动生成推理链,并总结出逐步的问题解决过程。该模型主要面向教育领域,尤其适合K12数学问题的解答,能够帮助用户快速获取正确解题思路和答案。模型具备轻量化的特点,无需量化即可在单个GPU上部署,降低了使用门槛。其推理能力在内部评估中表现出色,为教育领域的AI应用提供了强大的技术支持。

双语开源数学推理大型语言模型。

InternLM-Math-Plus 是一个最新的双语(英文和中文)开源大型语言模型(LLM),专注于数学推理,具有解决、证明、验证和增强数学问题的能力。它在非正式数学推理(如思维链和代码解释)和正式数学推理(如LEAN 4翻译和证明)方面都有显著的性能提升。

帮助客户发现全球公有云厂商可用的GPU实例

GPU Finder是一个帮助客户发现全球公有云厂商可用的GPU实例的平台。通过GPU Finder,用户可以快速查找各大公有云厂商提供的GPU实例,并比较它们的价格、配置和性能等信息,从而选择最适合自己需求的GPU实例。无论是进行机器学习、深度学习、图像处理还是科学计算,GPU Finder都能帮助用户快速找到合适的GPU实例。平台上提供了丰富的过滤和排序功能,让用户可以根据自己的需求进行精准的筛选,从而节省时间和成本。无论是初学者还是有经验的开发者,都可以轻松使用GPU Finder来发现和租用合适的GPU实例。

FLUX模型的Cog推理引擎

Cog inference for flux models 是一个用于FLUX.1 [schnell] 和 FLUX.1 [dev] 模型的推理引擎,由Black Forest Labs开发。它支持编译与量化,敏感内容检查,以及img2img支持,旨在提高图像生成模型的性能和安全性。

先进的大型语言模型,具备推理和编程能力。

Mistral-Large-Instruct-2407是一个拥有123B参数的先进大型语言模型(LLM),具备最新的推理、知识和编程能力。它支持多语言,包括中文、英语、法语等十种语言,并且在80多种编程语言上受过训练,如Python、Java等。此外,它还具备代理中心能力和先进的数学及推理能力。

ComfyUI中集成的最新视频生成模型

Mochi是Genmo最新推出的开源视频生成模型,它在ComfyUI中经过优化,即使使用消费级GPU也能实现。Mochi以其高保真度动作和卓越的提示遵循性而著称,为ComfyUI社区带来了最先进的视频生成能力。Mochi模型在Apache 2.0许可下发布,这意味着开发者和创作者可以自由使用、修改和集成Mochi,而不受限制性许可的阻碍。Mochi能够在消费级GPU上运行,如4090,且在ComfyUI中支持多种注意力后端,使其能够适应小于24GB的VRAM。

一款高效的推理与聊天大语言模型。

Llama-3.1-Nemotron-Ultra-253B-v1 是一个基于 Llama-3.1-405B-Instruct 的大型语言模型,经过多阶段的后训练以提升推理和聊天能力。该模型支持高达 128K 的上下文长度,具备较好的准确性和效率平衡,适用于商业用途,旨在为开发者提供强大的 AI 助手功能。

医疗领域复杂推理的大型语言模型

HuatuoGPT-o1是一个专为医疗复杂推理设计的大语言模型,能够识别错误、探索替代策略并完善答案。该模型通过利用可验证的医疗问题和专门的医疗验证器,推进了复杂推理的发展。HuatuoGPT-o1的主要优点包括:使用验证器指导复杂推理轨迹的搜索,以微调大型语言模型;应用基于验证器奖励的强化学习(PPO)进一步提升复杂推理能力。HuatuoGPT-o1的开源模型、数据和代码,使其在医疗教育和研究领域具有重要价值。

前沿语言模型,具有先进的推理能力。

Grok-2是xAI的前沿语言模型,具有最先进的推理能力。此次发布包括Grok家族的两个成员:Grok-2和Grok-2 mini。这两个模型现在都在𝕏平台上发布给Grok用户。Grok-2是Grok-1.5的重要进步,具有聊天、编程和推理方面的前沿能力。同时,xAI引入了Grok-2 mini,一个小巧但功能强大的Grok-2的兄弟模型。Grok-2的早期版本已经在LMSYS排行榜上以“sus-column-r”的名字进行了测试。它在整体Elo得分方面超过了Claude 3.5 Sonnet和GPT-4-Turbo。

视觉语言模型,能够进行逐步推理

LLaVA-o1是北京大学元组团队开发的一个视觉语言模型,它能够进行自发的、系统的推理,类似于GPT-o1。该模型在六个具有挑战性的多模态基准测试中超越了其他模型,包括Gemini-1.5-pro、GPT-4o-mini和Llama-3.2-90B-Vision-Instruct。LLaVA-o1通过逐步推理解决问题,展示了其在视觉语言模型中的独特优势。

高性能浏览器内语言模型推理引擎

WebLLM是一个高性能的浏览器内语言模型推理引擎,利用WebGPU进行硬件加速,使得强大的语言模型操作可以直接在网页浏览器内执行,无需服务器端处理。这个项目旨在将大型语言模型(LLM)直接集成到客户端,从而实现成本降低、个性化增强和隐私保护。它支持多种模型,并与OpenAI API兼容,易于集成到项目中,支持实时交互和流式处理,是构建个性化AI助手的理想选择。

给视觉语言模型赋予空间推理能力

SpatialVLM是一个由谷歌DeepMind开发的视觉语言模型,能够对空间关系进行理解和推理。它通过大规模合成数据的训练,获得了像人类一样直观地进行定量空间推理的能力。这不仅提高了其在空间VQA任务上的表现,还为链式空间推理和机器人控制等下游任务打开了新的可能。

高性能知识图谱数据库与推理引擎

RDFox 是由牛津大学计算机科学系的三位教授基于数十年知识表示与推理(KRR)研究开发的规则驱动人工智能技术。其独特之处在于:1. 强大的AI推理能力:RDFox 能够像人类一样从数据中创建知识,基于事实进行推理,确保结果的准确性和可解释性。2. 高性能:作为唯一在内存中运行的知识图谱,RDFox 在基准测试中的表现远超其他图技术,能够处理数十亿三元组的复杂数据存储。3. 可扩展部署:RDFox 具有极高的效率和优化的占用空间,可以嵌入边缘和移动设备,作为 AI 应用的大脑独立运行。4. 企业级特性:包括高性能、高可用性、访问控制、可解释性、人类般的推理能力、数据导入和 API 支持等。5. 增量推理:RDFox 的推理功能在数据添加或删除时即时更新,不影响性能,无需重新加载。

微软最新的小型语言模型,专注于复杂推理

Phi-4是微软Phi系列小型语言模型的最新成员,拥有14B参数,擅长数学等复杂推理领域。Phi-4通过使用高质量的合成数据集、精选有机数据和后训练创新,在大小与质量之间取得了平衡。Phi-4体现了微软在小型语言模型(SLM)领域的技术进步,推动了AI技术的边界。Phi-4目前已在Azure AI Foundry上提供,并将在未来几周登陆Hugging Face平台。

视频序列理解的GPU实现模型

PPLLaVA是一个高效的视频大型语言模型,它结合了细粒度视觉提示对齐、用户指令的卷积风格池化的视觉令牌压缩以及CLIP上下文扩展。该模型在VideoMME、MVBench、VideoChatGPT Bench和VideoQA Bench等数据集上建立了新的最先进结果,仅使用1024个视觉令牌,吞吐量提高了8倍。

免费开源AI模型推理服务

Tost AI是一个免费、非盈利、开源的服务,它为最新的AI论文提供推理服务,使用非盈利GPU集群。Tost AI不存储任何推理数据,所有数据在12小时内过期。此外,Tost AI提供将数据发送到Discord频道的选项。每个账户每天提供100个免费钱包余额,如果希望每天获得1100个钱包余额,可以订阅GitHub赞助者或Patreon。Tost AI将演示的所有利润都发送给论文的第一作者,其预算由公司和个人赞助者支持。

大型语言模型是视觉推理协调器

Cola是一种使用语言模型(LM)来聚合2个或更多视觉-语言模型(VLM)输出的方法。我们的模型组装方法被称为Cola(COordinative LAnguage model or visual reasoning)。Cola在LM微调(称为Cola-FT)时效果最好。Cola在零样本或少样本上下文学习(称为Cola-Zero)时也很有效。除了性能提升外,Cola还对VLM的错误更具鲁棒性。我们展示了Cola可以应用于各种VLM(包括大型多模态模型如InstructBLIP)和7个数据集(VQA v2、OK-VQA、A-OKVQA、e-SNLI-VE、VSR、CLEVR、GQA),并且它始终提高了性能。

NVIDIA GPU上加速LLM推理的创新技术

ReDrafter是一种新颖的推测性解码方法,通过结合RNN草稿模型和动态树注意力机制,显著提高了大型语言模型(LLM)在NVIDIA GPU上的推理速度。这项技术通过加速LLM的token生成,减少了用户可能经历的延迟,同时减少了GPU的使用和能源消耗。ReDrafter由Apple机器学习研究团队开发,并与NVIDIA合作集成到NVIDIA TensorRT-LLM推理加速框架中,为使用NVIDIA GPU的机器学习开发者提供了更快的token生成能力。

医疗领域大型语言模型,用于高级医疗推理

HuatuoGPT-o1-7B是由FreedomIntelligence开发的医疗领域大型语言模型(LLM),专为高级医疗推理设计。该模型在提供最终回答之前,会生成复杂的思考过程,反映并完善其推理。HuatuoGPT-o1-7B支持中英文,能够处理复杂的医疗问题,并以'思考-回答'的格式输出结果,这对于提高医疗决策的透明度和可靠性至关重要。该模型基于Qwen2.5-7B,经过特殊训练以适应医疗领域的需求。

1位大型语言模型推理框架

BitNet是由微软开发的官方推理框架,专为1位大型语言模型(LLMs)设计。它提供了一套优化的核心,支持在CPU上进行快速且无损的1.58位模型推理(NPU和GPU支持即将推出)。BitNet在ARM CPU上实现了1.37倍到5.07倍的速度提升,能效比提高了55.4%到70.0%。在x86 CPU上,速度提升范围从2.37倍到6.17倍,能效比提高了71.9%到82.2%。此外,BitNet能够在单个CPU上运行100B参数的BitNet b1.58模型,实现接近人类阅读速度的推理速度,拓宽了在本地设备上运行大型语言模型的可能性。

PygmalionAI的大规模推理引擎

Aphrodite是PygmalionAI的官方后端引擎,旨在为PygmalionAI网站提供推理端点,并允许以极快的速度为大量用户提供Pygmalion模型服务。Aphrodite利用vLLM的分页注意力技术,实现了连续批处理、高效的键值管理、优化的CUDA内核等特性,支持多种量化方案,以提高推理性能。

开源代码语言模型,提升编程和数学推理能力。

DeepSeek-Coder-V2是一个开源的专家混合模型(Mixture-of-Experts, MoE),专为代码语言设计,其性能与GPT4-Turbo相当。它在代码特定任务上表现优异,同时在通用语言任务上保持了相当的性能。与DeepSeek-Coder-33B相比,V2版本在代码相关任务和推理能力上都有显著提升。此外,它支持的编程语言从86种扩展到了338种,上下文长度也从16K扩展到了128K。

开源小型语言模型,适用于企业级应用

H2O-Danube2-1.8B是H2O.ai最新发布的开源小型语言模型,专为离线应用和企业级应用设计,具有经济高效的接口和训练成本,易于嵌入到移动电话、无人机等边缘设备中。该模型在Hugging Face Open LLM Leaderboard的<2B范围内排名第一,提供高达200倍的查询成本节省,同时在文档处理上提供更好的准确性,成本降低高达100%。H2O.ai平台还提供了成本控制和灵活性,支持超过30种大型语言模型(Large Language Models, LLMs)的混合使用,包括专有和开源的LLMs。

高效长序列大型语言模型推理技术

Star-Attention是NVIDIA提出的一种新型块稀疏注意力机制,旨在提高基于Transformer的大型语言模型(LLM)在长序列上的推理效率。该技术通过两个阶段的操作显著提高了推理速度,同时保持了95-100%的准确率。它与大多数基于Transformer的LLM兼容,无需额外训练或微调即可直接使用,并且可以与其他优化方法如Flash Attention和KV缓存压缩技术结合使用,进一步提升性能。

小型语言模型用于推理和理解任务

Orca 2 是一个用于研究目的的助手,通过提供单轮响应来帮助推理和理解任务,如数据推理、阅读理解、数学问题解决和文本摘要。该模型特别擅长推理。我们公开发布 Orca 2,以促进在开发、评估和对齐更小的语言模型方面的进一步研究。

全球最快的AI推理服务提供商,部署模型速度无与伦比

General Compute是全球最快的推理服务提供商,专为推理而构建,采用专用ASIC芯片,而非传统的GPU。其主要优点包括:超高速推理,每秒可达1000个令牌,比其他方案快7倍;亚毫秒级的首次响应时间;高吞吐量;与OpenAI兼容的API,方便用户集成。产品背景基于对传统GPU在推理场景局限性的认识,传统GPU有70年的遗留架构,专为渲染像素设计,后用于训练,现在用于推理并非最优选择。而General Compute从底层开始为推理设计,具有更低的能耗和更高的效率。价格方面,提供200美元的免费额度供用户体验,具体付费方式需联系销售。其定位是为需要快速部署AI模型并进行高效推理的用户提供解决方案。

© 2026 AIbase 备案号:闽ICP备08105208号-14