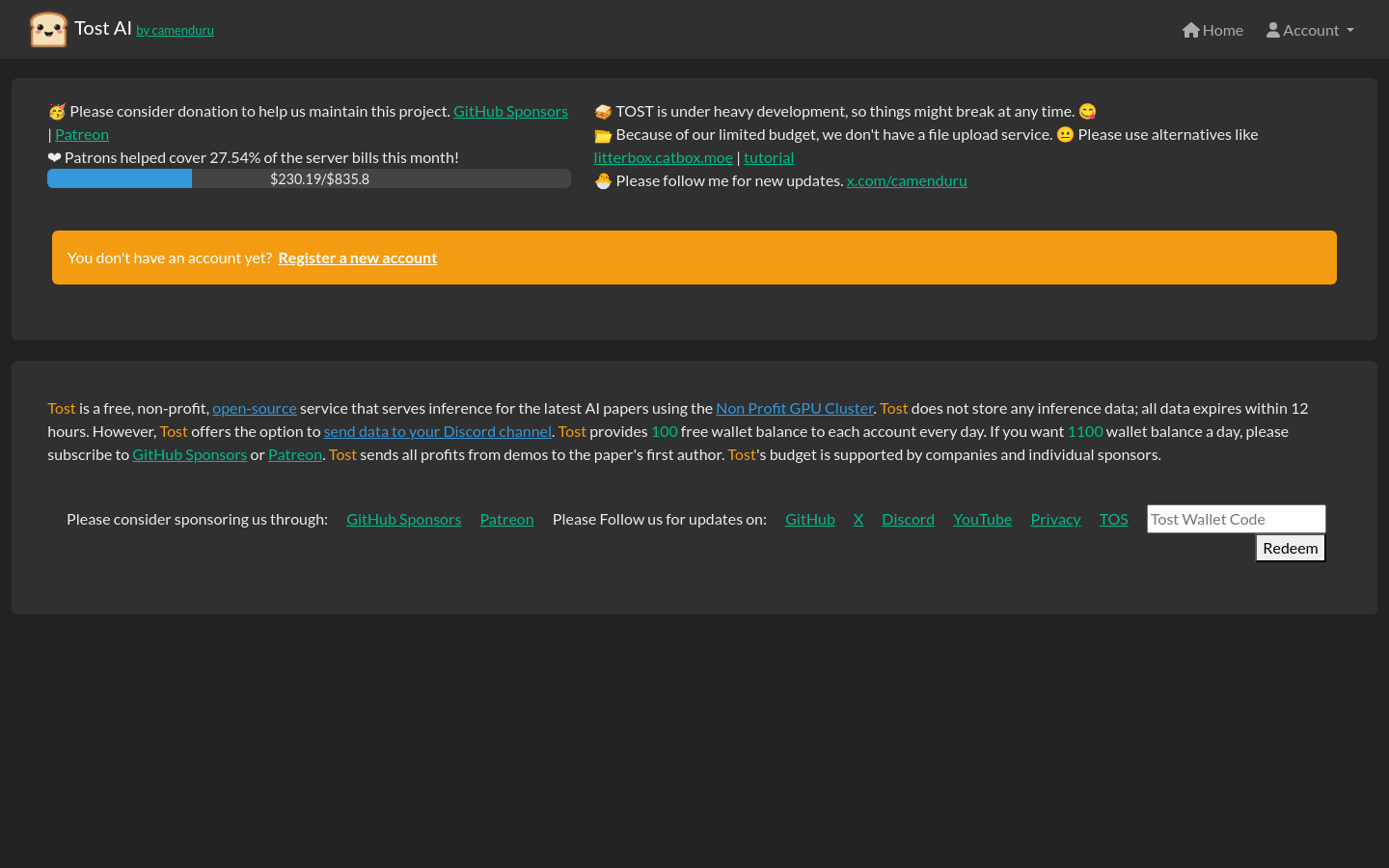

Tost AI是一个免费、非盈利、开源的服务,它为最新的AI论文提供推理服务,使用非盈利GPU集群。Tost AI不存储任何推理数据,所有数据在12小时内过期。此外,Tost AI提供将数据发送到Discord频道的选项。每个账户每天提供100个免费钱包余额,如果希望每天获得1100个钱包余额,可以订阅GitHub赞助者或Patreon。Tost AI将演示的所有利润都发送给论文的第一作者,其预算由公司和个人赞助者支持。

需求人群:

"Tost AI适合需要进行AI模型推理的研究人员和开发者,特别是那些希望快速测试最新AI论文模型的用户。它提供了一个免费且易于访问的平台,使得用户可以无需自己配置硬件即可进行复杂的AI计算。"

使用场景示例:

研究人员使用Tost AI测试最新的AI模型。

开发者利用Tost AI进行模型的快速原型设计。

教育工作者将Tost AI作为教学工具,向学生展示AI技术的应用。

产品特色:

提供AI模型的推理服务

使用非盈利GPU集群进行计算

不存储任何推理数据,保护用户隐私

提供数据发送到Discord频道的功能

每个账户每天提供100个免费钱包余额

支持赞助者获得更多钱包余额

使用教程:

1. 访问Tost AI网站并注册账户。

2. 选择您想要使用的AI模型。

3. 根据模型要求准备输入数据。

4. 将数据发送到Tost AI进行推理。

5. 接收推理结果,并根据需要将其发送到Discord频道。

6. 每天领取免费钱包余额,或通过赞助获得更多余额。

浏览量:77

最新流量情况

月访问量

3436

平均访问时长

00:00:06

每次访问页数

1.40

跳出率

47.84%

流量来源

直接访问

41.88%

自然搜索

23.69%

邮件

0.06%

外链引荐

17.82%

社交媒体

15.30%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

印度

43.35%

美国

56.65%

免费开源AI模型推理服务

Tost AI是一个免费、非盈利、开源的服务,它为最新的AI论文提供推理服务,使用非盈利GPU集群。Tost AI不存储任何推理数据,所有数据在12小时内过期。此外,Tost AI提供将数据发送到Discord频道的选项。每个账户每天提供100个免费钱包余额,如果希望每天获得1100个钱包余额,可以订阅GitHub赞助者或Patreon。Tost AI将演示的所有利润都发送给论文的第一作者,其预算由公司和个人赞助者支持。

LG AI 推出的开源推理 AI 模型,具备卓越的推理能力。

EXAONE Deep 是 LG AI Research 推出的先进推理 AI 模型,标志着韩国在全球 AI 市场中的竞争力。它具备 32 亿参数,表现卓越,尤其在数学和科学问题解决方面展现出色。该模型的发布使得 LG 在 AI 领域迈入了自主决策的时代,其开源特性使得更多开发者能够利用这一技术进行研究与开发。EXAONE Deep 的轻量级和在设备上的模型设计使得其适用于多个行业,包括教育、科学研究、编程等。

双语开源数学推理大型语言模型。

InternLM-Math-Plus 是一个最新的双语(英文和中文)开源大型语言模型(LLM),专注于数学推理,具有解决、证明、验证和增强数学问题的能力。它在非正式数学推理(如思维链和代码解释)和正式数学推理(如LEAN 4翻译和证明)方面都有显著的性能提升。

小米首个推理大模型MiMo开源,专为推理任务设计,性能卓越。

Xiaomi MiMo是小米公司开源的首个推理大模型,专为推理任务设计,具备卓越的数学推理和代码生成能力。该模型在数学推理(AIME 24-25)和代码竞赛(LiveCodeBench v5)公开测评集上表现出色,仅用7B的参数规模就超越了OpenAI的o1-mini和阿里Qwen的QwQ-32B-Preview等更大规模的模型。MiMo通过预训练和后训练阶段的多层面创新,包括数据挖掘、训练策略和强化学习算法等,显著提升了推理能力。该模型的开源为研究人员和开发者提供了强大的工具,推动了人工智能在推理领域的进一步发展。

数学推理LLM

MathCoder是一款基于开源语言模型的数学推理工具,通过fine-tune模型和生成高质量的数据集,实现了自然语言、代码和执行结果的交替,提高了数学推理能力。MathCoder模型在MATH和GSM8K数据集上取得了最新的最高分数,远远超过其他开源替代品。MathCoder模型不仅在GSM8K和MATH上超过了ChatGPT-3.5和PaLM-2,还在竞赛级别的MATH数据集上超过了GPT-4。

DeepSeek-R1-Distill-Qwen-7B 是一个开源的推理模型,专注于数学、代码和推理任务。

DeepSeek-R1-Distill-Qwen-7B 是一个经过强化学习优化的推理模型,基于 Qwen-7B 进行了蒸馏优化。它在数学、代码和推理任务上表现出色,能够生成高质量的推理链和解决方案。该模型通过大规模强化学习和数据蒸馏技术,显著提升了推理能力和效率,适用于需要复杂推理和逻辑分析的场景。

开源代码语言模型,提升编程和数学推理能力。

DeepSeek-Coder-V2是一个开源的专家混合模型(Mixture-of-Experts, MoE),专为代码语言设计,其性能与GPT4-Turbo相当。它在代码特定任务上表现优异,同时在通用语言任务上保持了相当的性能。与DeepSeek-Coder-33B相比,V2版本在代码相关任务和推理能力上都有显著提升。此外,它支持的编程语言从86种扩展到了338种,上下文长度也从16K扩展到了128K。

基于Linux环境快速部署开源大模型的教程

该项目是一个围绕开源大模型的全流程指导教程,包括环境配置、模型部署、高效微调等,简化开源大模型的使用和应用,让更多普通学习者能够使用开源大模型。项目面向对开源大模型感兴趣且想自主上手的学习者,提供详细的环境配置、模型部署和微调方法。

昆仑万维开源的高性能数学代码推理模型,性能卓越

Skywork-OR1是由昆仑万维天工团队开发的高性能数学代码推理模型。该模型系列在同等参数规模下实现了业界领先的推理性能,突破了大模型在逻辑理解与复杂任务求解方面的能力瓶颈。Skywork-OR1系列包括Skywork-OR1-Math-7B、Skywork-OR1-7B-Preview和Skywork-OR1-32B-Preview三款模型,分别聚焦数学推理、通用推理和高性能推理任务。此次开源不仅涵盖模型权重,还全面开放了训练数据集和完整训练代码,所有资源均已上传至GitHub和Huggingface平台,为AI社区提供了完全可复现的实践参考。这种全方位的开源策略有助于推动整个AI社区在推理能力研究上的共同进步。

OpenThinker-32B 是一款强大的开源推理模型,专为提升开放数据推理能力而设计。

OpenThinker-32B 是由 Open Thoughts 团队开发的一款开源推理模型。它通过扩展数据规模、验证推理路径和扩展模型大小来实现强大的推理能力。该模型在数学、代码和科学等推理基准测试中表现卓越,超越了现有的开放数据推理模型。其主要优点包括开源数据、高性能和可扩展性。该模型基于 Qwen2.5-32B-Instruct 进行微调,并在大规模数据集上训练,旨在为研究人员和开发者提供强大的推理工具。

释放超级推理能力,提升AIME & MATH基准测试性能。

DeepSeek-R1-Lite-Preview是一款专注于提升推理能力的AI模型,它在AIME和MATH基准测试中展现了出色的性能。该模型具备实时透明的思考过程,并且计划推出开源模型和API。DeepSeek-R1-Lite-Preview的推理能力随着思考长度的增加而稳步提升,显示出更好的性能。产品背景信息显示,DeepSeek-R1-Lite-Preview是DeepSeek公司推出的最新产品,旨在通过人工智能技术提升用户的工作效率和问题解决能力。目前,产品提供免费试用,具体的定价和定位信息尚未公布。

Stability AI 生成模型是一个开源的生成模型库。

Stability AI 生成模型是一个开源的生成模型库,提供了各种生成模型的训练、推理和应用功能。该库支持各种生成模型的训练,包括基于 PyTorch Lightning 的训练,提供了丰富的配置选项和模块化的设计。用户可以使用该库进行生成模型的训练,并通过提供的模型进行推理和应用。该库还提供了示例训练配置和数据处理的功能,方便用户进行快速上手和定制。

DeepSeek-V3/R1 推理系统是一个高性能的分布式推理架构,专为大规模 AI 模型优化设计。

DeepSeek-V3/R1 推理系统是 DeepSeek 团队开发的高性能推理架构,旨在优化大规模稀疏模型的推理效率。它通过跨节点专家并行(EP)技术,显著提升 GPU 矩阵计算效率,降低延迟。该系统采用双批量重叠策略和多级负载均衡机制,确保在大规模分布式环境中高效运行。其主要优点包括高吞吐量、低延迟和优化的资源利用率,适用于高性能计算和 AI 推理场景。

一个专注于整理最佳开源推理数据集的社区项目

Open Thoughts 是一个由 Bespoke Labs 和 DataComp 社区主导的项目,旨在整理高质量的开源推理数据集,用于训练先进的小模型。该项目汇集了来自斯坦福大学、加州大学伯克利分校、华盛顿大学等多所高校和研究机构的研究人员与工程师,致力于通过优质数据集推动推理模型的发展。其背景是当前推理模型在数学和代码推理等领域的应用需求日益增长,而高质量的数据集是提升模型性能的关键。该项目目前免费开放,主要面向研究人员、开发者以及对推理模型感兴趣的专业人士,其数据集和工具的开源性使其成为推动人工智能教育和研究的重要资源。

AI即时推理解决方案,速度领先世界。

Cerebras Inference是Cerebras公司推出的AI推理平台,提供20倍于GPU的速度和1/5的成本。它利用Cerebras的高性能计算技术,为大规模语言模型、高性能计算等提供快速、高效的推理服务。该平台支持多种AI模型,包括医疗、能源、政府和金融服务等行业应用,具有开放源代码的特性,允许用户训练自己的基础模型或微调开源模型。

去中心化的浏览器内AI推理网络

Rakis是一个完全在浏览器中运行的去中心化推理网络。它利用区块链技术,允许节点之间进行AI模型的推理请求和结果共享,无需服务器即可实现AI模型的分布式执行。Rakis通过使用浏览器作为节点,支持WebGPU兼容平台,使得普通用户也能参与到AI模型的推理过程中。项目开源,强调透明度和可验证性,旨在解决去中心化AI推理中的确定性、可扩展性和安全性问题。

InternLM3-8B-Instruct是一个开源的80亿参数指令模型,用于通用用途和高级推理。

InternLM3-8B-Instruct是InternLM团队开发的大型语言模型,具有卓越的推理能力和知识密集型任务处理能力。该模型在仅使用4万亿高质量词元进行训练的情况下,实现了比同级别模型低75%以上的训练成本,同时在多个基准测试中超越了Llama3.1-8B和Qwen2.5-7B等模型。它支持深度思考模式,能够通过长思维链解决复杂的推理任务,同时也具备流畅的用户交互能力。该模型基于Apache-2.0许可证开源,适用于需要高效推理和知识处理的各种应用场景。

为数据中心打造的高效AI推理平台

d-Matrix是一家专注于AI推理技术的公司,其旗舰产品Corsair™是为数据中心设计的AI推理平台,能够提供极高的推理速度和极低的延迟。d-Matrix通过硬件软件协同设计,优化了Generative AI推理性能,推动了AI技术在数据中心的应用,使得大规模AI推理变得更加高效和可持续。

AI模型部署和推理优化的专家

Neural Magic是一家专注于AI模型优化和部署的公司,提供领先的企业级推理解决方案,以最大化性能和提高硬件效率。公司的产品支持在GPU和CPU基础设施上运行领先的开源大型语言模型(LLMs),帮助企业在云、私有数据中心或边缘环境中安全、高效地部署AI模型。Neural Magic的产品背景信息强调了其在机器学习模型优化方面的专业知识,以及与科研机构合作开发的创新LLM压缩技术,如GPTQ和SparseGPT。产品价格和定位方面,Neural Magic提供了免费试用和付费服务,旨在帮助企业降低成本、提高效率,并保持数据隐私和安全。

一站式AI数字人系统,支持视频合成、声音合成、声音克隆。

AIGCPanel是一个简单易用的一站式AI数字人系统,小白也可使用。支持视频合成、声音合成、声音克隆,简化本地模型管理、一键导入和使用AI模型。产品背景信息显示,AIGCPanel旨在通过集成多种AI功能,提升数字人素材管理的效率,降低技术门槛,使非专业人士也能轻松管理和使用AI数字人。产品基于AGPL-3.0开源,完全免费,可以直接使用。

开源大语言模型,匹配专有强大能力。

Open O1是一个开源项目,旨在通过开源创新,匹配专有的强大O1模型能力。该项目通过策划一组O1风格的思考数据,用于训练LLaMA和Qwen模型,赋予了这些较小模型更强大的长期推理和解决问题的能力。随着Open O1项目的推进,我们将继续推动大型语言模型的可能性,我们的愿景是创建一个不仅能够实现类似O1的性能,而且在测试时扩展性方面也处于领先地位的模型,使高级AI能力为所有人所用。通过社区驱动的开发和对道德实践的承诺,Open O1将成为AI进步的基石,确保技术的未来发展是开放的,并对所有人有益。

本地AI管理、验证和推理工具

The Local AI Playground是一个本地AI管理、验证和推理工具,可以在离线环境中进行AI实验,无需GPU。该产品是一个本地应用程序,旨在简化整个过程。具有免费开源的特点。

开源语言代理,解决复杂多步推理任务。

Husky-v1是一个开源的语言代理模型,专注于解决包含数值、表格和基于知识的复杂多步推理任务。它使用工具使用、代码生成器、查询生成器和数学推理器等专家模型来执行推理。此模型支持CUDA 11.8,需要下载相应的模型文件,并可以通过优化的推理过程并行运行所有专家模型。

使用开源模型Llama-3.1 70b在Groq上创建类似o1的推理链

g1是一个实验性的项目,旨在通过使用Llama-3.1 70b模型在Groq硬件上创建类似于OpenAI的o1模型的推理链。这个项目展示了仅通过提示技术,就可以显著提高现有开源模型在逻辑问题解决上的能力,而无需进行复杂的训练。g1通过可视化的推理步骤,帮助模型在逻辑问题上实现更准确的推理,这对于提高人工智能的逻辑推理能力具有重要意义。

开源的视觉语言模型,可在多种设备上运行。

Moondream AI是一个开源的视觉语言模型,具有强大的多模态处理能力。它支持多种量化格式,如fp16、int8、int4,能够在服务器、PC、移动设备等多种目标设备上进行GPU和CPU优化推理。其主要优点包括快速、高效、易于部署,且采用Apache 2.0许可证,允许用户自由使用和修改。Moondream AI的定位是为开发者提供一个灵活、高效的人工智能解决方案,适用于需要视觉和语言处理能力的各种应用场景。

一款在推理和编程基准测试中表现与o1-preview相当的推理模型。

Sky-T1-32B-Preview是由加州大学伯克利分校的NovaSky团队开发的推理模型。该模型在流行的推理和编程基准测试中表现出色,与o1-preview相当,且训练成本不到450美元,展示了以低成本高效复制高级推理能力的可能性。该模型完全开源,包括数据、代码和模型权重,旨在推动学术界和开源社区的发展。其主要优点是低成本、高性能和开源,为研究人员和开发者提供了宝贵的资源。

医疗领域复杂推理的大型语言模型

HuatuoGPT-o1是一个专为医疗复杂推理设计的大语言模型,能够识别错误、探索替代策略并完善答案。该模型通过利用可验证的医疗问题和专门的医疗验证器,推进了复杂推理的发展。HuatuoGPT-o1的主要优点包括:使用验证器指导复杂推理轨迹的搜索,以微调大型语言模型;应用基于验证器奖励的强化学习(PPO)进一步提升复杂推理能力。HuatuoGPT-o1的开源模型、数据和代码,使其在医疗教育和研究领域具有重要价值。

全球最快的AI推理服务提供商,部署模型速度无与伦比

General Compute是全球最快的推理服务提供商,专为推理而构建,采用专用ASIC芯片,而非传统的GPU。其主要优点包括:超高速推理,每秒可达1000个令牌,比其他方案快7倍;亚毫秒级的首次响应时间;高吞吐量;与OpenAI兼容的API,方便用户集成。产品背景基于对传统GPU在推理场景局限性的认识,传统GPU有70年的遗留架构,专为渲染像素设计,后用于训练,现在用于推理并非最优选择。而General Compute从底层开始为推理设计,具有更低的能耗和更高的效率。价格方面,提供200美元的免费额度供用户体验,具体付费方式需联系销售。其定位是为需要快速部署AI模型并进行高效推理的用户提供解决方案。

© 2026 AIbase 备案号:闽ICP备08105208号-14