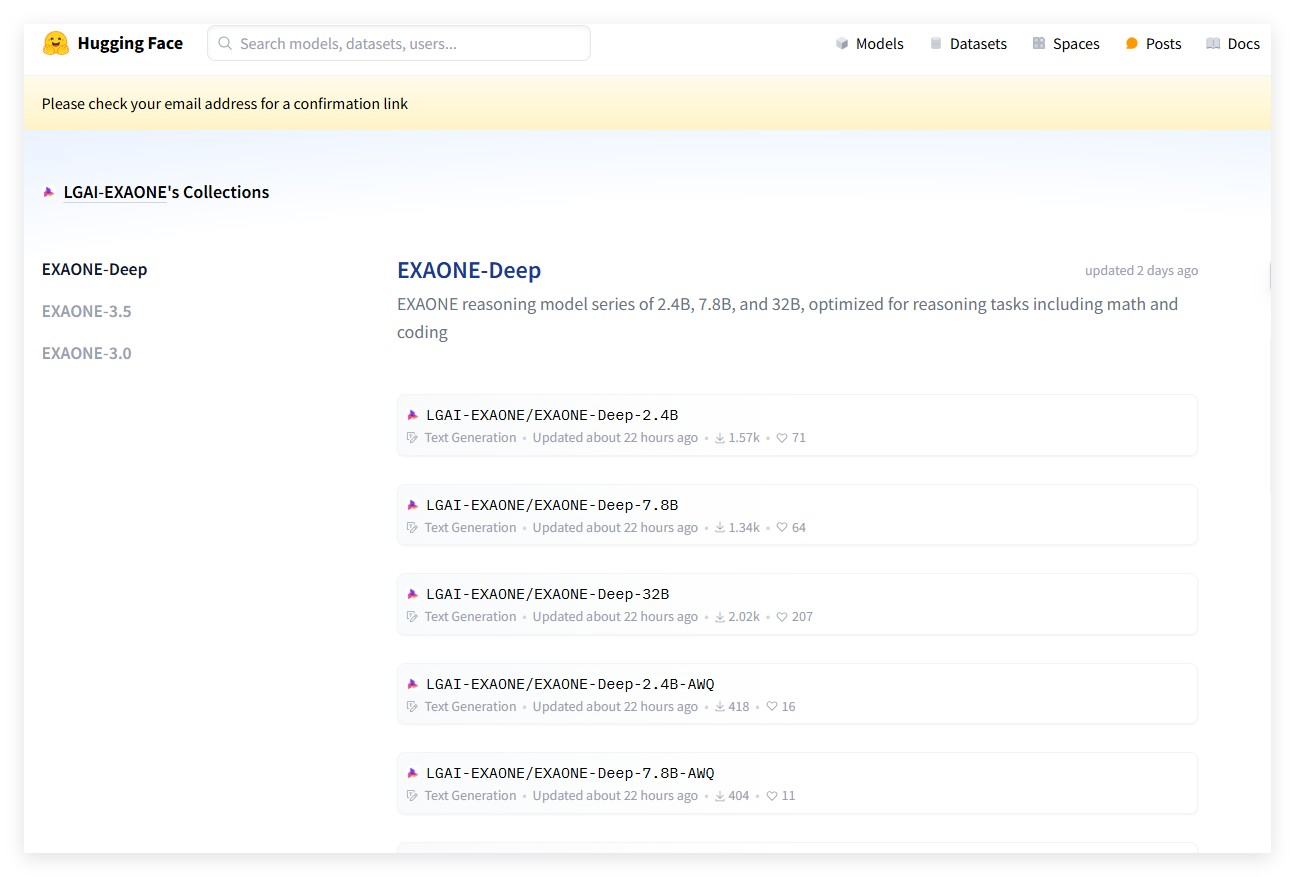

EXAONE Deep 是 LG AI Research 推出的先进推理 AI 模型,标志着韩国在全球 AI 市场中的竞争力。它具备 32 亿参数,表现卓越,尤其在数学和科学问题解决方面展现出色。该模型的发布使得 LG 在 AI 领域迈入了自主决策的时代,其开源特性使得更多开发者能够利用这一技术进行研究与开发。EXAONE Deep 的轻量级和在设备上的模型设计使得其适用于多个行业,包括教育、科学研究、编程等。

需求人群:

"EXAONE Deep 适合教育工作者、科学研究人员和开发者,因为它能够有效解决专业领域中的复杂问题,并提供高效的推理能力。其开源特性使得用户能够根据自身需求进行模型的调整和优化。"

使用场景示例:

在教育领域,帮助学生解决数学和科学问题,提升学习效果。

科研人员利用 EXAONE Deep 进行复杂的科学研究,提高研究效率。

开发者使用 EXAONE Deep 作为基础模型,开发新型应用程序。

产品特色:

高效解决复杂的数学和科学问题。

支持自主推理和假设验证。

在轻量级模型中维持高达 95% 的性能。

在多种评估指标上表现优异,包括数学和科学推理能力。

提供安全的本地处理能力,保护用户隐私。

具有良好的经济效率,适用于多种设备。

开源特性便于广泛的开发和应用。

在多种行业中应用潜力巨大,如教育和科研。

使用教程:

访问 EXAONE Deep 的官方网站并下载模型。

根据用户手册进行安装和设置。

选择适合的参数和配置,启动模型。

通过提供数据进行测试和验证模型的推理能力。

根据反馈不断调整模型以优化性能。

浏览量:180

最新流量情况

月访问量

25633.38k

平均访问时长

00:04:53

每次访问页数

5.77

跳出率

44.05%

流量来源

直接访问

49.07%

自然搜索

35.64%

邮件

0.03%

外链引荐

12.38%

社交媒体

2.75%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

14.36%

印度

8.76%

韩国

3.61%

俄罗斯

5.25%

美国

16.65%

DeepSeek-R1-Distill-Qwen-7B 是一个开源的推理模型,专注于数学、代码和推理任务。

DeepSeek-R1-Distill-Qwen-7B 是一个经过强化学习优化的推理模型,基于 Qwen-7B 进行了蒸馏优化。它在数学、代码和推理任务上表现出色,能够生成高质量的推理链和解决方案。该模型通过大规模强化学习和数据蒸馏技术,显著提升了推理能力和效率,适用于需要复杂推理和逻辑分析的场景。

LG AI 推出的开源推理 AI 模型,具备卓越的推理能力。

EXAONE Deep 是 LG AI Research 推出的先进推理 AI 模型,标志着韩国在全球 AI 市场中的竞争力。它具备 32 亿参数,表现卓越,尤其在数学和科学问题解决方面展现出色。该模型的发布使得 LG 在 AI 领域迈入了自主决策的时代,其开源特性使得更多开发者能够利用这一技术进行研究与开发。EXAONE Deep 的轻量级和在设备上的模型设计使得其适用于多个行业,包括教育、科学研究、编程等。

OpenThinker-32B 是一款强大的开源推理模型,专为提升开放数据推理能力而设计。

OpenThinker-32B 是由 Open Thoughts 团队开发的一款开源推理模型。它通过扩展数据规模、验证推理路径和扩展模型大小来实现强大的推理能力。该模型在数学、代码和科学等推理基准测试中表现卓越,超越了现有的开放数据推理模型。其主要优点包括开源数据、高性能和可扩展性。该模型基于 Qwen2.5-32B-Instruct 进行微调,并在大规模数据集上训练,旨在为研究人员和开发者提供强大的推理工具。

一款在推理和编程基准测试中表现与o1-preview相当的推理模型。

Sky-T1-32B-Preview是由加州大学伯克利分校的NovaSky团队开发的推理模型。该模型在流行的推理和编程基准测试中表现出色,与o1-preview相当,且训练成本不到450美元,展示了以低成本高效复制高级推理能力的可能性。该模型完全开源,包括数据、代码和模型权重,旨在推动学术界和开源社区的发展。其主要优点是低成本、高性能和开源,为研究人员和开发者提供了宝贵的资源。

小米首个推理大模型MiMo开源,专为推理任务设计,性能卓越。

Xiaomi MiMo是小米公司开源的首个推理大模型,专为推理任务设计,具备卓越的数学推理和代码生成能力。该模型在数学推理(AIME 24-25)和代码竞赛(LiveCodeBench v5)公开测评集上表现出色,仅用7B的参数规模就超越了OpenAI的o1-mini和阿里Qwen的QwQ-32B-Preview等更大规模的模型。MiMo通过预训练和后训练阶段的多层面创新,包括数据挖掘、训练策略和强化学习算法等,显著提升了推理能力。该模型的开源为研究人员和开发者提供了强大的工具,推动了人工智能在推理领域的进一步发展。

基于Linux环境快速部署开源大模型的教程

该项目是一个围绕开源大模型的全流程指导教程,包括环境配置、模型部署、高效微调等,简化开源大模型的使用和应用,让更多普通学习者能够使用开源大模型。项目面向对开源大模型感兴趣且想自主上手的学习者,提供详细的环境配置、模型部署和微调方法。

Stability AI 生成模型是一个开源的生成模型库。

Stability AI 生成模型是一个开源的生成模型库,提供了各种生成模型的训练、推理和应用功能。该库支持各种生成模型的训练,包括基于 PyTorch Lightning 的训练,提供了丰富的配置选项和模块化的设计。用户可以使用该库进行生成模型的训练,并通过提供的模型进行推理和应用。该库还提供了示例训练配置和数据处理的功能,方便用户进行快速上手和定制。

业界首个超大规模混合 Mamba 推理模型,强推理能力。

混元T1 是腾讯推出的超大规模推理模型,基于强化学习技术,通过大量后训练显著提升推理能力。它在长文处理和上下文捕捉上表现突出,同时优化了计算资源的消耗,具备高效的推理能力。适用于各类推理任务,尤其在数学、逻辑推理等领域表现优异。该产品以深度学习为基础,结合实际反馈不断优化,适合科研、教育等多个领域的应用。

一款 21B 通用推理模型,适合低延迟应用。

Reka Flash 3 是一款从零开始训练的 21 亿参数的通用推理模型,利用合成和公共数据集进行监督微调,结合基于模型和基于规则的奖励进行强化学习。该模型在低延迟和设备端部署应用中表现优异,具有较强的研究能力。它目前是同类开源模型中的最佳选择,适合于各种自然语言处理任务和应用场景。

DeepSeek-R1-Zero 是一款通过大规模强化学习训练的推理模型,无需监督微调即可实现卓越推理能力。

DeepSeek-R1-Zero 是由 DeepSeek 团队开发的推理模型,专注于通过强化学习提升模型的推理能力。该模型在无需监督微调的情况下,展现出强大的推理行为,如自我验证、反思和生成长链推理。其主要优点包括高效推理能力、无需预训练即可使用,以及在数学、代码和推理任务上的卓越表现。该模型基于 DeepSeek-V3 架构开发,支持大规模推理任务,适用于研究和商业应用。

新一代最强推理模型

OpenAI o3模型是继o1之后的新一代推理模型,包括o3和o3-mini两个版本。o3在某些条件下接近于通用人工智能(AGI),在ARC-AGI基准测试中得分高达87.5%,远超人类平均水平。它在数学和编程任务中表现出色,在2024年美国数学邀请赛(AIME)中得分96.7%,在Codeforces评级中达到2727分。o3能够自我事实核查,通过“私人思维链”进行推理,提高答案的准确性。o3是首个使用“审议对齐”技术训练的模型,以符合安全原则。目前,o3模型尚未广泛可用,但安全研究人员可以注册预览o3-mini模型。o3 mini版将在1月底推出,之后不久推出o3完整版。

开放的大型推理模型,解决现实世界问题

Marco-o1是一个开放的大型推理模型,旨在通过先进的技术如Chain-of-Thought (CoT) fine-tuning、Monte Carlo Tree Search (MCTS)、反射机制和创新的推理策略,优化复杂现实世界问题的解决任务。该模型不仅关注数学、物理和编程等有标准答案的学科,还强调开放性问题的解决。Marco-o1由阿里巴巴国际数字商务的MarcoPolo团队开发,具有强大的推理能力,已在多个领域展示出卓越的性能。

免费开源AI模型推理服务

Tost AI是一个免费、非盈利、开源的服务,它为最新的AI论文提供推理服务,使用非盈利GPU集群。Tost AI不存储任何推理数据,所有数据在12小时内过期。此外,Tost AI提供将数据发送到Discord频道的选项。每个账户每天提供100个免费钱包余额,如果希望每天获得1100个钱包余额,可以订阅GitHub赞助者或Patreon。Tost AI将演示的所有利润都发送给论文的第一作者,其预算由公司和个人赞助者支持。

双语开源数学推理大型语言模型。

InternLM-Math-Plus 是一个最新的双语(英文和中文)开源大型语言模型(LLM),专注于数学推理,具有解决、证明、验证和增强数学问题的能力。它在非正式数学推理(如思维链和代码解释)和正式数学推理(如LEAN 4翻译和证明)方面都有显著的性能提升。

一个通用框架,用于在测试时调节大型推理模型的思维进度。

AlphaOne(α1)是一种调节大型推理模型(LRMs)在测试时思维进度的通用框架。通过引入 α 时刻和动态安排慢速思维转变,α1 实现了慢速到快速推理的灵活调节。这一方法统一并推广了现有的单调缩放方法,优化了推理能力与计算效率。该产品适用于需要处理复杂推理任务的科研人员和开发者。

Steiner 是一个基于合成数据训练的推理模型,旨在探索多种推理路径并自主验证。

Steiner 是由 Yichao 'Peak' Ji 开发的推理模型系列,专注于通过强化学习在合成数据上训练,能够在推理时探索多种路径并自主验证或回溯。该模型的目标是复现 OpenAI o1 的推理能力,并验证推理时的扩展曲线。Steiner-preview 是一个正在进行中的项目,其开源目的是为了分享知识并获取更多真实用户的反馈。尽管该模型在某些基准测试中表现出色,但尚未完全实现 OpenAI o1 的推理扩展能力,因此仍处于开发阶段。

大型推理模型框架,支持PyTorch和HuggingFace。

LLaMA-O1是一个大型推理模型框架,它结合了蒙特卡洛树搜索(MCTS)、自我强化学习、PPO等技术,并借鉴了AlphaGo Zero的双重策略范式以及大型语言模型。该模型主要针对奥林匹克级别的数学推理问题,提供了一个开放的平台用于训练、推理和评估。产品背景信息显示,这是一个个人实验项目,与任何第三方组织或机构无关。

s1是一个基于Qwen2.5-32B-Instruct微调的推理模型,仅用1000个样本进行训练。

s1是一个推理模型,专注于通过少量样本实现高效的文本生成能力。它通过预算强制技术在测试时进行扩展,能够匹配o1-preview的性能。该模型由Niklas Muennighoff等人开发,相关研究发表在arXiv上。模型使用Safetensors技术,具有328亿参数,支持文本生成任务。其主要优点是能够通过少量样本实现高质量的推理,适合需要高效文本生成的场景。

一个专注于整理最佳开源推理数据集的社区项目

Open Thoughts 是一个由 Bespoke Labs 和 DataComp 社区主导的项目,旨在整理高质量的开源推理数据集,用于训练先进的小模型。该项目汇集了来自斯坦福大学、加州大学伯克利分校、华盛顿大学等多所高校和研究机构的研究人员与工程师,致力于通过优质数据集推动推理模型的发展。其背景是当前推理模型在数学和代码推理等领域的应用需求日益增长,而高质量的数据集是提升模型性能的关键。该项目目前免费开放,主要面向研究人员、开发者以及对推理模型感兴趣的专业人士,其数据集和工具的开源性使其成为推动人工智能教育和研究的重要资源。

OpenAI o3-mini 是 OpenAI 推出的最新高性价比推理模型,专为 STEM 领域优化。

OpenAI o3-mini 是 OpenAI 推出的最新推理模型,专为科学、技术、工程和数学(STEM)领域优化。它在保持低成本和低延迟的同时,提供了强大的推理能力,尤其在数学、科学和编程方面表现出色。该模型支持多种开发者功能,如函数调用、结构化输出等,并且可以根据需求选择不同的推理强度。o3-mini 的推出进一步降低了推理模型的使用成本,使其更适合广泛的应用场景。

昆仑万维开源的高性能数学代码推理模型,性能卓越

Skywork-OR1是由昆仑万维天工团队开发的高性能数学代码推理模型。该模型系列在同等参数规模下实现了业界领先的推理性能,突破了大模型在逻辑理解与复杂任务求解方面的能力瓶颈。Skywork-OR1系列包括Skywork-OR1-Math-7B、Skywork-OR1-7B-Preview和Skywork-OR1-32B-Preview三款模型,分别聚焦数学推理、通用推理和高性能推理任务。此次开源不仅涵盖模型权重,还全面开放了训练数据集和完整训练代码,所有资源均已上传至GitHub和Huggingface平台,为AI社区提供了完全可复现的实践参考。这种全方位的开源策略有助于推动整个AI社区在推理能力研究上的共同进步。

DeepSeek-R1 是一款高性能推理模型,支持多种语言和任务,适用于研究和商业应用。

DeepSeek-R1 是 DeepSeek 团队推出的第一代推理模型,通过大规模强化学习训练,无需监督微调即可展现出卓越的推理能力。该模型在数学、代码和推理任务上表现优异,与 OpenAI-o1 模型相当。DeepSeek-R1 还提供了多种蒸馏模型,适用于不同规模和性能需求的场景。其开源特性为研究社区提供了强大的工具,支持商业使用和二次开发。

Dolphin R1是一个用于训练推理模型的数据集,包含80万条样本。

Dolphin R1是一个由Cognitive Computations团队创建的数据集,旨在训练类似DeepSeek-R1 Distill模型的推理模型。该数据集包含30万条来自DeepSeek-R1的推理样本、30万条来自Gemini 2.0 flash thinking的推理样本以及20万条Dolphin聊天样本。这些数据集的组合为研究人员和开发者提供了丰富的训练资源,有助于提升模型的推理能力和对话能力。该数据集的创建得到了Dria、Chutes、Crusoe Cloud等多家公司的赞助支持,这些赞助商为数据集的开发提供了计算资源和资金支持。Dolphin R1数据集的发布,为自然语言处理领域的研究和开发提供了重要的基础,推动了相关技术的发展。

开源代码语言模型,提升编程和数学推理能力。

DeepSeek-Coder-V2是一个开源的专家混合模型(Mixture-of-Experts, MoE),专为代码语言设计,其性能与GPT4-Turbo相当。它在代码特定任务上表现优异,同时在通用语言任务上保持了相当的性能。与DeepSeek-Coder-33B相比,V2版本在代码相关任务和推理能力上都有显著提升。此外,它支持的编程语言从86种扩展到了338种,上下文长度也从16K扩展到了128K。

智谱深度推理模型,擅长数理逻辑和代码推理

GLM-Zero-Preview是智谱首个基于扩展强化学习技术训练的推理模型,专注于增强AI推理能力,擅长处理数理逻辑、代码和需要深度推理的复杂问题。与基座模型相比,在不显著降低通用任务能力的情况下,专家任务能力大幅提升。在AIME 2024、MATH500和LiveCodeBench评测中,效果与OpenAI o1-preview相当。产品背景信息显示,智谱华章科技有限公司致力于通过强化学习技术,提升模型的深度推理能力,未来将推出正式版GLM-Zero,扩展深度思考的能力到更多技术领域。

网易有道开发的轻量级推理模型,可在单个GPU上部署,具备类似o1的推理能力。

Confucius-o1-14B是由网易有道团队开发的推理模型,基于Qwen2.5-14B-Instruct优化而成。它采用两阶段学习策略,能够自动生成推理链,并总结出逐步的问题解决过程。该模型主要面向教育领域,尤其适合K12数学问题的解答,能够帮助用户快速获取正确解题思路和答案。模型具备轻量化的特点,无需量化即可在单个GPU上部署,降低了使用门槛。其推理能力在内部评估中表现出色,为教育领域的AI应用提供了强大的技术支持。

全球最强的编程和推理模型,提升开发效率。

Claude 4 是 Anthropic 最新推出的 AI 模型系列,具备强大的编程和推理能力,能够高效处理复杂任务。其卓越的性能使其在编程基准测试中名列前茅,成为开发者的重要工具。Claude 4 通过多项新功能的引入,提升了信息处理的效率和准确性,适合需要高效编码和逻辑推理的用户。

开源大语言模型,匹配专有强大能力。

Open O1是一个开源项目,旨在通过开源创新,匹配专有的强大O1模型能力。该项目通过策划一组O1风格的思考数据,用于训练LLaMA和Qwen模型,赋予了这些较小模型更强大的长期推理和解决问题的能力。随着Open O1项目的推进,我们将继续推动大型语言模型的可能性,我们的愿景是创建一个不仅能够实现类似O1的性能,而且在测试时扩展性方面也处于领先地位的模型,使高级AI能力为所有人所用。通过社区驱动的开发和对道德实践的承诺,Open O1将成为AI进步的基石,确保技术的未来发展是开放的,并对所有人有益。

© 2026 AIbase 备案号:闽ICP备08105208号-14