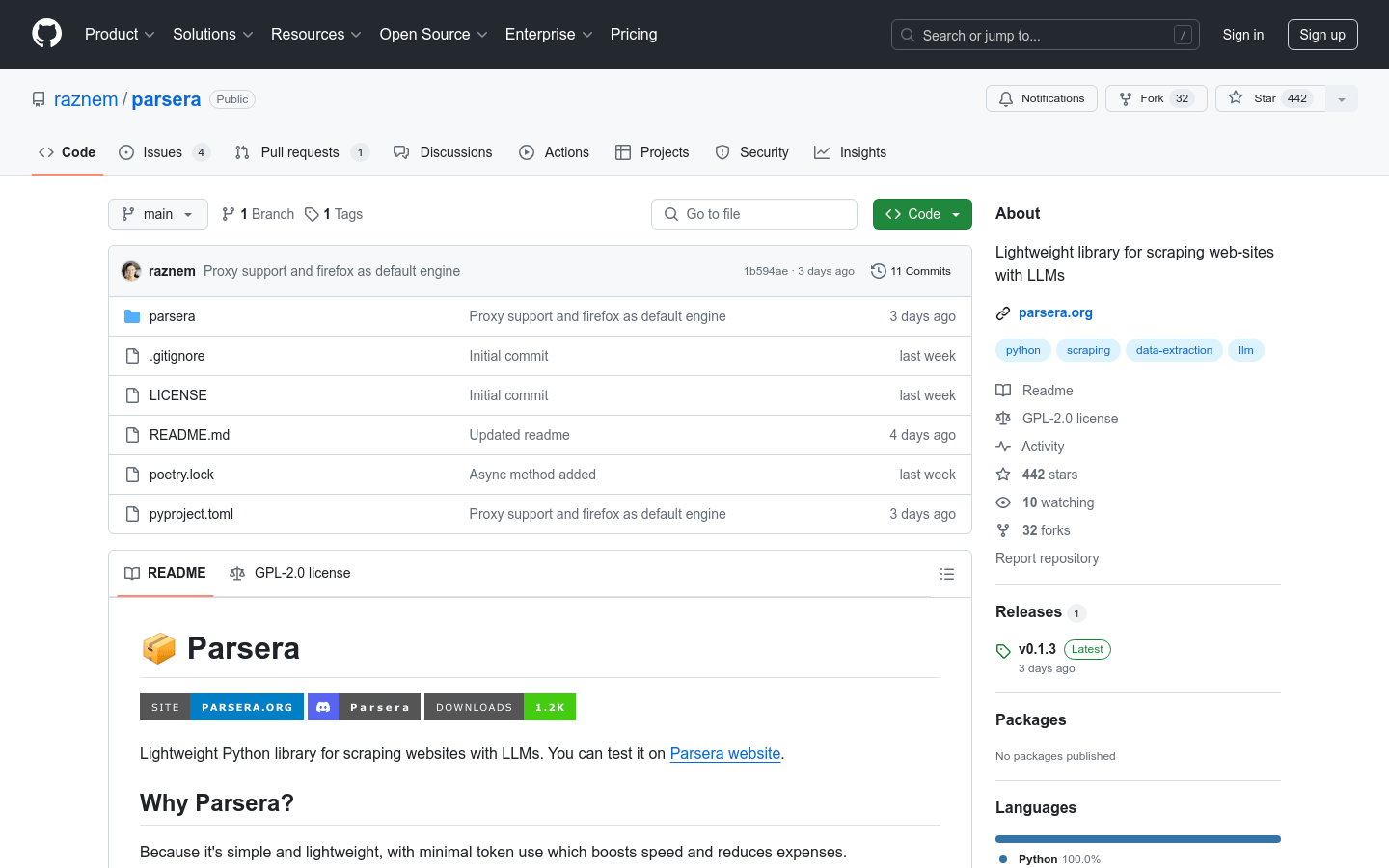

Parsera是一个轻量级的Python库,专门设计用于与大型语言模型(LLMs)结合,以简化网站数据抓取的过程。它通过使用最少的令牌来提高速度并降低成本,使得数据抓取变得更加高效和经济。Parsera支持多种聊天模型,并且可以自定义使用不同的模型,如OpenAI或Azure。

需求人群:

"目标受众主要是数据科学家、研究人员以及需要从网站抓取数据的开发者。由于Parsera的轻量级特性和对大型语言模型的支持,它特别适合那些需要高效、低成本进行数据抓取的用户。"

使用场景示例:

使用Parsera从新闻网站抓取新闻标题、点赞数和评论数。

集成Parsera到数据分析项目中,自动抓取并分析网站数据。

在学术研究中,使用Parsera抓取特定领域的网站数据,进行进一步的研究分析。

产品特色:

支持多种大型语言模型进行网站数据抓取。

提供异步运行方法,提高数据处理效率。

允许用户自定义抓取元素,灵活配置抓取任务。

支持设置环境变量,方便集成到不同开发环境。

提供详细的文档和示例代码,便于用户学习和使用。

支持Jupyter Notebook,方便数据科学家和研究人员进行数据分析。

使用教程:

1. 安装Parsera库。

2. 设置必要的环境变量,如`OPENAI_API_KEY`。

3. 定义要抓取的网站URL和元素。

4. 创建Parsera实例,并指定使用的模型。

5. 调用`run`方法或`arun`异步方法执行抓取任务。

6. 处理抓取结果,将数据保存或进行进一步分析。

浏览量:57

最新流量情况

月访问量

4.93m

平均访问时长

00:06:29

每次访问页数

6.10

跳出率

36.08%

流量来源

直接访问

54.82%

自然搜索

31.76%

邮件

0.04%

外链引荐

11.31%

社交媒体

1.86%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.56%

德国

3.93%

印度

9.82%

俄罗斯

5.43%

美国

18.51%

轻量级Python库,用于使用大型语言模型进行网站抓取。

Parsera是一个轻量级的Python库,专门设计用于与大型语言模型(LLMs)结合,以简化网站数据抓取的过程。它通过使用最少的令牌来提高速度并降低成本,使得数据抓取变得更加高效和经济。Parsera支持多种聊天模型,并且可以自定义使用不同的模型,如OpenAI或Azure。

Dria-Agent-α是基于Python的大型语言模型工具交互框架。

Dria-Agent-α是Hugging Face推出的大型语言模型(LLM)工具交互框架。它通过Python代码来调用工具,与传统的JSON模式相比,能更充分地发挥LLM的推理能力,使模型能够以更接近人类自然语言的方式进行复杂问题的解决。该框架利用Python的流行性和接近伪代码的语法,使LLM在代理场景中表现更佳。Dria-Agent-α的开发使用了合成数据生成工具Dria,通过多阶段管道生成逼真的场景,训练模型进行复杂问题解决。目前已有Dria-Agent-α-3B和Dria-Agent-α-7B两个模型在Hugging Face上发布。

使用大型语言模型(LLMs)进行数据清洗和整理的Python库。

databonsai是一个Python库,利用大型语言模型(LLMs)执行数据清洗任务。它提供了一系列工具,包括数据分类、转换和提取,以及对LLM输出的验证,支持批量处理以节省令牌,并且具备重试逻辑以处理速率限制和瞬时错误。

大型语言模型,支持多语言和代码数据

Mistral-Nemo-Instruct-2407是由Mistral AI和NVIDIA联合训练的大型语言模型(LLM),是Mistral-Nemo-Base-2407的指导微调版本。该模型在多语言和代码数据上进行了训练,显著优于大小相似或更小的现有模型。其主要特点包括:支持多语言和代码数据训练、128k上下文窗口、可替代Mistral 7B。模型架构包括40层、5120维、128头维、1436隐藏维、32个头、8个kv头(GQA)、2^17词汇量(约128k)、旋转嵌入(theta=1M)。该模型在多种基准测试中表现出色,如HellaSwag(0-shot)、Winogrande(0-shot)、OpenBookQA(0-shot)等。

构建和训练大型语言模型的综合框架

DataComp-LM (DCLM) 是一个为构建和训练大型语言模型(LLMs)而设计的综合性框架,提供了标准化的语料库、基于open_lm框架的高效预训练配方,以及超过50种评估方法。DCLM 支持研究人员在不同的计算规模上实验不同的数据集构建策略,从411M到7B参数模型。DCLM 通过优化的数据集设计显著提高了模型性能,并且已经促成了多个高质量数据集的创建,这些数据集在不同规模上表现优异,超越了所有开放数据集。

利用大型语言模型增量构建知识图谱

iText2KG是一个Python包,旨在利用大型语言模型从文本文档中提取实体和关系,增量构建一致的知识图谱。它具备零样本能力,允许在没有特定训练的情况下跨不同领域进行知识提取。该包包括文档蒸馏、实体提取和关系提取模块,确保实体和关系得到解决和唯一性。它通过Neo4j提供知识图谱的可视化表示,支持交互式探索和分析结构化数据。

大型语言模型角色扮演框架

RoleLLM是一个角色扮演框架,用于构建和评估大型语言模型的角色扮演能力。它包括四个阶段:角色概要构建、基于上下文的指令生成、使用GPT进行角色提示和基于角色的指令调整。通过Context-Instruct和RoleGPT,我们创建了RoleBench,这是一个系统化和细粒度的角色级别基准数据集,包含168,093个样本。此外,RoCIT在RoleBench上产生了RoleLLaMA(英语)和RoleGLM(中文),显著提高了角色扮演能力,甚至与使用GPT-4的RoleGPT取得了可比较的结果。

高效为大型语言模型提供服务

FP6-LLM是一种用于大型语言模型的全新支持方案,通过六位量化(FP6)有效地减小了模型大小,并在各种应用中始终保持模型质量。我们提出了TC-FPx,这是第一个完整的GPU内核设计方案,统一支持各种量化位宽的浮点权重。我们将TC-FPx内核集成到现有推理系统中,为量化的LLM推理提供了全新的端到端支持(称为FP6-LLM),实现了推理成本和模型质量之间更好的权衡。实验证明,FP6-LLM使得使用单个GPU进行LLaMA-70b推理成为可能,实现的规范化推理吞吐量比FP16基准高1.69倍至2.65倍。

定制化大型语言模型的训练平台

Entry Point AI是一款训练大型语言模型的平台,可以快速高效地进行训练、管理和评估自定义模型,无需编写代码。它提供了跨平台的训练工具,可以比较模型性能、标注数据集、生成合成数据,并以速度和质量优于基于对话的模型。

前沿的多模态大型语言模型

NVLM-D-72B是NVIDIA推出的一款多模态大型语言模型,专注于视觉-语言任务,并且通过多模态训练提升了文本性能。该模型在视觉-语言基准测试中取得了与业界领先模型相媲美的成绩。

双语开源数学推理大型语言模型。

InternLM-Math-Plus 是一个最新的双语(英文和中文)开源大型语言模型(LLM),专注于数学推理,具有解决、证明、验证和增强数学问题的能力。它在非正式数学推理(如思维链和代码解释)和正式数学推理(如LEAN 4翻译和证明)方面都有显著的性能提升。

多模态语音大型语言模型

fixie-ai/ultravox-v0_4_1-llama-3_1-8b是一个基于预训练的Llama3.1-8B-Instruct和whisper-large-v3-turbo的大型语言模型,能够处理语音和文本输入,生成文本输出。该模型通过特殊的<|audio|>伪标记将输入音频转换为嵌入,并生成输出文本。未来版本计划扩展标记词汇以支持生成语义和声学音频标记,进而可以用于声码器产生语音输出。该模型在翻译评估中表现出色,且没有偏好调整,适用于语音代理、语音到语音翻译、语音分析等场景。

医疗领域先进的大型语言模型

HuatuoGPT-o1-70B是由FreedomIntelligence开发的医疗领域大型语言模型(LLM),专为复杂的医疗推理设计。该模型在提供最终响应之前,会生成一个复杂的思考过程,反映并完善其推理。HuatuoGPT-o1-70B能够处理复杂的医疗问题,提供深思熟虑的答案,这对于提高医疗决策的质量和效率至关重要。该模型基于LLaMA-3.1-70B架构,支持英文,并且可以部署在多种工具上,如vllm或Sglang,或者直接进行推理。

开放的大型语言模型排行榜

Open LLM Leaderboard是一个由Hugging Face提供的空间,旨在展示和比较各种大型语言模型的性能。它为开发者、研究人员和企业提供了一个平台,可以查看不同模型在特定任务上的表现,从而帮助用户选择最适合自己需求的模型。

前沿级多模态大型语言模型

NVLM 1.0是NVIDIA ADLR推出的前沿级多模态大型语言模型系列,它在视觉-语言任务上达到了业界领先水平,与顶级专有模型和开放访问模型相媲美。该模型在多模态训练后,甚至在纯文本任务上的准确性上也有所提高。NVLM 1.0的开源模型权重和Megatron-Core训练代码为社区提供了宝贵的资源。

多语言大型语言模型

Llama 3.2是由Meta公司推出的多语言大型语言模型(LLMs),包含1B和3B两种规模的预训练和指令调优生成模型。这些模型在多种语言对话用例中进行了优化,包括代理检索和总结任务。Llama 3.2在许多行业基准测试中的表现优于许多现有的开源和封闭聊天模型。

多模态大型语言模型的优化与分析

MM1.5是一系列多模态大型语言模型(MLLMs),旨在增强文本丰富的图像理解、视觉指代表明和接地以及多图像推理的能力。该模型基于MM1架构,采用以数据为中心的模型训练方法,系统地探索了整个模型训练生命周期中不同数据混合的影响。MM1.5模型从1B到30B参数不等,包括密集型和混合专家(MoE)变体,并通过广泛的实证研究和消融研究,提供了详细的训练过程和决策见解,为未来MLLM开发研究提供了宝贵的指导。

多维奖励模型,助力构建自定义大型语言模型。

Nemotron-4-340B-Reward是由NVIDIA开发的多维奖励模型,用于合成数据生成管道,帮助研究人员和开发者构建自己的大型语言模型(LLMs)。该模型由Nemotron-4-340B-Base模型和一个线性层组成,能够将响应末尾的标记转换为五个标量值,对应于HelpSteer2属性。它支持最多4096个标记的上下文长度,并能够对每个助手轮次的五个属性进行评分。

超快速的网络爬虫与数据抓取API

UseScraper是一个超快速的网络爬虫与数据抓取API,可以快速抓取网页内容并提供多种输出格式,包括HTML、纯文本和Markdown。它支持浏览器渲染,可以爬取复杂的网站,并提供多种功能和定价选项。无需信用卡即可注册,还可以获得25美元的免费使用额度。

一个简单易用的网页抓取工具。

Scrape It Now! 是一个开源的网页抓取工具,它提供了一整套自动化网页抓取和索引的解决方案。该工具使用Python编写,支持多种功能,包括动态JavaScript内容加载、广告屏蔽、随机用户代理,自动创建AI搜索索引等,以提高抓取效率和数据质量。它适用于需要从网页中提取信息并进行进一步分析或存储的用户。

数据驱动的框架,增强大型语言模型的工作流编排能力

WorkflowLLM是一个以数据为中心的框架,旨在增强大型语言模型(LLMs)在工作流编排方面的能力。核心是WorkflowBench,这是一个大规模的监督式微调数据集,包含来自83个应用、28个类别的1503个API的106763个样本。WorkflowLLM通过微调Llama-3.1-8B模型,创建了专门针对工作流编排任务优化的WorkflowLlama模型。实验结果表明,WorkflowLlama在编排复杂工作流方面表现出色,并且能够很好地泛化到未见过的API。

连接自定义数据源到大型语言模型的数据框架

LlamaIndex是一个简单、灵活的数据框架,用于连接自定义数据源到大型语言模型。它提供了关键工具,用于增强您的LLM应用程序的数据。包括数据摄取、数据索引和查询接口。可以轻松构建强大的终端用户应用程序,如文档问答、数据增强聊天机器人、知识代理、结构化分析等。支持连接非结构化、结构化或半结构化的数据源。

从Google Maps抓取本地商家数据

Map Lead Scraper是一个从Google Maps抓取工具,可以帮助用户提取Google Maps上的信息。它可以提取本地商家数据和联系方式,节省大量手动搜索的时间。可以自动生成潜在客户名单,包括名称、电话、邮箱等信息。

世界顶尖的开源大型语言模型

Reflection Llama-3.1 70B 是目前世界上顶尖的开源大型语言模型(LLM),采用名为 Reflection-Tuning 的新技术进行训练,使模型能够检测其推理中的错误并进行修正。该模型在合成数据上进行了训练,这些数据由 Glaive 生成。对于正在训练模型的用户来说,Glaive 是一个非常出色的工具。该模型使用标准的 Llama 3.1 聊天格式,通过特殊的标签来区分模型的内部思考和最终答案,从而提升用户体验。

先进的大型语言模型,用于编程

Code Llama 是一款先进的大型语言模型,可以通过文本提示生成代码。它是当前公开可用的语言模型中在编程任务上达到最佳性能的模型之一。Code Llama 可以帮助开发人员提高工作效率,降低编码门槛,并作为一个教育工具帮助编程学习者编写更健壮、更好文档化的软件。Code Llama 提供了多个版本,包括基础版、针对 Python 的专用版和针对自然语言指令的定制版。它支持多种流行的编程语言,如 Python、C++、Java 等。Code Llama 免费供研究和商业使用。

一款基于生物医学数据的8亿参数大型语言模型

Llama-3[8B] Meditron V1.0是一款专为生物医学领域设计的8亿参数的大型语言模型(LLM),在Meta发布Llama-3后24小时内完成微调。该模型在MedQA和MedMCQA等标准基准测试中超越了同参数级别的所有现有开放模型,并且接近70B参数级别医学领域领先的开放模型Llama-2[70B]-Meditron的性能。该工作展示了开放基础模型的创新潜力,是确保资源匮乏地区公平参与访问该技术更大倡议的一部分。

大型语言模型,支持多种参数规模

Meta Llama 3 是 Meta 推出的最新大型语言模型,旨在为个人、创作者、研究人员和各类企业解锁大型语言模型的能力。该模型包含从8B到70B参数的不同规模版本,支持预训练和指令调优。模型通过 GitHub 仓库提供,用户可以通过下载模型权重和分词器进行本地推理。Meta Llama 3 的发布标志着大型语言模型技术的进一步普及和应用,具有广泛的研究和商业潜力。

先进的多模态大型语言模型

InternVL2_5-2B-MPO是一个多模态大型语言模型系列,展示了卓越的整体性能。该系列基于InternVL2.5和混合偏好优化构建。它集成了新增量预训练的InternViT与各种预训练的大型语言模型,包括InternLM 2.5和Qwen 2.5,使用随机初始化的MLP投影器。该模型在多模态任务中表现出色,能够处理包括图像和文本在内的多种数据类型,适用于需要理解和生成多模态内容的场景。

© 2026 AIbase 备案号:闽ICP备08105208号-14