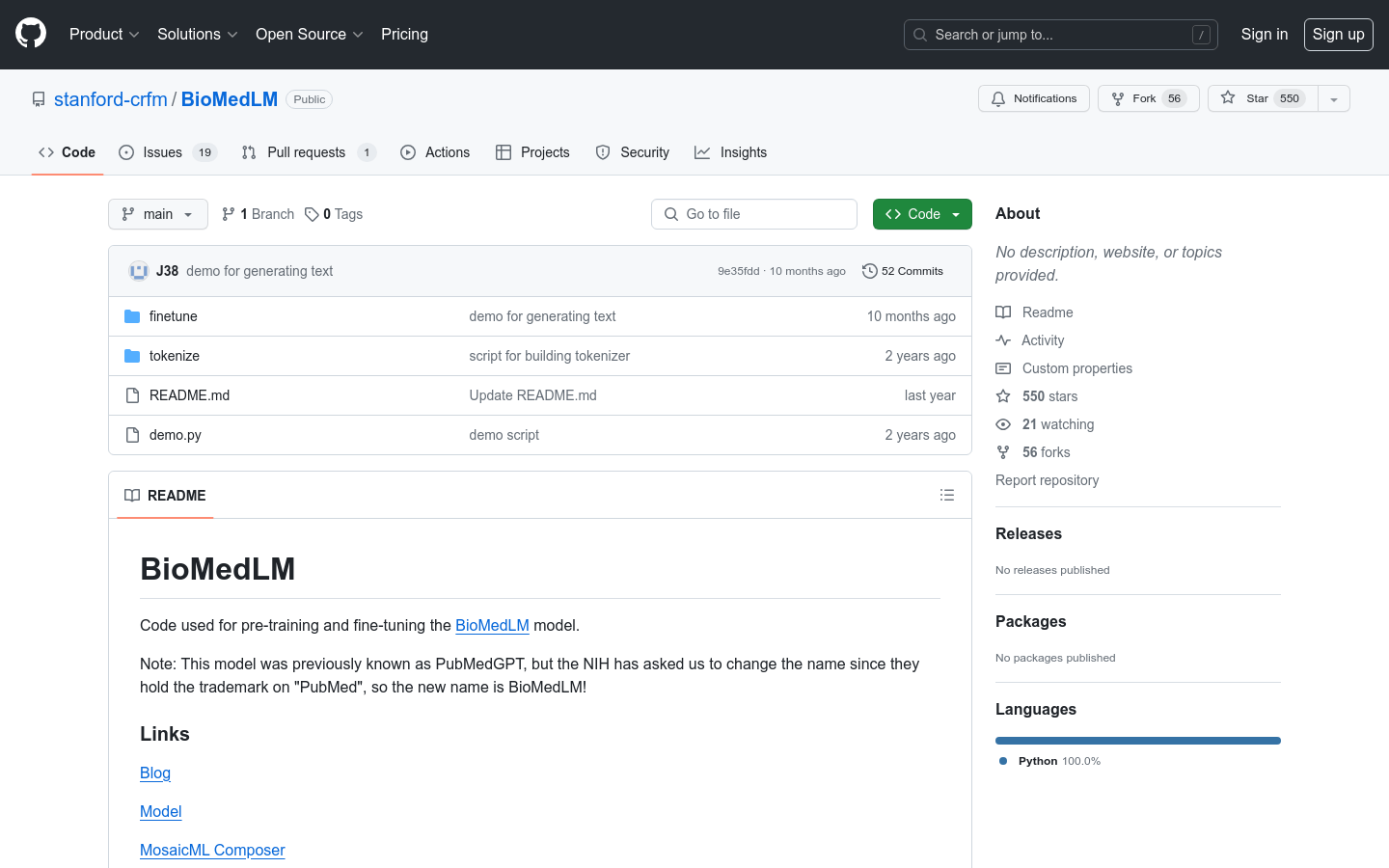

BioMedLM是由斯坦福大学和DataBricks团队合作开发的基于GPT风格的生物医学语言模型,具有2.7亿参数,通过在生物医学领域的专业知识上训练,可以有效地回答有关医学和生物学的复杂问题。可以在单个A100 GPU上方便地进行微调,并在笔记本电脑上运行推理。在MedMCQA上达到57.3%的得分,在MMLU医学遗传学考试上达到69.0%的得分。产品功能包括生物医学问答系统、患者咨询回答、文献检索与总结、数据隐私与内部部署、模型训练数据的完全记录。BioMedLM已在Hugging Face Hub上公开发布,允许任何人下载并微调模型。

需求人群:

"医疗和生物医学领域的专业人士、研究者、学生等"

使用场景示例:

医学生使用BioMedLM在医学考试中进行模拟问答训练。

医疗研究机构利用BioMedLM进行疾病文献的检索和总结工作。

医生使用BioMedLM回答患者的医疗咨询问题。

产品特色:

生物医学问答系统

患者咨询回答

文献检索与总结

数据隐私与内部部署

模型训练数据的完全记录

浏览量:114

最新流量情况

月访问量

4.93m

平均访问时长

00:06:29

每次访问页数

6.10

跳出率

36.08%

流量来源

直接访问

54.82%

自然搜索

31.76%

邮件

0.04%

外链引荐

11.31%

社交媒体

1.86%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.56%

德国

3.93%

印度

9.82%

俄罗斯

5.43%

美国

18.51%

基于GPT风格的生物医学语言模型

BioMedLM是由斯坦福大学和DataBricks团队合作开发的基于GPT风格的生物医学语言模型,具有2.7亿参数,通过在生物医学领域的专业知识上训练,可以有效地回答有关医学和生物学的复杂问题。可以在单个A100 GPU上方便地进行微调,并在笔记本电脑上运行推理。在MedMCQA上达到57.3%的得分,在MMLU医学遗传学考试上达到69.0%的得分。产品功能包括生物医学问答系统、患者咨询回答、文献检索与总结、数据隐私与内部部署、模型训练数据的完全记录。BioMedLM已在Hugging Face Hub上公开发布,允许任何人下载并微调模型。

先进的开源生物医学大型语言模型,专为医疗领域设计。

OpenBioLLM-70B是由Saama AI Labs开发的先进开源语言模型,专为生物医学领域设计。该模型在大量高质量的生物医学数据上进行了微调,能够理解和生成具有领域特定准确性和流畅性的文字。它在生物医学基准测试中展示了超越其他类似规模开源生物医学语言模型的优越性能,并且在与更大的专有和开源模型如GPT-4、Gemini、Medtron-70B、Med-PaLM-1和Med-PaLM-2的比较中也展现了更好的结果。

一款基于生物医学数据的8亿参数大型语言模型

Llama-3[8B] Meditron V1.0是一款专为生物医学领域设计的8亿参数的大型语言模型(LLM),在Meta发布Llama-3后24小时内完成微调。该模型在MedQA和MedMCQA等标准基准测试中超越了同参数级别的所有现有开放模型,并且接近70B参数级别医学领域领先的开放模型Llama-2[70B]-Meditron的性能。该工作展示了开放基础模型的创新潜力,是确保资源匮乏地区公平参与访问该技术更大倡议的一部分。

一款专为生物医学领域设计的开源大型语言模型

OpenBioLLM-8B是由Saama AI Labs开发的先进开源语言模型,专为生物医学领域设计。该模型在大量高质量的生物医学数据上进行了微调,能够理解并生成具有领域特定准确性和流畅性的文字。它在生物医学基准测试中的表现超越了其他类似规模的开源生物医学语言模型,并与更大的专有和开源模型如GPT-3.5和Meditron-70B相比也展现出更好的结果。

生物医学领域的专业通用模型

UltraMedical项目旨在开发生物医学领域的专业通用模型,这些模型旨在回答与考试、临床场景和研究问题相关的问题,同时保持广泛的通用知识基础,以有效处理跨领域问题。通过使用先进的对齐技术,包括监督微调(SFT)、直接偏好优化(DPO)和赔率比偏好优化(ORPO),训练大型语言模型在UltraMedical数据集上,以创建强大且多功能的模型,有效服务于生物医学社区的需求。

医学大型语言模型套件

Meditron 是一套开源的医学大型语言模型(LLM)套件。它通过对一份经过综合筛选的医学语料库进行持续预训练,包括选定的 PubMed 论文和摘要、一份新的国际认可的医学指南数据集以及一个通用领域语料库,将 Llama-2 适应到医学领域。Meditron-70B 在相关数据上进行了微调,性能优于 Llama-2-70B、GPT-3.5 和 Flan-PaLM。

基于大规模数据的高质量信息抽取模型

雅意信息抽取大模型(YAYI-UIE)由中科闻歌算法团队研发,是一款在百万级人工构造的高质量信息抽取数据上进行指令微调的模型。它能够统一训练信息抽取任务,包括命名实体识别(NER)、关系抽取(RE)和事件抽取(EE),覆盖了通用、安全、金融、生物、医疗、商业等多个场景的结构化抽取。该模型的开源旨在促进中文预训练大模型开源社区的发展,并通过开源共建雅意大模型生态。

医疗领域先进的大型语言模型

HuatuoGPT-o1-70B是由FreedomIntelligence开发的医疗领域大型语言模型(LLM),专为复杂的医疗推理设计。该模型在提供最终响应之前,会生成一个复杂的思考过程,反映并完善其推理。HuatuoGPT-o1-70B能够处理复杂的医疗问题,提供深思熟虑的答案,这对于提高医疗决策的质量和效率至关重要。该模型基于LLaMA-3.1-70B架构,支持英文,并且可以部署在多种工具上,如vllm或Sglang,或者直接进行推理。

医疗领域大型语言模型,用于高级医疗推理

HuatuoGPT-o1-7B是由FreedomIntelligence开发的医疗领域大型语言模型(LLM),专为高级医疗推理设计。该模型在提供最终回答之前,会生成复杂的思考过程,反映并完善其推理。HuatuoGPT-o1-7B支持中英文,能够处理复杂的医疗问题,并以'思考-回答'的格式输出结果,这对于提高医疗决策的透明度和可靠性至关重要。该模型基于Qwen2.5-7B,经过特殊训练以适应医疗领域的需求。

先进的医疗领域大型语言模型

HuatuoGPT-o1-8B 是一个专为高级医疗推理设计的医疗领域大型语言模型(LLM)。它在提供最终响应之前会生成一个复杂的思考过程,反映并完善其推理过程。该模型基于LLaMA-3.1-8B构建,支持英文,并且采用'thinks-before-it-answers'的方法,输出格式包括推理过程和最终响应。此模型在医疗领域具有重要意义,因为它能够处理复杂的医疗问题并提供深思熟虑的答案,这对于提高医疗决策的质量和效率至关重要。

256M参数的医学领域语言模型,用于医学文本处理等任务

SmolDocling-256M-preview是由ds4sd推出的一个具有256M参数的语言模型,专注于医学领域。其重要性在于为医学文本处理、医学知识提取等任务提供了有效的工具。在医学研究和临床实践中,大量的文本数据需要进行分析和处理,该模型能够理解和处理医学专业语言。主要优点包括在医学领域有较好的性能表现,能够处理多种医学相关的文本任务,如疾病诊断辅助、医学文献摘要等。该模型的背景是随着医学数据的增长,对处理医学文本的技术需求日益增加。其定位是为医学领域的研究人员、医生、开发者等提供语言处理能力支持,目前未提及价格相关信息。

AI系统设计新型蛋白质,助力生物和健康研究。

AlphaProteo是DeepMind推出的首个AI系统,用于设计新型、高强度的蛋白质结合体,作为生物和健康研究的构建模块。这项技术有潜力加速我们对生物过程的理解,并助力新药的发现、生物传感器的开发等。AlphaProteo能够为多种目标蛋白质生成新的蛋白质结合体,包括与癌症和糖尿病并发症相关的VEGF-A。它在实验成功率和结合亲和力方面均优于现有方法,能够显著减少涉及蛋白质结合体的初步实验所需的时间。

医疗领域复杂推理的大型语言模型

HuatuoGPT-o1是一个专为医疗复杂推理设计的大语言模型,能够识别错误、探索替代策略并完善答案。该模型通过利用可验证的医疗问题和专门的医疗验证器,推进了复杂推理的发展。HuatuoGPT-o1的主要优点包括:使用验证器指导复杂推理轨迹的搜索,以微调大型语言模型;应用基于验证器奖励的强化学习(PPO)进一步提升复杂推理能力。HuatuoGPT-o1的开源模型、数据和代码,使其在医疗教育和研究领域具有重要价值。

汇总和比较全球主要AI模型提供商的价格信息

AIGCRank大语言模型API价格对比是一个专门汇总和比较全球主要AI模型提供商的价格信息的工具。它为用户提供最新的大语言模型(LLM)的价格数据,包括一些免费的AI大模型API。通过这个平台,用户可以轻松查找和比较OpenAI、Claude、Mixtral、Kimi、星火大模型、通义千问、文心一语、Llama 3、GPT-4、AWS和Google等国内外主要API提供商的最新价格,确保找到最适合自己项目的模型定价。

跳到主要内容 Chrome 应用商店探索扩展程序

BenAI Research Assistant是一款基于人工智能的文献分析插件,用于增强生物医学研究。它可以帮助科学家更高效地阅读文献、快速发现证据,并提供工具来加快阅读速度。它支持决定是否阅读一篇文章、理解和发现文章的关键见解、回答科学问题、保持研究流程无需额外工具等主要功能。适用于学术界、制药和生物技术公司的科学家。

基于视觉语言基础模型的胸部X光解读

CheXagent是一个基于视觉语言基础模型的胸部X光解读工具。它利用临床大型语言模型来解析放射学报告,视觉编码器用于表示X光图像,并设计了一个网络来桥接视觉和语言模态。此外,CheXagent还引入了CheXbench,一个旨在系统评估基于视觉语言基础模型在8个临床相关的胸部X光解读任务上的性能的新型基准。经过广泛的定量评估和与五名专家放射科医生的定性评审,CheXagent在CheXbench任务上的表现优于先前开发的通用和医学领域的基础模型。

高质量医学信息的聊天机器人

Radiant AI是一个医学聊天机器人,使用自家开发的OSLER平台LLM框架,为临床医生和医学专业人员提供即时高质量的医学信息。我们的专有数据集和检索增强生成模型确保您获得可靠的信息,无需订阅或自行查找参考文献。

AI co-scientist 是一个基于 Gemini 2.0 的多智能体 AI 系统,旨在帮助科学家生成新的研究假设和实验方案,加速科学发现。

AI co-scientist 是谷歌研究团队开发的一款多智能体 AI 系统,旨在通过人工智能技术辅助科学研究。该系统基于 Gemini 2.0 构建,能够模拟科学方法的推理过程,生成新的研究假设和实验方案。它通过多智能体协作,利用生成、反思、排名、进化等多种机制,不断优化输出结果。AI co-scientist 的主要优点包括高效生成新颖的科学假设、强大的跨学科知识整合能力以及与科学家的协作能力。该系统目前处于研究阶段,通过与全球顶尖科研机构合作,验证其在生物医学等领域的应用潜力。

百川智能开发的专为医疗场景优化的开源大语言模型,具备卓越的通用能力和医疗领域性能。

Baichuan-M1-14B 是由百川智能开发的开源大语言模型,专为医疗场景优化。它基于20万亿token的高质量医疗与通用数据训练,覆盖20多个医疗科室,具备强大的上下文理解和长序列任务表现能力。该模型在医疗领域表现出色,同时在通用任务中也达到了同尺寸模型的效果。其创新的模型结构和训练方法使其在医疗推理、病症判断等复杂任务中表现出色,为医疗领域的人工智能应用提供了强大的支持。

媲美人类护士的医疗护理保健模型

Polaris是由Hippocratic AI 开发的一款高度专注于安全、用于医疗保健的大语言模型(LLM)系统,通过星座架构和专业支持代理组合,能够执行多项医疗相关的复杂任务。产品定位于提供与患者长时间、多轮次的语音对话,并提供专业准确的医疗建议。价格方面,按小时计费,每小时9美元。主要功能包括实时多轮语音对话、医疗信息提供和解释、隐私与合规性检查、药物管理和咨询、实验室与生命体征分析、营养建议、病历和政策查询、患者关系建设等。

直接科学回答医学问题

MediSearch是一个搜索引擎,为用户提供直接科学回答医学问题的能力。它汇集了来自可信医学来源的信息,帮助用户获取到科学、可靠的医疗信息。MediSearch的功能包括搜索医学问题、提供专业医学答案、解释医学术语、提供相关医学资讯等。它是医学领域的一站式信息查询工具。

Apollo是一个多语言医学领域的模型、数据集、基准和代码库

Apollo项目由FreedomIntelligence组织维护,旨在通过提供多语言医学领域的大型语言模型(LLMs)来民主化医疗AI,覆盖6亿人。该项目包括模型、数据集、基准测试和相关代码。

AI医疗助手,为您的医疗团队提供最佳支持

Azyri是一款AI医疗助手,通过骨龄测量和分析,为医疗团队提供准确的诊断和治疗建议。优势包括减轻医疗团队工作负担,提高工作效率,定价根据服务套餐而定。主要功能包括骨龄测量、诊断X射线、医学影像和机器智能分析。

医学AI能力开放共享平台

医真是一个医学AI能力开放共享平台。汇聚众多医学院校、科研院所、医疗机构、医疗企业的优秀医学AI产品和解决方案,通过开放接口的方式对外提供服务,助力众多行业以最便捷高效的方式获取医学AI能力,提升工作效率。

vivo自主研发的智能语言理解模型

蓝心大模型是vivo自主研发的智能语言理解模型,具有70亿模型参数量,可以处理32K上下文长度。它基于260TB的多语言训练语料,拥有强大的语言理解能力,可以广泛应用于内容创作、知识问答、逻辑推理、代码生成等场景,持续为用户提供安全可靠的人机交互体验。该模型已通过严格的安全合规检测,输出结果安全合规。

医疗领域检索式问答模型

MedRAG是一个针对医疗领域设计的检索式问答(Retrieval-Augmented Generation)模型。它结合了信息检索和文本生成技术,旨在提供准确的医疗信息查询和回答。

AI在医学领域的初步研究

o1 in Medicine是一个专注于医学领域的人工智能模型,旨在通过先进的语言模型技术,提升医学数据的处理能力和诊断准确性。该模型由UC Santa Cruz、University of Edinburgh和National Institutes of Health的研究人员共同开发,通过在多个医学数据集上的测试,展示了其在医学领域的应用潜力。o1模型的主要优点包括高准确率、多语言支持以及对复杂医学问题的深入理解能力。该模型的开发背景是基于当前医疗领域对于高效、准确的数据处理和分析的需求,尤其是在诊断和治疗建议方面。目前,该模型的研究和应用还处于初步阶段,但其在医学教育和临床实践中的应用前景广阔。

AI医疗研究工作室

Insight是一个AI驱动的医疗研究工作室,可以在几秒钟内完成医学研究。通过生成任务并利用AI的能力,Insight可以收集关于特定主题的信息,并生成相关输出。用户可以通过查看输出结果并运行更多任务来进一步研究感兴趣的主题。Insight提供用户注册功能,以保存和管理自己的研究目标。

© 2026 AIbase 备案号:闽ICP备08105208号-14