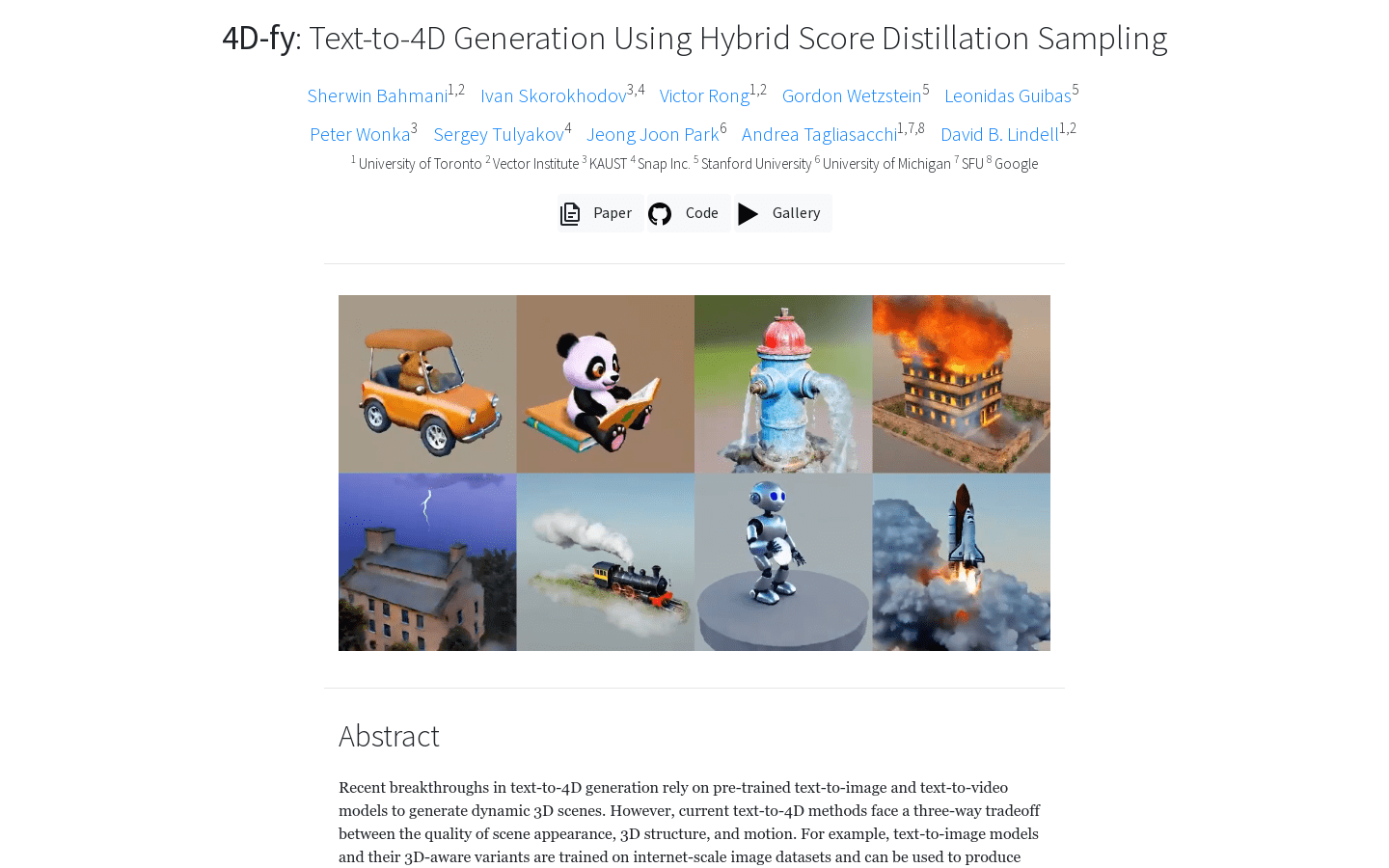

4D-fy是一种文本到4D生成方法,通过混合分数蒸馏采样技术,结合了多种预训练扩散模型的监督信号,实现了高保真的文本到4D场景生成。其方法通过神经表示参数化4D辐射场,使用静态和动态多尺度哈希表特征,并利用体积渲染从表示中渲染图像和视频。通过混合分数蒸馏采样,首先使用3D感知文本到图像模型(3D-T2I)的梯度来优化表示,然后结合文本到图像模型(T2I)的梯度来改善外观,最后结合文本到视频模型(T2V)的梯度来增加场景的运动。4D-fy可以生成具有引人入胜外观、3D结构和运动的4D场景。

需求人群:

"用于生成文本描述的高保真4D场景,可用于影视特效、虚拟现实等领域"

使用场景示例:

电影特效公司使用4D-fy生成火灾场景

虚拟现实游戏开发者使用4D-fy生成动态的虚拟场景

广告公司使用4D-fy生成具有吸引力外观和运动效果的产品展示

产品特色:

使用混合分数蒸馏采样技术实现高保真的文本到4D生成

参数化4D辐射场,使用静态和动态多尺度哈希表特征

渲染图像和视频,结合多种预训练扩散模型的监督信号

浏览量:116

最新流量情况

月访问量

195

平均访问时长

00:00:00

每次访问页数

1.02

跳出率

43.26%

流量来源

直接访问

44.69%

自然搜索

28.90%

邮件

0.08%

外链引荐

7.71%

社交媒体

17.16%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

美国

100.00%

高保真文本到4D生成

4D-fy是一种文本到4D生成方法,通过混合分数蒸馏采样技术,结合了多种预训练扩散模型的监督信号,实现了高保真的文本到4D场景生成。其方法通过神经表示参数化4D辐射场,使用静态和动态多尺度哈希表特征,并利用体积渲染从表示中渲染图像和视频。通过混合分数蒸馏采样,首先使用3D感知文本到图像模型(3D-T2I)的梯度来优化表示,然后结合文本到图像模型(T2I)的梯度来改善外观,最后结合文本到视频模型(T2V)的梯度来增加场景的运动。4D-fy可以生成具有引人入胜外观、3D结构和运动的4D场景。

4D场景创建工具,使用多视图视频扩散模型

CAT4D是一个利用多视图视频扩散模型从单目视频中生成4D场景的技术。它能够将输入的单目视频转换成多视角视频,并重建动态的3D场景。这项技术的重要性在于它能够从单一视角的视频资料中提取并重建出三维空间和时间的完整信息,为虚拟现实、增强现实以及三维建模等领域提供了强大的技术支持。产品背景信息显示,CAT4D由Google DeepMind、Columbia University和UC San Diego的研究人员共同开发,是一个前沿的科研成果转化为实际应用的案例。

创建可动的4D人像化身模型

CAP4D是一种利用可变形多视图扩散模型(Morphable Multi-View Diffusion Models)来创建4D人像化身的技术。它能够从任意数量的参考图像生成不同视角和表情的图像,并将其适配到一个4D化身上,该化身可以通过3DMM控制并实时渲染。这项技术的主要优点包括高度逼真的图像生成、多视角的适应性以及实时渲染的能力。CAP4D的技术背景是基于深度学习和图像生成领域的最新进展,尤其是在扩散模型和3D面部建模方面。由于其高质量的图像生成和实时渲染能力,CAP4D在娱乐、游戏开发、虚拟现实等领域具有广泛的应用前景。目前,该技术是免费提供代码的,但具体的商业化应用可能需要进一步的授权和定价。

从单张图片创建可控3D和4D场景的视频扩散模型

DimensionX是一个基于视频扩散模型的3D和4D场景生成技术,它能够从单张图片中创建出具有可控视角和动态变化的三维和四维场景。这项技术的主要优点包括高度的灵活性和逼真度,能够根据用户提供的提示词生成各种风格和主题的场景。DimensionX的背景信息显示,它是由一群研究人员共同开发的,旨在推动图像生成技术的发展。目前,该技术是免费提供给研究和开发社区使用的。

文本到3D分数蒸馏的方差缩减解决方案

SteinDreamer供文本到3D分数蒸馏的解决方案。他们提出了一种名为Stein Score Distillation (SSD)的方差缩减解决方案,通过控制变量构建和Stein身份,实现了对蒸馏方差的有效降低。他们的实验结果表明,SSD能够有效降低蒸馏方差,并且在对象和场景级别的生成中持续提高视觉质量。此外,他们还展示了SteinDreamer相对于现有方法具有更快的收敛速度。

从单目视频生成高质量4D对象的新型框架

DreamMesh4D是一个结合了网格表示与稀疏控制变形技术的新型框架,能够从单目视频中生成高质量的4D对象。该技术通过结合隐式神经辐射场(NeRF)或显式的高斯绘制作为底层表示,解决了传统方法在空间-时间一致性和表面纹理质量方面的挑战。DreamMesh4D利用现代3D动画流程的灵感,将高斯绘制绑定到三角网格表面,实现了纹理和网格顶点的可微优化。该框架开始于由单图像3D生成方法提供的粗糙网格,通过均匀采样稀疏点来构建变形图,以提高计算效率并提供额外的约束。通过两阶段学习,结合参考视图光度损失、得分蒸馏损失以及其他正则化损失,实现了静态表面高斯和网格顶点以及动态变形网络的学习。DreamMesh4D在渲染质量和空间-时间一致性方面优于以往的视频到4D生成方法,并且其基于网格的表示与现代几何流程兼容,展示了其在3D游戏和电影行业的潜力。

生成任何3D和4D场景的先进框架

GenXD是一个专注于3D和4D场景生成的框架,它利用日常生活中常见的相机和物体运动来联合研究一般的3D和4D生成。由于社区缺乏大规模的4D数据,GenXD首先提出了一个数据策划流程,从视频中获取相机姿态和物体运动强度。基于此流程,GenXD引入了一个大规模的现实世界4D场景数据集:CamVid-30K。通过利用所有3D和4D数据,GenXD框架能够生成任何3D或4D场景。它提出了多视图-时间模块,这些模块分离相机和物体运动,无缝地从3D和4D数据中学习。此外,GenXD还采用了掩码潜在条件,以支持多种条件视图。GenXD能够生成遵循相机轨迹的视频以及可以提升到3D表示的一致3D视图。它在各种现实世界和合成数据集上进行了广泛的评估,展示了GenXD在3D和4D生成方面与以前方法相比的有效性和多功能性。

从单一图像或文本生成可探索的3D场景

VividDream是一项创新技术,能够从单一输入图像或文本提示生成具有环境动态的可探索4D场景。它首先将输入图像扩展为静态3D点云,然后使用视频扩散模型生成动画视频集合,并通过优化4D场景表示来实现一致性运动和沉浸式场景探索。这项技术为生成基于多样真实图像和文本提示的引人入胜的4D体验提供了可能。

4D重建模型,快速生成动画对象

L4GM是一个4D大型重建模型,能够从单视图视频输入中快速生成动画对象。它采用了一种新颖的数据集,包含多视图视频,这些视频展示了Objaverse中渲染的动画对象。该数据集包含44K种不同的对象和110K个动画,从48个视角渲染,生成了12M个视频,总共包含300M帧。L4GM基于预训练的3D大型重建模型LGM构建,该模型能够从多视图图像输入中输出3D高斯椭球。L4GM输出每帧的3D高斯Splatting表示,然后将其上采样到更高的帧率以实现时间平滑。此外,L4GM还添加了时间自注意力层,以帮助学习时间上的一致性,并使用每个时间步的多视图渲染损失来训练模型。

通过文本生成3D场景中的对象插入

InseRF是一种通过文本提示和2D边界框在NeRF重建的3D场景中生成新对象的方法。它能够从用户提供的文本描述和一个参考视点中的2D边界框中生成新的3D对象,并将其插入到场景中。该方法能够在不需要显式3D信息的情况下实现可控的、与3D一致的对象插入。通过在多个3D场景中进行试验,证明了InseRF方法相对于现有方法的有效性。

文本引导的高保真3D场景合成

SceneWiz3D是一种新颖的方法,可以从文本中合成高保真的3D场景。它采用混合的3D表示,对对象采用显式表示,对场景采用隐式表示。用户可以通过传统的文本到3D方法或自行提供对象来生成对象。为了配置场景布局并自动放置对象,我们在优化过程中应用了粒子群优化技术。此外,在文本到场景的情况下,对于场景的某些部分(例如角落、遮挡),很难获得多视角监督,导致几何形状劣质。为了缓解这种监督缺失,我们引入了RGBD全景扩散模型作为额外先验,从而实现了高质量的几何形状。广泛的评估支持我们的方法实现了比以前的方法更高的质量,可以生成详细且视角一致的3D场景。

文本到3D沉浸场景生成

Text2Immersion是一个优雅的从文本提示生成高质量3D沉浸场景的方法。我们提出的流水线首先使用预训练的2D扩散和深度估计模型逐步生成高斯云。接下来是对高斯云进行精炼,插值和精炼以增强生成场景的细节。与仅关注单个物体或室内场景,或采用缩小轨迹的主流方法不同,我们的方法可以生成包含各种物体的不同场景,甚至扩展到创造想象中的场景。因此,Text2Immersion可以对各种应用产生广泛的影响,如虚拟现实、游戏开发和自动内容创建。大量的评估证明我们的系统在渲染质量和多样性方面优于其他方法,并且继续推进面向文本的3D场景生成。

MistralAI的新8x7B混合专家(MoE)基础模型,用于文本生成

MistralAI的新8x7B混合专家(MoE)基础模型,用于文本生成。该模型使用混合专家架构,可以生成高质量的文本。该模型的优势是可以生成高质量的文本,可以用于各种文本生成任务。该模型的定价是根据使用情况而定,具体可以参考官方网站。该模型的定位是为了解决文本生成任务中的问题。

稳定扩散:距离快速多样的文本生成3D仅一步之遥

HexaGen3D是一种用于从文本提示生成高质量3D资产的创新方法。它利用大型预训练的2D扩散模型,通过微调预训练的文本到图像模型来联合预测6个正交投影和相应的潜在三面体,然后解码这些潜在值以生成纹理网格。HexaGen3D不需要每个样本的优化,可在7秒内从文本提示中推断出高质量且多样化的对象,相较于现有方法,提供了更好的质量与延迟权衡。此外,HexaGen3D对于新对象或组合具有很强的泛化能力。

从单目视频重建时间一致的4D人体模型

DressRecon是一个用于从单目视频重建时间一致的4D人体模型的方法,专注于处理非常宽松的服装或手持物体交互。该技术结合了通用的人体先验知识(从大规模训练数据中学习得到)和针对单个视频的特定“骨骼袋”变形(通过测试时优化进行拟合)。DressRecon通过学习一个神经隐式模型来分离身体与服装变形,作为单独的运动模型层。为了捕捉服装的微妙几何形状,它利用基于图像的先验知识,如人体姿势、表面法线和光流,在优化过程中进行调整。生成的神经场可以提取成时间一致的网格,或者进一步优化为显式的3D高斯,以提高渲染质量和实现交互式可视化。DressRecon在包含高度挑战性服装变形和物体交互的数据集上,提供了比以往技术更高的3D重建保真度。

70亿参数的文本生成模型

Llama-lynx-70b-4bitAWQ是一个由Hugging Face托管的70亿参数的文本生成模型,使用了4-bit精度和AWQ技术。该模型在自然语言处理领域具有重要性,特别是在需要处理大量数据和复杂任务时。它的优势在于能够生成高质量的文本,同时保持较低的计算成本。产品背景信息显示,该模型与'transformers'和'safetensors'库兼容,适用于文本生成任务。

Formy 3D可将照片、文本快速转化为专业3D模型

Formy 3D是一款先进的AI 3D生成器,于2024年创立。它利用拥有100亿参数的扩散模型技术,能理解自然语言和视觉参考,将文本描述和图像转化为高质量3D模型。与传统3D建模软件不同,它无需专业经验,即可在几分钟内创建出专业的3D资产。该平台提供免费的基础计划,也有每月24.99美元的Plus计划,适用于需要快速创建3D模型的个人和企业。

利用GPT-4进行文本生成的扩展

Side-GPT for Edge是一款利用GPT-4技术进行文本生成的扩展。它可以帮助用户回答问题和生成文本。该扩展具有强大的文本生成能力,可以用于写作、翻译、聊天等场景。该扩展使用简单方便,用户只需输入问题或文本,即可获得生成的结果。Side-GPT for Edge是一款功能强大、易于使用的文本生成工具。

单文本/图像生成可导航3D场景

LucidDreamer是一种无域3D场景生成技术,通过充分利用现有大规模扩散生成模型的能力,可以从单个文本提示或单个图像生成可导航的3D场景。该方法具有梦境和对齐两个交替步骤,首先根据输入生成多视角一致的图像,然后将新生成的3D场景部分和谐地整合在一起。LucidDreamer生成的高度详细的高斯斑点与以往的3D场景生成方法相比没有目标场景域的限制。

扩展3D场景生成模型

BlockFusion是一种基于扩散的模型,可以生成3D场景,并无缝地将新的块整合到场景中。它通过对随机裁剪自完整3D场景网格的3D块数据集进行训练。通过逐块拟合,所有训练块都被转换为混合神经场:其中包含几何特征的三面体,然后是用于解码有符号距离值的多层感知器(MLP)。变分自动编码器用于将三面体压缩到潜在的三面体空间,对其进行去噪扩散处理。扩散应用于潜在表示,可以实现高质量和多样化的3D场景生成。在生成过程中扩展场景时,只需附加空块以与当前场景重叠,并外推现有的潜在三面体以填充新块。外推是通过在去噪迭代过程中使用来自重叠三面体的特征样本来调节生成过程完成的。潜在三面体外推产生语义和几何上有意义的过渡,与现有场景和谐地融合。使用2D布局调节机制来控制场景元素的放置和排列。实验结果表明,BlockFusion能够生成多样化、几何一致且质量高的室内外大型3D场景。

混合专家模型,性能优于单个专家模型

phixtral-2x2_8是第一个由两个microsoft/phi-2模型制作的混合专家模型,受到mistralai/Mixtral-8x7B-v0.1架构的启发。其性能优于每个单独的专家模型。该模型在AGIEval、GPT4All、TruthfulQA、Bigbench等多个评估指标上表现优异。它采用了自定义版本的mergekit库(mixtral分支)和特定配置。用户可以在Colab notebook上以4位精度在免费的T4 GPU上运行Phixtral。模型大小为4.46B参数,张量类型为F16。

高质量文本到3D角色生成

Make-A-Character(Mach)是一个用户友好的框架,旨在从文本描述中创建栩栩如生的3D头像。该框架利用大型语言和视觉模型的力量进行文本意图理解和中间图像生成,然后经过一系列面向人的视觉感知和3D生成模块。我们的系统提供了一种直观的方法,让用户在2分钟内打造可控、逼真、完全实现的3D角色,同时还能轻松与现有的CG流水线进行集成,实现动态表现。

3D纹理生成技术,根据文本描述合成3D纹理

TexGen是一个创新的多视角采样和重采样框架,用于根据任意文本描述合成3D纹理。它利用预训练的文本到图像的扩散模型,通过一致性视图采样和注意力引导的多视角采样策略,以及噪声重采样技术,显著提高了3D对象的纹理质量,具有高度的视角一致性和丰富的外观细节。

AI模型,动态多角度视频生成。

Stable Video 4D是Stability AI最新推出的AI模型,它能够将单个对象视频转换成八个不同角度/视图的多个新颖视图视频。这项技术代表了从基于图像的视频生成到完整的3D动态视频合成的能力飞跃。它在游戏开发、视频编辑和虚拟现实等领域具有潜在的应用前景,并且正在不断优化中。

70亿参数的量化文本生成模型

Llama-Lynx-70b-4bit-Quantized是由PatronusAI开发的一个大型文本生成模型,具有70亿参数,并且经过4位量化处理,以优化模型大小和推理速度。该模型基于Hugging Face的Transformers库构建,支持多种语言,特别是在对话生成和文本生成领域表现出色。它的重要性在于能够在保持较高性能的同时减少模型的存储和计算需求,使得在资源受限的环境中也能部署强大的AI模型。

文本驱动的3D头像生成与全身动画表达

DreamWaltz-G是一个创新的框架,用于从文本驱动生成3D头像和表达性的全身动画。它的核心是骨架引导的评分蒸馏和混合3D高斯头像表示。该框架通过整合3D人类模板的骨架控制到2D扩散模型中,提高了视角和人体姿势的一致性,从而生成高质量的头像,解决了多重面孔、额外肢体和模糊等问题。此外,混合3D高斯头像表示通过结合神经隐式场和参数化3D网格,实现了实时渲染、稳定的SDS优化和富有表现力的动画。DreamWaltz-G在生成和动画3D头像方面非常有效,无论是视觉质量还是动画表现力都超越了现有方法。此外,该框架还支持多种应用,包括人类视频重演和多主题场景组合。

Google Genie 4可免费将文本转化为720p、24 FPS的实时交互式3D世界

Genie 4是由Google和DeepMind技术支持的免费AI世界模型生成器。它可以将文本或图像转化为实时交互式3D世界,无需设计经验。该产品定位为面向研究人员和创作者,适用于研究、教育、创意等多个领域,在实时世界生成方面具有显著优势,目前提供免费使用。

ComfyUI的轨迹一致性蒸馏(TCD)采样插件

这是一款ComfyUI的自定义采样器插件节点,实现了Zheng等人提出的基于轨迹一致性蒸馏(TCD)的采样方法。插件为ComfyUI的Custom Sampler类别增加了TCDScheduler和SamplerTCD节点。只需将其克隆到custom_nodes文件夹中,重启ComfyUI即可使用。TCDScheduler有一个特殊参数eta,用于控制每一步的随机性。当eta=0时表示确定性采样,eta=1时表示完全随机采样。默认值为0.3,但在增加推理步数时建议使用更高的eta值。该插件基于轨迹一致性蒸馏采样方法,可为AI模型提供更加平滑和一致的输出结果。

© 2026 AIbase 备案号:闽ICP备08105208号-14