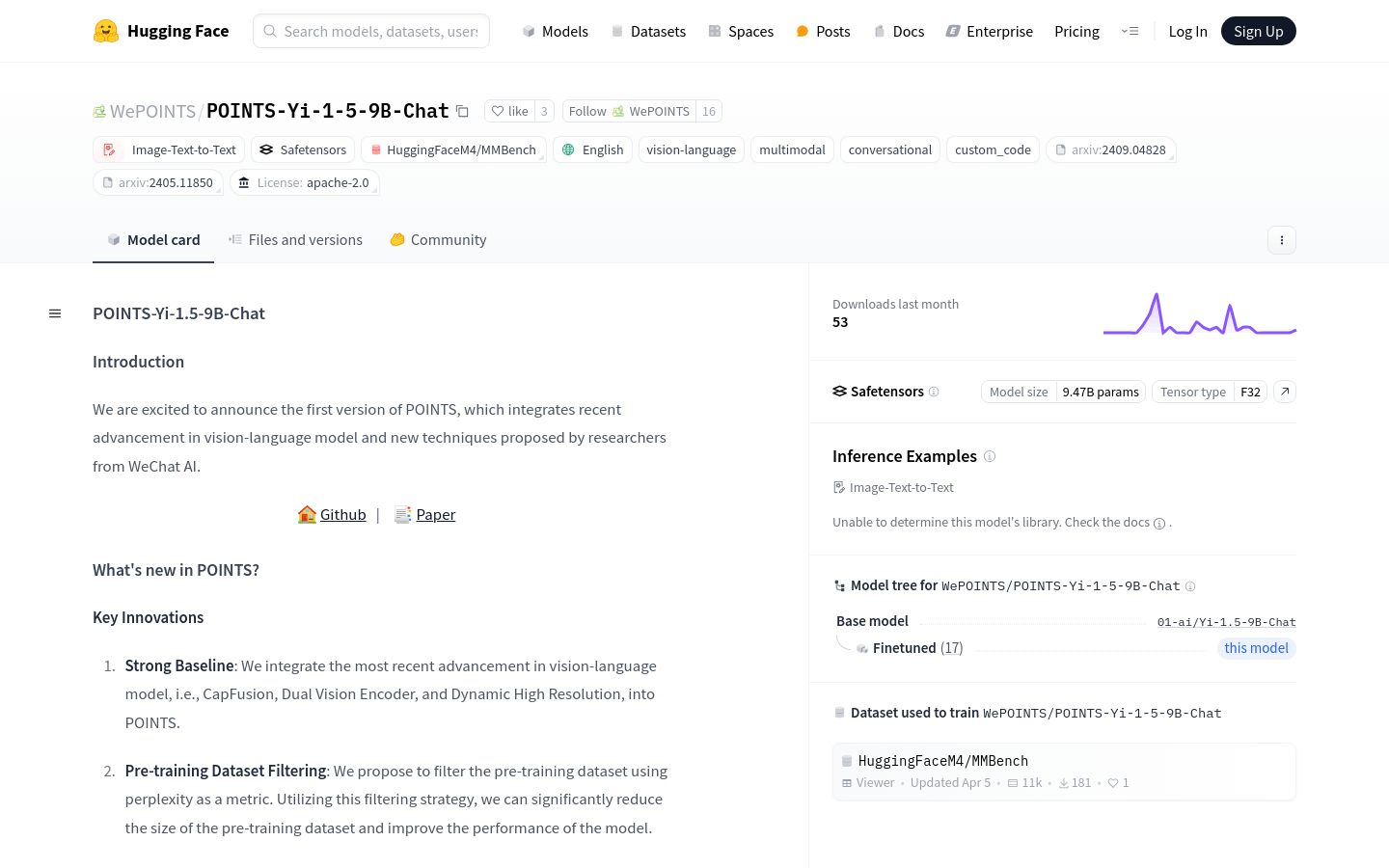

POINTS-Yi-1.5-9B-Chat是一个视觉语言模型,它集成了最新的视觉语言模型技术和微信AI提出的新技术。该模型在预训练数据集过滤、模型汤(Model Soup)技术等方面有显著创新,能够显著减少预训练数据集的大小并提高模型性能。它在多个基准测试中表现优异,是视觉语言模型领域的一个重要进展。

需求人群:

"目标受众为研究人员、开发者和企业,特别是那些需要在视觉语言领域进行模型训练和应用的专业人士。该产品通过提供先进的视觉语言模型技术和优化策略,帮助用户提高模型性能,减少计算资源消耗,加速研发进程。"

使用场景示例:

在图像描述任务中,使用POINTS-Yi-1.5-9B-Chat生成详细的图像描述。

在视觉问答任务中,利用模型回答与图像相关的问题。

在视觉指令执行任务中,根据用户提供的图像和指令,模型执行相应的操作。

产品特色:

集成最新的视觉语言模型技术,如CapFusion、Dual Vision Encoder和Dynamic High Resolution。

使用困惑度作为指标过滤预训练数据集,减少数据集大小并提高模型性能。

应用模型汤技术,对不同视觉指令调整数据集微调后的模型进行整合,进一步提升性能。

在多个基准测试中表现优异,包括MMBench-dev-en、MathVista、HallucinationBench等。

支持Image-Text-to-Text的多模态交互,适用于需要视觉和语言结合的场景。

提供了详细的使用示例和代码,方便开发者快速上手和集成。

使用教程:

1. 安装必要的库,如transformers、PIL和torch。

2. 导入AutoModelForCausalLM和AutoTokenizer,以及CLIPImageProcessor。

3. 准备图像数据,可以是网络图片或本地。图片。

4. 加载模型和分词器,指定模型路径为'WePOINTS/POINTS-Yi-1-5-9B-Chat'。

5. 配置生成参数,如最大新令牌数、温度、top_p和beam数。

6. 使用模型的chat方法,传入图像、提示、分词器、图像处理器等参数。

7. 获取模型输出并打印结果。

浏览量:29

最新流量情况

月访问量

25633.38k

平均访问时长

00:04:53

每次访问页数

5.77

跳出率

44.05%

流量来源

直接访问

49.07%

自然搜索

35.64%

邮件

0.03%

外链引荐

12.38%

社交媒体

2.75%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

14.36%

印度

8.76%

韩国

3.61%

俄罗斯

5.25%

美国

16.65%

视觉语言模型的最新进展,集成微信AI的新技术

POINTS-Yi-1.5-9B-Chat是一个视觉语言模型,它集成了最新的视觉语言模型技术和微信AI提出的新技术。该模型在预训练数据集过滤、模型汤(Model Soup)技术等方面有显著创新,能够显著减少预训练数据集的大小并提高模型性能。它在多个基准测试中表现优异,是视觉语言模型领域的一个重要进展。

提供多种预训练模型,支持多维度筛选,助力AI模型应用与开发。

该平台是一个专注于AI预训练模型的资源平台,整合了大量不同类型、规模和应用场景的预训练模型。其重要性在于为AI开发者和研究人员提供了便捷的模型获取渠道,降低了模型开发的门槛。主要优点包括模型分类细致、多维度筛选功能强大、信息展示详细且提供智能推荐。产品背景是随着AI技术的发展,对预训练模型的需求日益增长,平台应运而生。平台主要定位为AI模型资源平台,部分模型免费商用,部分可能需要付费,具体价格因模型而异。

轻量级服务器,连接微信读书与 Claude Desktop。

微信读书 MCP 服务器是一个桥接微信读书数据和 Claude Desktop 的轻量级服务器,旨在实现阅读笔记与 AI 的深度交互。此产品利用 MCP 协议,无缝整合阅读数据,提供实时访问功能,极大提升用户的阅读效率与信息管理能力。

大型多语言预训练语言模型

Meta Llama 3.1-405B 是由 Meta 开发的一系列大型多语言预训练语言模型,包含8B、70B和405B三种规模的模型。这些模型经过优化的变压器架构,使用监督式微调(SFT)和强化学习与人类反馈(RLHF)进行调优,以符合人类对帮助性和安全性的偏好。Llama 3.1 模型支持多种语言,包括英语、德语、法语、意大利语、葡萄牙语、印地语、西班牙语和泰语。该模型在多种自然语言生成任务中表现出色,并在行业基准测试中超越了许多现有的开源和封闭聊天模型。

多语言预训练语言模型

「书生·浦语2.0」InternLM2是一个面向中文和英文的大型多语言预训练语言模型。它具有语言理解、自然语言生成、多模式推理、代码理解等强大的能力。模型采用Transformer架构并进行海量数据的预训练,在长文本理解、对话、数学运算等多个方向上都达到了业界领先水平。该系列模型包含多种规模,用户可以选择合适的模型进行下游任务微调或构建聊天机器人等应用。

基于 Transformer 的预训练语言模型系列

Qwen1.5 是基于 Transformer 架构的解码器语言模型系列,包括不同规模的模型。具有 SwiGLU 激活、注意力 QKV 偏置、组查询注意力等特性。支持多种自然语言和代码。推荐进行后续训练,如 SFT、RLHF 等。定价免费。

开源的中英双语预训练语言模型

LingoWhale-8B是一个开源的大规模中英双语预训练语言模型,具有强大的自然语言理解和生成能力。它通过在海量高质量中英文数据上进行预训练,可以完成长文本的理解和多轮交互。该模型采用Transformer架构,参数量达80亿。它在多个中文和英文公开基准测试上都取得了领先的效果。LingoWhale-8B完全开放给学术研究使用,个人开发者可以免费用于商业用途。该模型可以广泛应用于聊天机器人、知识问答、文本生成等领域。

谷歌推出的开源预训练语言模型

Gemma-2b是谷歌推出的开源预训练语言模型系列,提供了多个不同规模的变体。它可以生成高质量的文本,广泛应用于问答、摘要、推理等领域。相比其他同类模型,它模型规模较小,可以部署在不同的硬件环境中。Gemma系列追求安全、高效的人工智能技术,使更多研究者和开发者可以接触前沿的语言模型技术。

大规模自回归图像模型预训练

这篇论文介绍了AIM,这是一组使用自回归目标进行预训练的视觉模型。这些模型受其文本对应物,即大型语言模型(LLMs)的启发,并表现出类似的扩展特性。具体来说,我们强调了两个关键发现:(1)视觉特征的性能随着模型容量和数据量的增加而提高,(2)目标函数的价值与模型在下游任务上的性能相关。我们通过在20亿张图像上对70亿参数的AIM进行预训练,实现了在ImageNet-1k上使用冻结主干达到84.0%的准确率。有趣的是,即使在这个规模上,我们观察到性能没有饱和的迹象,这表明AIM可能代表了训练大规模视觉模型的新前沿。AIM的预训练类似于LLMs的预训练,并不需要任何图像特定的策略来稳定大规模训练。

70B参数的多语言大型预训练语言模型

Meta Llama 3.3是一个70B参数的多语言大型预训练语言模型(LLM),专为多语言对话用例优化,并在常见行业基准测试中表现优于许多现有的开源和封闭聊天模型。该模型采用优化的Transformer架构,并使用监督式微调(SFT)和基于人类反馈的强化学习(RLHF)来符合人类的有用性和安全性偏好。

多模态大型语言模型,融合视觉与语言理解。

InternVL2_5-26B是一个先进的多模态大型语言模型(MLLM),在InternVL 2.0的基础上,通过引入显著的训练和测试策略增强以及数据质量提升,进一步发展而来。该模型保持了其前身的“ViT-MLP-LLM”核心模型架构,并集成了新增量预训练的InternViT与各种预训练的大型语言模型(LLMs),例如InternLM 2.5和Qwen 2.5,使用随机初始化的MLP投影器。InternVL 2.5系列模型在多模态任务中展现出卓越的性能,尤其在视觉感知和多模态能力方面。

文档智能的视觉引导生成文本布局预训练模型

ViTLP是一个视觉引导的生成文本布局预训练模型,旨在提高文档智能处理的效率和准确性。该模型结合了OCR文本定位和识别功能,能够在文档图像上进行快速准确的文本检测和识别。ViTLP模型的预训练版本ViTLP-medium(380M参数)在计算资源和预训练数据集规模的限制下,提供了一个平衡的解决方案,既保证了模型的性能,又优化了推理速度和内存使用。ViTLP的推理速度在Nvidia 4090上处理一页文档图像通常在5到10秒内,与大多数OCR引擎相比具有竞争力。

基于语言模型架构的预训练时间序列预测模型

Chronos是一系列基于语言模型架构的预训练时间序列预测模型。时间序列通过缩放和量化转换为一系列标记,然后使用交叉熵损失训练语言模型。训练完成后,通过给定历史上下文采样多个未来轨迹,获得概率性预测。Chronos模型已经在大量公开可用的时间序列数据和使用高斯过程生成的合成数据上进行了训练。

基于预训练的纯视觉变换器提升图像抠图

ViTMatte是一个基于预训练纯视觉变换器(Plain Vision Transformers, ViTs)的图像抠图系统。它利用混合注意力机制和卷积颈部来优化性能与计算之间的平衡,并引入了细节捕获模块以补充抠图所需的细节信息。ViTMatte是首个通过简洁的适配释放ViT在图像抠图领域潜力的工作,继承了ViT在预训练策略、简洁的架构设计和灵活的推理策略等方面的优势。在Composition-1k和Distinctions-646这两个最常用的图像抠图基准测试中,ViTMatte达到了最先进的性能,并以较大优势超越了先前的工作。

开源多模态预训练模型,具备中英双语对话能力。

GLM-4V-9B是智谱AI推出的新一代预训练模型,支持1120*1120高分辨率下的中英双语多轮对话,以及视觉理解能力。在多模态评测中,GLM-4V-9B展现出超越GPT-4-turbo-2024-04-09、Gemini 1.0 Pro、Qwen-VL-Max和Claude 3 Opus的卓越性能。

新一代多语言预训练模型,性能卓越。

Qwen2是一系列经过预训练和指令调整的模型,支持多达27种语言,包括英语和中文。这些模型在多个基准测试中表现出色,特别是在编码和数学方面有显著提升。Qwen2模型的上下文长度支持高达128K个token,适用于处理长文本任务。此外,Qwen2-72B-Instruct模型在安全性方面与GPT-4相当,显著优于Mistral-8x22B模型。

多语言预训练数据集

FineWeb2是由Hugging Face提供的一个大规模多语言预训练数据集,覆盖超过1000种语言。该数据集经过精心设计,用于支持自然语言处理(NLP)模型的预训练和微调,特别是在多种语言上。它以其高质量、大规模和多样性而闻名,能够帮助模型学习跨语言的通用特征,提升在特定语言任务上的表现。FineWeb2在多个语言的预训练数据集中表现出色,甚至在某些情况下,比一些专门为单一语言设计的数据库表现更好。

新一代开源预训练模型,支持多语言和高级功能

GLM-4-9B是智谱AI推出的新一代预训练模型,属于GLM-4系列中的开源版本。它在语义、数学、推理、代码和知识等多方面的数据集测评中表现优异,具备多轮对话、网页浏览、代码执行、自定义工具调用和长文本推理等高级功能。此外,还支持包括日语、韩语、德语在内的26种语言,并有支持1M上下文长度的模型版本。

使用预训练扩散模型制作视觉错觉

Visual Anagrams是一种简单的、零样本方法,用于生成多视角视觉错觉。我们展示了理论和实践证明,我们的方法支持广泛的变换,包括旋转、翻转、颜色反转、倾斜、拼图重排和随机排列等。我们的方法使用预训练扩散模型来估计图像的不同视角或变换中的噪声,并将其对齐并平均。然后使用这个平均噪声估计来进行扩散步骤。使用Visual Anagrams,您可以制作出多种多视角视觉错觉。

WeLM Playground是一款开源的大型中文语言模型聊天工具

WeLM Playground是基于开源中文语言模型WeLM的在线聊天 Demo,用户可以通过网页与 AI 对话、获取写作帮助。它提供稳定流畅的语言生成,支持自由聊天、话题控制、长篇闲聊、文本续写等功能。作为 Anthropic 公司开源的大模型之一,WeLM Playground 完全免费,代码开源,用户无需注册即可使用。它旨在让普通用户也能安全便捷地体验 LLM 对话带来的便利。

快速、便捷的 ChatGPT Plus/Pro 充值服务,支持微信支付。

PayForChat 是专为中国用户打造的 ChatGPT 充值平台,解决了用户无法使用海外信用卡的问题。通过正规渠道,用户可以快速充值 Plus 或 Pro 服务,月卡和年卡选择灵活,确保安全且无封号风险。充值失败全额退款,成功率超过 99%。月卡价格为 ¥179,年卡价格为 ¥1280,Pro 月卡为 ¥1584,满足不同用户需求。

第二代多模态预训练对话模型

CogVLM2是由清华大学团队开发的第二代多模态预训练对话模型,它在多个基准测试中取得了显著的改进,支持8K内容长度和1344*1344的图像分辨率。CogVLM2系列模型提供了支持中文和英文的开源版本,能够与一些非开源模型相媲美的性能。

由Google Research开发的预训练时间序列预测模型。

TimesFM是一个由Google Research开发的预训练时间序列预测模型,用于时间序列预测任务。该模型在多个数据集上进行了预训练,能够处理不同频率和长度的时间序列数据。其主要优点包括高性能、可扩展性强以及易于使用。该模型适用于需要准确预测时间序列数据的各种应用场景,如金融、气象、能源等领域。该模型在Hugging Face平台上免费提供,用户可以方便地下载和使用。

新一代开源预训练模型,支持多轮对话和多语言。

GLM-4-9B-Chat-1M 是智谱 AI 推出的新一代预训练模型,属于 GLM-4 系列的开源版本。它在语义、数学、推理、代码和知识等多方面的数据集测评中展现出较高的性能。该模型不仅支持多轮对话,还具备网页浏览、代码执行、自定义工具调用和长文本推理等高级功能。支持包括日语、韩语、德语在内的26种语言,并特别推出了支持1M上下文长度的模型版本,适合需要处理大量数据和多语言环境的开发者和研究人员使用。

通过微博分析用户性格的AI服务

微博AI嘴替是一款基于微博平台的AI服务,能够分析用户的微博内容,从而推测出用户的性格特征。这项技术结合了自然语言处理和机器学习,通过分析用户的语言风格、话题偏好等信息,为用户提供个性化的性格分析报告。AI嘴替的主要优点在于其新颖性、趣味性以及对用户性格的深入洞察。

大规模多模态预训练数据集

allenai/olmo-mix-1124数据集是由Hugging Face提供的一个大规模多模态预训练数据集,主要用于训练和优化自然语言处理模型。该数据集包含了大量的文本信息,覆盖了多种语言,并且可以用于各种文本生成任务。它的重要性在于提供了一个丰富的资源,使得研究人员和开发者能够训练出更加精准和高效的语言模型,进而推动自然语言处理技术的发展。

© 2026 AIbase 备案号:闽ICP备08105208号-14