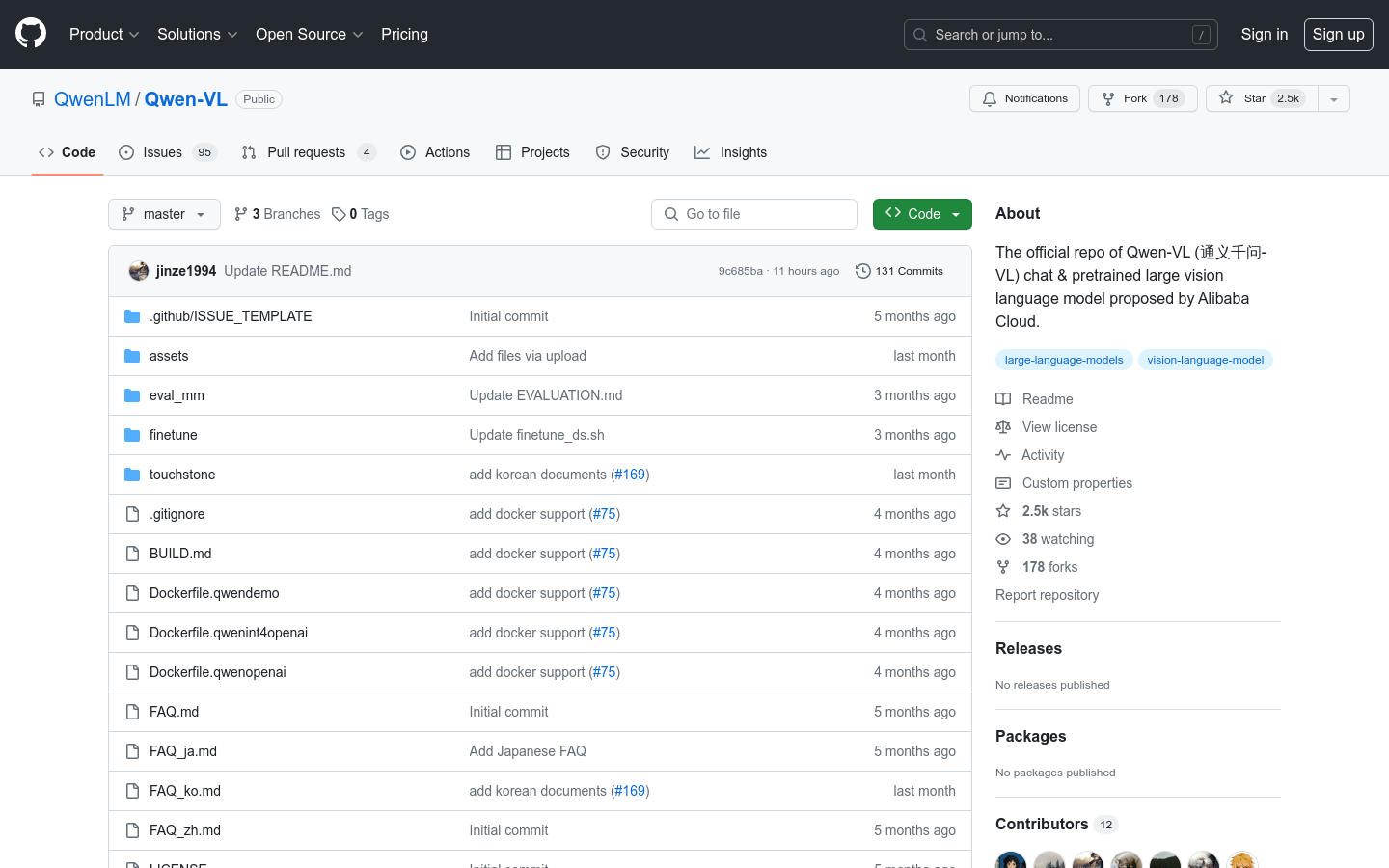

Qwen-VL 是阿里云推出的通用型视觉语言模型,具有强大的视觉理解和多模态推理能力。它支持零样本图像描述、视觉问答、文本理解、图像地标定位等任务,在多个视觉基准测试中达到或超过当前最优水平。该模型采用 Transformer 结构,以 7B 参数规模进行预训练,支持 448x448 分辨率,可以端到端处理图像与文本的多模态输入与输出。Qwen-VL 的优势包括通用性强、支持多语种、细粒度理解等。它可以广泛应用于图像理解、视觉问答、图像标注、图文生成等任务。

需求人群:

["图像理解","视觉问答","图像标注","图文生成"]

使用场景示例:

将图片描述成文字

回答关于图片的问题

理解图片中的文字信息

产品特色:

零样本图像描述

视觉问答

文本理解

图像地标定位

多语言支持

细粒度图像理解

浏览量:709

最新流量情况

月访问量

4.93m

平均访问时长

00:06:29

每次访问页数

6.10

跳出率

36.08%

流量来源

直接访问

54.82%

自然搜索

31.76%

邮件

0.04%

外链引荐

11.31%

社交媒体

1.86%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.56%

德国

3.93%

印度

9.82%

俄罗斯

5.43%

美国

18.51%

通用型视觉语言模型

Qwen-VL 是阿里云推出的通用型视觉语言模型,具有强大的视觉理解和多模态推理能力。它支持零样本图像描述、视觉问答、文本理解、图像地标定位等任务,在多个视觉基准测试中达到或超过当前最优水平。该模型采用 Transformer 结构,以 7B 参数规模进行预训练,支持 448x448 分辨率,可以端到端处理图像与文本的多模态输入与输出。Qwen-VL 的优势包括通用性强、支持多语种、细粒度理解等。它可以广泛应用于图像理解、视觉问答、图像标注、图文生成等任务。

深入理解Transformer模型的可视化工具

Transformer Explainer是一个致力于帮助用户深入理解Transformer模型的在线可视化工具。它通过图形化的方式展示了Transformer模型的各个组件,包括自注意力机制、前馈网络等,让用户能够直观地看到数据在模型中的流动和处理过程。该工具对于教育和研究领域具有重要意义,可以帮助学生和研究人员更好地理解自然语言处理领域的先进技术。

基于 Transformer 的图像识别模型

Google Vision Transformer 是一款基于 Transformer 编码器的图像识别模型,使用大规模图像数据进行预训练,可用于图像分类等任务。该模型在 ImageNet-21k 数据集上进行了预训练,并在 ImageNet 数据集上进行了微调,具备良好的图像特征提取能力。该模型通过将图像切分为固定大小的图像块,并线性嵌入这些图像块来处理图像数据。同时,模型在输入序列前添加了位置编码,以便在 Transformer 编码器中处理序列数据。用户可以通过在预训练的编码器之上添加线性层进行图像分类等任务。Google Vision Transformer 的优势在于其强大的图像特征学习能力和广泛的适用性。该模型免费提供使用。

多模态大型语言模型,融合视觉与语言理解。

InternVL2_5-26B是一个先进的多模态大型语言模型(MLLM),在InternVL 2.0的基础上,通过引入显著的训练和测试策略增强以及数据质量提升,进一步发展而来。该模型保持了其前身的“ViT-MLP-LLM”核心模型架构,并集成了新增量预训练的InternViT与各种预训练的大型语言模型(LLMs),例如InternLM 2.5和Qwen 2.5,使用随机初始化的MLP投影器。InternVL 2.5系列模型在多模态任务中展现出卓越的性能,尤其在视觉感知和多模态能力方面。

基于 Transformer 的预训练语言模型系列

Qwen1.5 是基于 Transformer 架构的解码器语言模型系列,包括不同规模的模型。具有 SwiGLU 激活、注意力 QKV 偏置、组查询注意力等特性。支持多种自然语言和代码。推荐进行后续训练,如 SFT、RLHF 等。定价免费。

大规模训练 Transformer 模型的持续研究

Megatron-LM 是由 NVIDIA 应用深度学习研究团队开发的一种强大的大规模 Transformer 模型。该产品用于大规模训练 Transformer 语言模型的持续研究。我们使用混合精度,高效的模型并行和数据并行,以及多节点的 Transformer 模型(如 GPT、BERT 和 T5)的预训练。

分析Transformer语言模型的内部工作机制

LLM Transparency Tool(LLM-TT)是一个开源的交互式工具包,用于分析基于Transformer的语言模型的内部工作机制。它允许用户选择模型、添加提示并运行推理,通过可视化的方式展示模型的注意力流动和信息传递路径。该工具旨在提高模型的透明度,帮助研究人员和开发者更好地理解和改进语言模型。

强大的开源视觉语言模型

CogVLM是一个强大的开源视觉语言模型。CogVLM-17B拥有100亿个视觉参数和70亿个语言参数。CogVLM-17B在10个经典的跨模态基准测试中取得了最先进的性能,包括NoCaps、Flicker30k字幕、RefCOCO、RefCOCO+、RefCOCOg、Visual7W、GQA、ScienceQA、VizWiz VQA和TDIUC,并在VQAv2、OKVQA、TextVQA、COCO字幕等方面排名第二,超过或与PaLI-X 55B相匹配。CogVLM还可以与您就图像进行对话。

大型视频语言模型,提供视觉问答和视频字幕生成。

VideoLLaMA2-7B-Base 是由 DAMO-NLP-SG 开发的大型视频语言模型,专注于视频内容的理解与生成。该模型在视觉问答和视频字幕生成方面展现出卓越的性能,通过先进的空间时间建模和音频理解能力,为用户提供了一种新的视频内容分析工具。它基于 Transformer 架构,能够处理多模态数据,结合文本和视觉信息,生成准确且富有洞察力的输出。

PaliGemma 2是一个强大的视觉-语言模型,支持多种视觉语言任务。

PaliGemma 2是一个由Google开发的视觉-语言模型,继承了Gemma 2模型的能力,能够处理图像和文本输入并生成文本输出。该模型在多种视觉语言任务上表现出色,如图像描述、视觉问答等。其主要优点包括强大的多语言支持、高效的训练架构和广泛的适用性。该模型适用于需要处理视觉和文本数据的各种应用场景,如社交媒体内容生成、智能客服等。

多模态视觉语言模型

MouSi是一种多模态视觉语言模型,旨在解决当前大型视觉语言模型(VLMs)面临的挑战。它采用集成专家技术,将个体视觉编码器的能力进行协同,包括图像文本匹配、OCR、图像分割等。该模型引入融合网络来统一处理来自不同视觉专家的输出,并在图像编码器和预训练LLMs之间弥合差距。此外,MouSi还探索了不同的位置编码方案,以有效解决位置编码浪费和长度限制的问题。实验结果表明,具有多个专家的VLMs表现出比孤立的视觉编码器更出色的性能,并随着整合更多专家而获得显著的性能提升。

高效开源的视觉语言模型

SmolVLM是一个小型但功能强大的视觉语言模型(VLM),拥有2B参数,以其较小的内存占用和高效性能在同类模型中处于领先地位。SmolVLM完全开源,包括所有模型检查点、VLM数据集、训练配方和工具均在Apache 2.0许可下发布。该模型适合在浏览器或边缘设备上进行本地部署,降低推理成本,并允许用户自定义。

开源视觉基础模型

InternVL通过将ViT模型扩展到60亿参数并与语言模型对齐,构建出目前最大的14B开源视觉基础模型,在视觉感知、跨模态检索、多模态对话等广泛任务上取得了32项state-of-the-art性能。

扩展Transformer模型处理无限长输入

Google开发的“Infini-attention”技术旨在扩展基于Transformer的大语言模型以处理无限长的输入,通过压缩记忆机制实现无限长输入处理,并在多个长序列任务上取得优异表现。技术方法包括压缩记忆机制、局部与长期注意力的结合和流式处理能力等。实验结果显示在长上下文语言建模、密钥上下文块检索和书籍摘要任务上的性能优势。

一款强大的小型视觉语言模型,无处不在

moondream是一个使用SigLIP、Phi-1.5和LLaVA训练数据集构建的16亿参数模型。由于使用了LLaVA数据集,权重受CC-BY-SA许可证保护。您可以在Huggingface Spaces上尝试使用它。该模型在VQAv2、GQA、VizWiz和TextVQA基准测试中表现如下:LLaVA-1.5(13.3B参数):80.0、63.3、53.6、61.3;LLaVA-1.5(7.3B参数):78.5、62.0、50.0、58.2;MC-LLaVA-3B(3B参数):64.2、49.6、24.9、38.6;LLaVA-Phi(3B参数):71.4、-、35.9、48.6;moondream1(1.6B参数):74.3、56.3、30.3、39.8。

先进的视觉基础模型,支持多种视觉和视觉-语言任务

Florence-2是由微软开发的高级视觉基础模型,采用基于提示的方法处理广泛的视觉和视觉-语言任务。该模型能够解释简单的文本提示,执行诸如图像描述、目标检测和分割等任务。它利用FLD-5B数据集,包含54亿个注释,覆盖1.26亿张图像,精通多任务学习。其序列到序列的架构使其在零样本和微调设置中均表现出色,证明是一个有竞争力的视觉基础模型。

基于Transformer实现的ViTPose模型集合

ViTPose是一系列基于Transformer架构的人体姿态估计模型。它利用Transformer的强大特征提取能力,为人体姿态估计任务提供了简单而有效的基线。ViTPose模型在多个数据集上表现出色,具有较高的准确性和效率。该模型由悉尼大学社区维护和更新,提供了多种不同规模的版本,以满足不同应用场景的需求。在Hugging Face平台上,ViTPose模型以开源的形式供用户使用,用户可以方便地下载和部署这些模型,进行人体姿态估计相关的研究和应用开发。

基于Transformer的作者表示学习模型

LLNL/LUAR是一个基于Transformer的模型,用于学习作者表示,主要用于作者验证的跨领域迁移研究。该模型在EMNLP 2021论文中被介绍,研究了在一个领域学习的作者表示是否能迁移到另一个领域。模型的主要优点包括能够处理大规模数据集,并在多个不同的领域(如亚马逊评论、同人小说短篇故事和Reddit评论)中进行零样本迁移。产品背景信息包括其在跨领域作者验证领域的创新性研究,以及在自然语言处理领域的应用潜力。该产品是开源的,遵循Apache-2.0许可协议,可以免费使用。

Google的尖端开放视觉语言模型

PaliGemma是Google发布的一款先进的视觉语言模型,它结合了图像编码器SigLIP和文本解码器Gemma-2B,能够理解图像和文本,并通过联合训练实现图像和文本的交互理解。该模型专为特定的下游任务设计,如图像描述、视觉问答、分割等,是研究和开发领域的重要工具。

视觉语言模型高效文档检索工具

ColPali 是一种基于视觉语言模型的高效文档检索工具,它通过直接嵌入文档页面图像的方式来简化文档检索流程。ColPali 利用了最新的视觉语言模型技术,特别是 PaliGemma 模型,通过晚交互机制实现多向量检索,从而提高检索性能。这一技术不仅加快了索引速度,降低了查询延迟,而且在检索包含视觉元素的文档方面表现出色,例如图表、表格和图像。ColPali 的出现,为文档检索领域带来了一种新的“视觉空间检索”范式,有助于提高信息检索的效率和准确性。

视觉语言模型,能够进行逐步推理

LLaVA-o1是北京大学元组团队开发的一个视觉语言模型,它能够进行自发的、系统的推理,类似于GPT-o1。该模型在六个具有挑战性的多模态基准测试中超越了其他模型,包括Gemini-1.5-pro、GPT-4o-mini和Llama-3.2-90B-Vision-Instruct。LLaVA-o1通过逐步推理解决问题,展示了其在视觉语言模型中的独特优势。

给视觉语言模型赋予空间推理能力

SpatialVLM是一个由谷歌DeepMind开发的视觉语言模型,能够对空间关系进行理解和推理。它通过大规模合成数据的训练,获得了像人类一样直观地进行定量空间推理的能力。这不仅提高了其在空间VQA任务上的表现,还为链式空间推理和机器人控制等下游任务打开了新的可能。

多模态大型语言模型,提升视觉与语言的交互能力

InternVL2_5-8B-MPO-AWQ是OpenGVLab推出的一款多模态大型语言模型,它基于InternVL2.5系列,并采用混合偏好优化(Mixed Preference Optimization, MPO)技术。该模型在视觉和语言的理解与生成方面展现了卓越的性能,尤其在多模态任务中表现出色。它通过结合视觉部分InternViT和语言部分InternLM或Qwen,使用随机初始化的MLP投影器进行增量预训练,实现了对图像和文本的深入理解与交互。该技术的重要性在于它能够处理包括单图像、多图像以及视频数据在内的多种数据类型,为多模态人工智能领域提供了新的解决方案。

基于强化学习技术的视觉思考模型,理科测试行业领先

Kimi视觉思考模型k1是基于强化学习技术打造的AI模型,原生支持端到端图像理解和思维链技术,并将能力扩展到数学之外的更多基础科学领域。在数学、物理、化学等基础科学学科的基准能力测试中,k1模型的表现超过了全球标杆模型。k1模型的发布标志着AI在视觉理解和思考能力上的新突破,尤其在处理图像信息和基础科学问题上展现出色的表现。

多模态语言模型预测网络

Honeybee是一个适用于多模态语言模型的局部性增强预测器。它能够提高多模态语言模型在不同下游任务上的性能,如自然语言推理、视觉问答等。Honeybee的优势在于引入了局部性感知机制,可以更好地建模输入样本之间的依赖关系,从而增强多模态语言模型的推理和问答能力。

Transformer Debugger是由OpenAI的Superalignment团队开发的用于调查小型语言模型特定行为的工具

Transformer Debugger结合了自动化可解释性和稀疏自编码器技术,支持在编写代码之前进行快速探索,并能够在前向传递中进行干预,以观察其如何影响特定行为。它通过识别对行为有贡献的特定组件(神经元、注意力头、自编码器潜在表示),展示自动生成的解释来说明这些组件为何强烈激活,并追踪组件间的连接以帮助发现电路。

高效的视觉编码技术,提升视觉语言模型性能。

FastVLM 是一种高效的视觉编码模型,专为视觉语言模型设计。它通过创新的 FastViTHD 混合视觉编码器,减少了高分辨率图像的编码时间和输出的 token 数量,使得模型在速度和精度上表现出色。FastVLM 的主要定位是为开发者提供强大的视觉语言处理能力,适用于各种应用场景,尤其在需要快速响应的移动设备上表现优异。

大型语言模型是视觉推理协调器

Cola是一种使用语言模型(LM)来聚合2个或更多视觉-语言模型(VLM)输出的方法。我们的模型组装方法被称为Cola(COordinative LAnguage model or visual reasoning)。Cola在LM微调(称为Cola-FT)时效果最好。Cola在零样本或少样本上下文学习(称为Cola-Zero)时也很有效。除了性能提升外,Cola还对VLM的错误更具鲁棒性。我们展示了Cola可以应用于各种VLM(包括大型多模态模型如InstructBLIP)和7个数据集(VQA v2、OK-VQA、A-OKVQA、e-SNLI-VE、VSR、CLEVR、GQA),并且它始终提高了性能。

© 2026 AIbase 备案号:闽ICP备08105208号-14