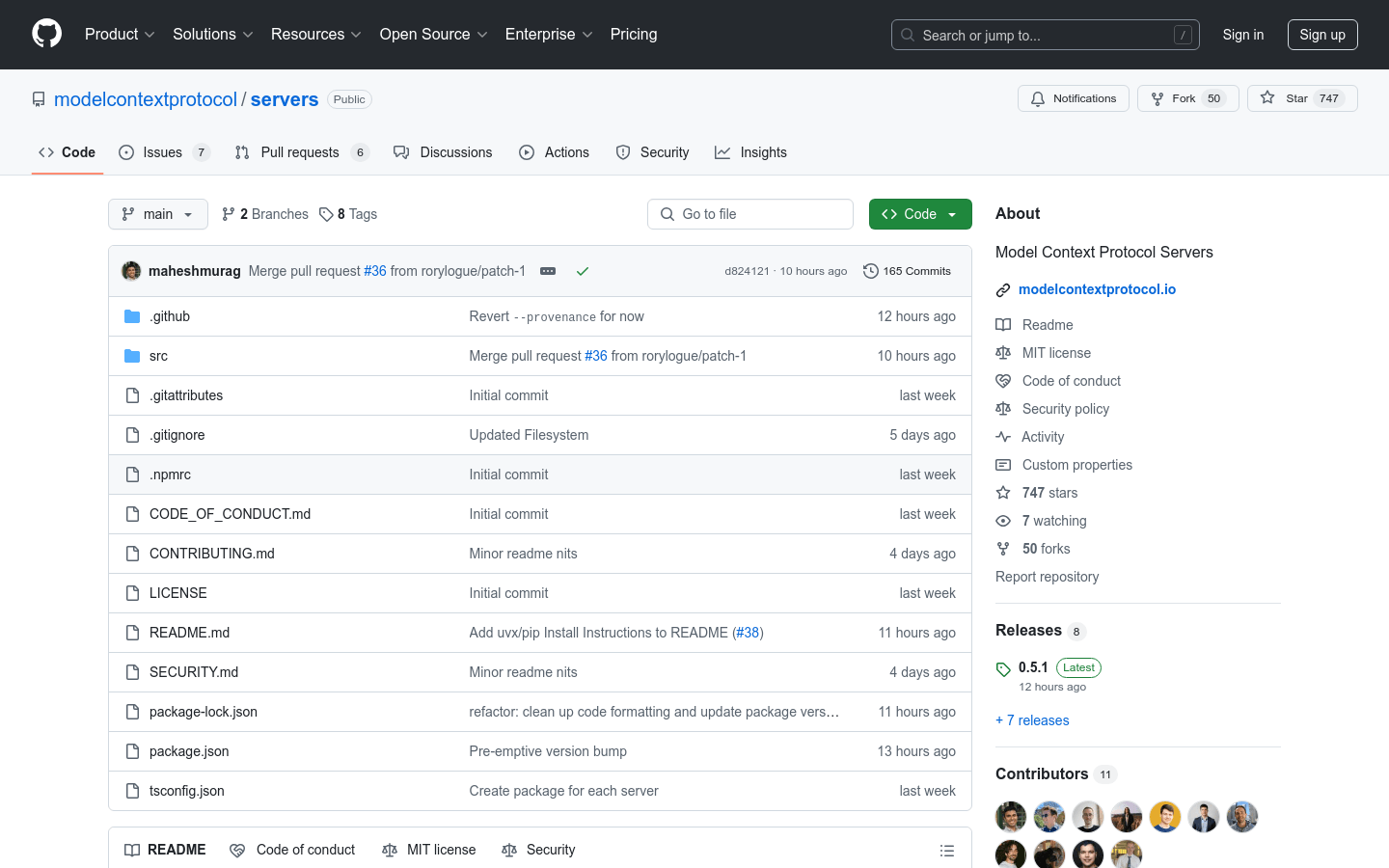

Model Context Protocol Servers

Model Context Protocol Servers是一个展示Model Context Protocol(MCP)多功能性和可扩展性的项目。它提供了一组参考实现和社区贡献的服务器,这些服务器展示了如何利用MCP为大型语言模型(LLMs)提供安全、受控的工具和数据源访问。每个MCP服务器都是使用Typescript MCP SDK或Python MCP SDK实现的。该项目由Anthropic管理,并且与社区共同构建,是开源的,鼓励大家贡献自己的服务器和改进。

需求人群:

"目标受众为开发者和数据科学家,他们需要安全、高效地为大型语言模型集成各种工具和数据源。MCP服务器提供了一种标准化的方式来实现这一目标,使得开发者可以轻松地扩展和自定义模型的功能。"

使用场景示例:

使用Filesystem服务器进行安全文件操作。

通过GitHub服务器进行代码仓库管理和文件操作。

利用PostgreSQL服务器进行数据库的只读访问和模式检查。

产品特色:

- Filesystem:安全文件操作,具有可配置的访问控制。

- GitHub:仓库管理、文件操作和GitHub API集成。

- Google Drive:Google Drive的文件访问和搜索功能。

- PostgreSQL:只读数据库访问,支持模式检查。

- Slack:频道管理和消息传递能力。

- Memory:基于知识图谱的持久化记忆系统。

- Puppeteer:浏览器自动化和网络抓取。

- Brave Search:使用Brave的搜索API进行网络和本地搜索。

- Google Maps:位置服务、方向和地点详细信息。

- Fetch:网络内容获取和转换,以提高LLM的使用效率。

使用教程:

1. 访问Model Context Protocol Servers的GitHub页面。

2. 根据需要的功能选择相应的服务器实现。

3. 按照README中的指南安装和配置所需的MCP服务器。

4. 如果是Typescript服务器,可以使用`npx`命令启动;如果是Python服务器,可以使用`uvx`或`pip`安装并启动。

5. 配置MCP客户端以使用这些服务器,例如在Claude Desktop中配置服务器。

6. 根据具体用例,可能需要设置环境变量或提供额外的参数。

7. 启动服务器并测试其功能以确保正确集成。

浏览量:41

最新流量情况

月访问量

4.93m

平均访问时长

00:06:29

每次访问页数

6.10

跳出率

36.08%

流量来源

直接访问

54.82%

自然搜索

31.76%

邮件

0.04%

外链引荐

11.31%

社交媒体

1.86%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.56%

德国

3.93%

印度

9.82%

俄罗斯

5.43%

美国

18.51%

Model Context Protocol的参考实现和社区贡献的服务器集合

Model Context Protocol Servers是一个展示Model Context Protocol(MCP)多功能性和可扩展性的项目。它提供了一组参考实现和社区贡献的服务器,这些服务器展示了如何利用MCP为大型语言模型(LLMs)提供安全、受控的工具和数据源访问。每个MCP服务器都是使用Typescript MCP SDK或Python MCP SDK实现的。该项目由Anthropic管理,并且与社区共同构建,是开源的,鼓励大家贡献自己的服务器和改进。

Model Context Protocol的服务器集合

Awesome MCP Servers是一个集合了多种Model Context Protocol(MCP)服务器的平台,旨在为开发者提供一系列工具和接口,以便与不同的服务和数据库进行交互。MCP是一种用于AI模型的上下文协议,它允许AI模型通过标准化的方式与外部系统进行通信和数据交换。这个平台的重要性在于它促进了AI技术的发展和应用,通过提供易于集成的服务器,使得开发者能够快速构建和部署AI解决方案。

A tool for integrating private data with AI large language models.

Dabarqus是一个Retrieval Augmented Generation(RAG)框架,它允许用户将私有数据实时提供给大型语言模型(LLM)。这个工具通过提供REST API、SDKs和CLI工具,使得用户能够轻松地将各种数据源(如PDF、电子邮件和原始数据)存储到语义索引中,称为“记忆库”。Dabarqus支持LLM风格的提示,使用户能够以简单的方式与记忆库进行交互,而无需构建特殊的查询或学习新的查询语言。此外,Dabarqus还支持多语义索引(记忆库)的创建和使用,使得数据可以根据主题、类别或其他分组方式进行组织。Dabarqus的产品背景信息显示,它旨在简化私有数据与AI语言模型的集成过程,提高数据检索的效率和准确性。

统一的代码库,用于微调大型多模态模型

lmms-finetune是一个统一的代码库,旨在简化大型多模态模型(LMMs)的微调过程。它提供了一个结构化的框架,允许用户轻松集成最新的LMMs并进行微调,支持全微调和lora等策略。代码库设计简单轻量,易于理解和修改,支持包括LLaVA-1.5、Phi-3-Vision、Qwen-VL-Chat、LLaVA-NeXT-Interleave和LLaVA-NeXT-Video等多种模型。

Xpoz MCP使Claude和大语言模型通过自然语言查询社媒数据,无API密钥和速率限制。

Xpoz MCP是一款基于模型上下文协议(MCP)的服务器,专为Claude和其他大语言模型设计,旨在为其提供社交媒体数据查询服务。它的重要性在于打破了传统API使用的限制,无需API密钥和担心速率限制,就能让用户轻松获取并分析社交媒体数据。该产品的主要优点包括零安装、全远程服务器支持、可通过自然语言查询、能访问全量历史数据、可进行实时数据查询等。产品背景源于对社交媒体数据高效利用的需求,适用于从研究到营销、威胁检测到竞争分析等多个领域。价格方面提供免费试用,之后可能根据不同的服务套餐收费,定位是帮助用户将Claude转变为强大的社会智能代理。

MCP是一个开放协议,用于无缝集成大型语言模型应用与外部数据源和工具。

Model Context Protocol(MCP)是一个开放协议,它允许大型语言模型(LLM)应用与外部数据源和工具之间实现无缝集成。无论是构建AI驱动的集成开发环境(IDE)、增强聊天界面还是创建自定义AI工作流,MCP都提供了一种标准化的方式,将LLM与它们所需的上下文连接起来。MCP的主要优点包括标准化的连接方式、易于集成和扩展、以及强大的社区支持。产品背景信息显示,MCP旨在促进开发者构建更加智能和高效的应用程序,特别是在AI和机器学习领域。MCP目前是免费提供给开发者使用的。

Model Context Protocol的命令行检查工具

mcp-cli是一个命令行界面(CLI)检查器,用于Model Context Protocol(MCP)。它允许用户运行MCP服务器,列出工具、资源、提示,并调用工具、读取资源、读取提示。这个工具对于开发者来说非常重要,因为它简化了MCP服务器的开发和交互过程,使得开发者可以更高效地管理和调试MCP服务器。mcp-cli是用JavaScript编写的,并且完全开源,可以在GitHub上找到其源代码。

精选技能集合,可扩展Claude能力,支持浏览、下载和贡献技能。

Claude Skills Directory是一个精心策划的技能目录网站,旨在为Claude AI代理扩展能力,使其能够接入现实世界的数据和功能。该网站收集了各种技能和工具,涵盖了从代码生成到学术研究等多个领域。其重要性在于为开发者和用户提供了一个集中的平台,方便他们发现、下载和贡献技能,从而增强Claude的实用性和灵活性。网站免费使用,定位为Claude技能的共享和交流社区,帮助用户充分发挥Claude的潜力。

通过Model Context Protocol服务器扩展语言模型的能力。

Smithery是一个基于Model Context Protocol的平台,允许用户通过连接各种服务器来扩展语言模型的功能。它为用户提供了一个灵活的工具集,能够根据需求动态增强语言模型的能力,从而更好地完成各种任务。该平台的核心优势在于其模块化和可扩展性,用户可以根据自己的需求选择合适的服务器进行集成。

AI驱动的多智能体数据分析系统

AI-Data-Analysis-MultiAgent是一个高级的AI驱动研究助理系统,利用多个专业智能体协助进行数据分析、可视化和报告生成等任务。该系统采用LangChain、OpenAI的GPT模型和LangGraph处理复杂的研究流程,集成多样化的AI架构以实现最佳性能。该系统的独特之处在于集成了一个专门的Note Taker智能体,通过维护项目的简洁而全面的记录,可以降低计算开销,提高不同分析阶段之间的上下文保持能力,并实现更连贯一致的分析结果。

本地语音聊天机器人,保护隐私,无需联网。

june是一个结合了Ollama、Hugging Face Transformers和Coqui TTS Toolkit的本地语音聊天机器人。它提供了一种灵活、注重隐私的解决方案,可以在本地机器上进行语音辅助交互,确保没有数据被发送到外部服务器。产品的主要优点包括无需联网即可使用、保护用户隐私、支持多种交互模式等。

一个用于将几乎所有内容转换为Markdown格式的Model Context Protocol服务器。

Markdownify是一个基于Model Context Protocol的服务器工具,能够将多种文件类型和网络内容转换为Markdown格式。它支持PDF、图片、音频(含转录)、DOCX、XLSX、PPTX等多种文件格式的转换,还能将YouTube视频字幕、Bing搜索结果和网页内容转换为Markdown。该工具对于需要高效整理和分享信息的用户来说非常实用,尤其是在处理大量非结构化数据时,能够快速生成可读性强的Markdown文本,提高工作效率。

提供全面的MLLMs评估

该工具旨在通过对最新专有和开源MLLMs进行定性研究,从文本、代码、图像和视频四个模态的角度,评估其泛化能力、可信度和因果推理能力,以提高MLLMs的透明度。我们相信这些属性是定义MLLMs可靠性的几个代表性因素,支持各种下游应用。具体而言,我们评估了闭源的GPT-4和Gemini以及6个开源LLMs和MLLMs。总体上,我们评估了230个手动设计的案例,定性结果总结为12个分数(即4个模态乘以3个属性)。总共,我们揭示了14个实证发现,有助于了解专有和开源MLLMs的能力和局限性,以更可靠地支持多模态下游应用。

Mistral Large是Mistral AI的旗舰模型,具有顶级推理能力。

Mistral Large是Mistral AI团队最新推出的旗舰语言模型,具有顶级推理能力。它可用于复杂的多语言推理任务,包括文本理解、转换和代码生成。该模型在常用基准测试中取得了强大的成绩,是继GPT-4之后全球第二大可通过API进行使用的模型。

一个开放平台,用于日常使用的语言代理。

OpenAgents是一个开放平台,旨在使用户和开发者能够在日常生活中使用和托管语言代理。该平台已经实现了三种代理:数据分析的Data Agent、集成200+日常工具的Plugins Agent和自动网页浏览的Web Agent。OpenAgents通过优化的Web UI使普通用户能够与代理功能进行交互,同时为开发者和研究人员提供在本地设置上的无缝部署体验,为创新语言代理的构建和现实世界评估提供了基础。

大型语言模型排行榜,实时评估模型性能。

OpenCompass 2.0是一个专注于大型语言模型性能评估的平台。它使用多个闭源数据集进行多维度评估,为模型提供整体平均分和专业技能分数。该平台通过实时更新排行榜,帮助开发者和研究人员了解不同模型在语言、知识、推理、数学和编程等方面的性能表现。

在句子表示空间中的语言建模

Large Concept Models(LCM)是由Facebook Research开发的一个大型语言模型,它在句子的表示空间中进行操作,使用SONAR嵌入空间支持多达200种语言的文本和57种语言的语音。LCM是一个序列到序列模型,用于自回归句子预测,探索了多种方法,包括均方误差回归、基于扩散的生成变体等。这些探索使用的是1.6B参数模型和约1.3T的培训数据。LCM的主要优点包括其在高级别语义表示上的运作能力,以及能够处理多语言数据的能力。此外,LCM的开源性质使得研究人员和开发者能够访问和使用这些模型,推动自然语言处理技术的发展。

大型世界模型,理解视频与语言

Large World Models是一个利用RingAttention技术训练的神经网络,专注于处理长视频和语言序列,以理解人类知识和多模态世界。它通过大规模数据集训练,实现了前所未有的上下文大小,并开源了一系列70亿参数的模型,能够处理超过100万标记的文本和视频。

Context Link让用户连接自有内容源,为AI提供上下文,提升工作效率。

Context Link是一款为AI工具提供上下文信息的产品。它允许用户连接自己的内容源,如Google Docs、Notion页面和网站等,通过语义搜索返回最相关的内容片段,并以AI友好的Markdown格式输出。该产品的主要优点在于能够帮助用户避免反复向AI解释,提高工作效率,确保AI输出的质量和相关性。产品背景是随着AI技术的发展,用户需要更好地利用自己的知识来引导AI。价格方面,提供免费试用,Starter版本每月9美元,Pro版本每月19美元。产品定位为专业人士和团队,旨在让AI工具快速准确地参考他们的知识。

FLUX Context AI & FLUX Kontext AI是一款革命性的AI图像编辑工具。

FLUX Context AI & FLUX Kontext AI是一款革命性的AI图像编辑工具,采用先进的扩散技术,提供卓越的精度和一致性,支持多种编辑任务。其快速生成、保持视觉一致性、统一框架处理多项任务等特点,让用户可以实现无限创意可能。

利用大规模机器学习理解场景并连接全球数百万场景的地理空间模型

Niantic的Large Geospatial Model (LGM) 是一个先锋概念,旨在通过大规模机器学习理解场景并将其与全球数百万其他场景连接起来。LGM不仅使计算机能够感知和理解物理空间,还能以新的方式与它们互动,成为AR眼镜及更广泛领域(包括机器人技术、内容创作和自主系统)的关键组成部分。随着我们从手机转向与现实世界相连的可穿戴技术,空间智能将成为世界未来的操作系统。

Stable Diffusion 3.5 Large的三款ControlNets模型

ControlNets for Stable Diffusion 3.5 Large是Stability AI推出的三款图像控制模型,包括Blur、Canny和Depth。这些模型能够提供精确和便捷的图像生成控制,适用于从室内设计到角色创建等多种应用场景。它们在用户偏好的ELO比较研究中排名第一,显示出其在同类模型中的优越性。这些模型在Stability AI社区许可下免费提供给商业和非商业用途,对于年收入不超过100万美元的组织和个人,使用完全免费,并且产出的媒体所有权归用户所有。

基于Stable Diffusion 3.5 Large模型的IP适配器

SD3.5-Large-IP-Adapter是一个基于Stable Diffusion 3.5 Large模型的IP适配器,由InstantX Team研发。该模型能够将图像处理工作类比于文本处理,具有强大的图像生成能力,并且可以通过适配器技术进一步提升图像生成的质量和效果。该技术的重要性在于其能够推动图像生成技术的发展,特别是在创意工作和艺术创作领域。产品背景信息显示,该模型是由Hugging Face和fal.ai赞助的项目,并且遵循stabilityai-ai-community的许可协议。

FLUX Context AI是一体化平台,可在几秒钟内提供专业的图像编辑工具,如风格转换、物体移除、背景替换等。

FLUX Context AI是一款革命性的AI图像编辑和增强工具,采用先进的扩散技术,能在几秒钟内生成令人惊叹的高质量图像,提供对象修改、风格转换、背景替换等专业编辑功能,无需技术技能。

一个全面的Prompt Engineering技术资源库

Prompt Engineering是人工智能领域的前沿技术,它改变了我们与AI技术的交互方式。这个开源项目旨在为初学者和经验丰富的实践者提供一个学习、构建和分享Prompt Engineering技术的平台。该项目包含了从基础到高级的各种示例,旨在促进Prompt Engineering领域的学习、实验和创新。此外,它还鼓励社区成员分享自己的创新技术,共同推动Prompt Engineering技术的发展。

Agentic Graph Language Assistant

GraphAgent是一个自动化代理流水线,旨在处理显式的图形依赖和隐式的图形增强语义相互依赖,以适应实际数据场景中的预测任务(例如节点分类)和生成任务(例如文本生成)。它由三个关键组件构成:构建知识图谱以反映复杂语义依赖的图形生成代理;解释不同用户查询并制定相应任务的计划代理;以及高效执行计划任务并自动化工具匹配和调用的执行代理。GraphAgent通过集成语言模型和图形语言模型来揭示复杂的关系信息和数据语义依赖。

在浏览器中尝试Cleanlab的可信任语言模型(TLM)

TLM Playground是Cleanlab的一个工具,用于在浏览器中使用可信任语言模型(TLM)。它提供了一个交互式界面,用户可以输入文本并获得模型生成的响应。TLM是一种基于深度学习的语言模型,它可以用于生成自然语言文本,例如回答问题、翻译、文本摘要等。

语言模型自我奖励训练

本产品是一种自奖励语言模型,通过 LLM 作为裁判,使用模型自身提供的奖励信号进行训练。通过迭代的 DPO 训练,模型不仅可以提高遵循指令的能力,还能提供高质量的自我奖励。经过三次迭代的 Fine-tuning,本产品在 AlpacaEval 2.0 排行榜上超过了许多现有系统,包括 Claude 2、Gemini Pro 和 GPT-4 0613。这项工作虽然只是初步研究,但为模型在两个方面持续改进的可能性打开了大门。

Adobe Firefly Image 3 Model,带来照片般逼真的图像生成技术,提升创意表达。

Adobe Firefly Image 3 Model 是 Adobe 公司推出的最新图像生成模型,它在照片般逼真的质量、风格化能力、细节和准确性以及多样性上都有显著提升。该模型自2023年3月首次发布以来,已经在全球生成超过70亿张图片,并且已经集成到 Adobe Photoshop、Adobe Express、Adobe Illustrator 和 Adobe Substance 3D 等日常使用的 Adobe 工作流程中。Adobe 致力于负责任地开发生成式人工智能,并与全球联盟 Content Authenticity Initiative (CAI) 合作,以促进数字内容的透明度。

© 2026 AIbase 备案号:闽ICP备08105208号-14