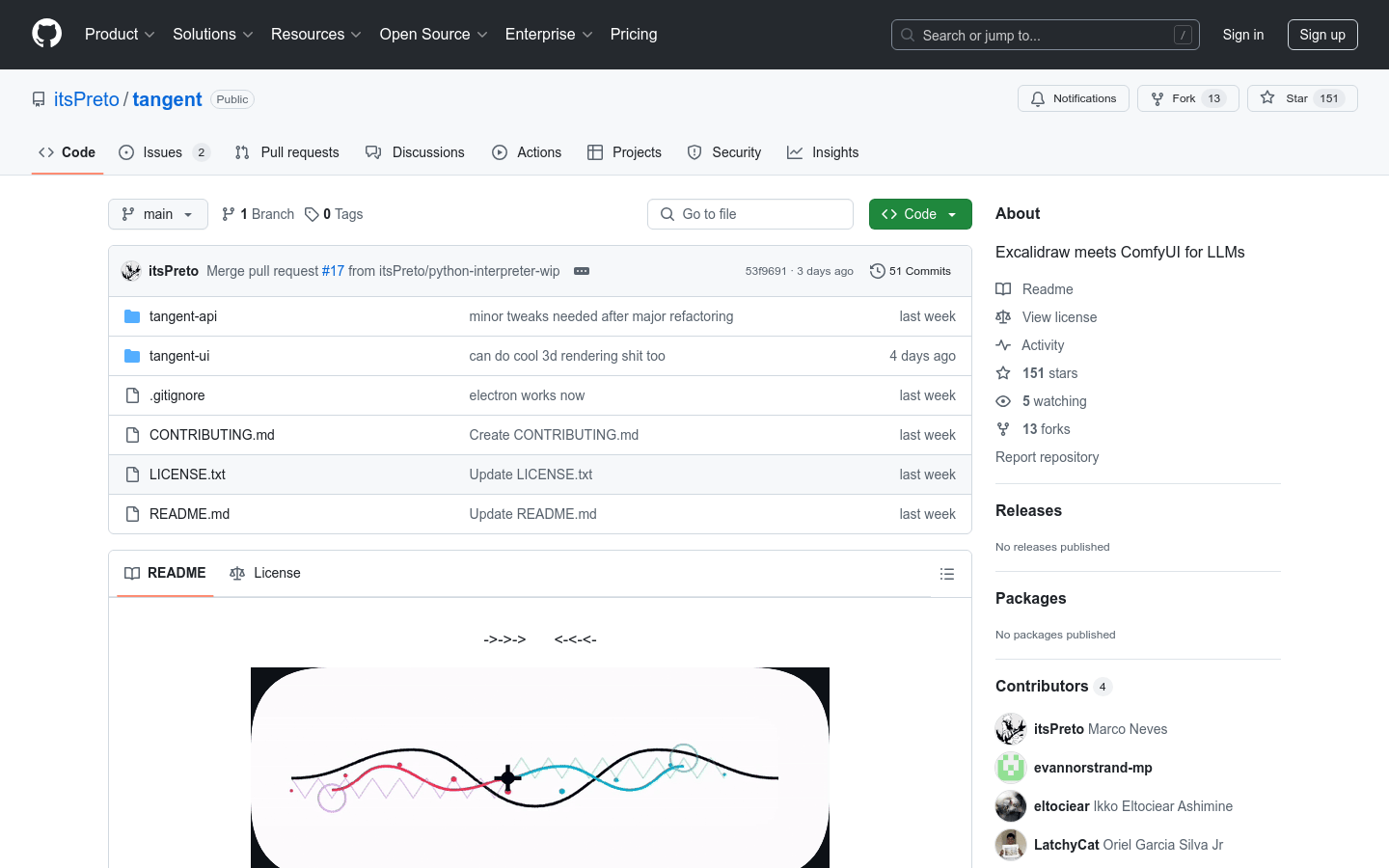

Tangent是一个用于探索AI对话的平台,它允许用户在达到上下文限制后无缝恢复对话,轻松创建对话分支以测试多种方法或想法,并且完全由本地模型支持。它的目标是将与AI助手的交互转变为更视觉化/文本化的探索,而不仅仅是一个聊天界面。这个项目背景是为了让对话能够超越传统的聊天应用限制,成为一个可以自由实验、复活旧线程或深入探讨的话题的工作台。

需求人群:

"目标受众是希望与AI进行深入、复杂对话的用户,包括研究人员、开发者和任何对AI对话有兴趣的人。这个产品适合他们,因为它提供了一个超越传统聊天应用限制的平台,允许他们探索、实验和恢复对话,而不受上下文限制。"

使用场景示例:

研究人员可以使用Tangent来探索不同对话路径,以研究AI的响应和行为。

开发者可以利用Tangent的API和前端界面来构建自己的AI对话应用。

普通用户可以用Tangent来保存和恢复他们与AI的对话,即使在对话中断后也能继续。

产品特色:

复活并继续:在达到先前的上下文限制后,无缝恢复对话。

分支并探索:在任何点轻松创建对话分支,以测试多种方法或想法。

离线优先:完全由本地模型支持,利用Ollama,并计划扩展支持。

主题聚类:动态组织和过滤对话,根据推断出的主题,简化导航。

存档支持:与Claude和ChatGPT数据导出全面兼容,正在开发更多集成。

使用教程:

1. 访问Tangent的GitHub页面并克隆或下载项目。

2. 根据README文件中的说明设置本地开发环境。

3. 安装所需的依赖项和模型。

4. 启动后端服务,并确保它在localhost上运行。

5. 设置前端界面,并根据需要进行定制。

6. 使用Tangent提供的API端点来处理和保存聊天数据。

7. 利用Tangent的功能来探索和恢复AI对话。

浏览量:52

最新流量情况

月访问量

4.93m

平均访问时长

00:06:29

每次访问页数

6.10

跳出率

36.08%

流量来源

直接访问

54.82%

自然搜索

31.76%

邮件

0.04%

外链引荐

11.31%

社交媒体

1.86%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.56%

德国

3.93%

印度

9.82%

俄罗斯

5.43%

美国

18.51%

使用Ollama和Gradio UI的GraphRAG本地模型

GraphRAG-Ollama-UI是一个基于微软GraphRAG的本地模型适配版本,支持使用Ollama进行本地模型支持。它通过Gradio UI提供了一个交互式用户界面,使得用户可以更方便地管理数据、运行查询和可视化结果。该模型的主要优点包括本地模型支持、成本效益高、交互式用户界面、实时图可视化、文件管理、设置管理、输出探索和日志记录。

通过本地Ollama LLM与你的Obsidian笔记聊天

Obsidian Ollama Chat是一个插件,允许用户通过本地运行的Ollama LLM模型与自己的Obsidian笔记进行交互和查询。它提供了一种新颖的笔记管理和信息检索方式,使得用户可以更加直观和便捷地获取所需信息。该插件的开发背景是索引和查询笔记内容的需要,它通过本地模型运行,保护用户隐私,并且避免了对外部服务的依赖。

本地大语言模型

Ollama是一款本地大语言模型工具,让用户能够快速运行Llama 2、Code Llama和其他模型。用户可以自定义和创建他们自己的模型。Ollama目前支持macOS和Linux,Windows版本即将推出。该产品定位于为用户提供本地化的大语言模型运行环境,以满足用户个性化的需求。

Ollama能在Windows本地运行大型AI模型

Ollama是一个开源项目,能够在Windows本地运行各类大型AI模型,支持GPU加速,内置OpenAI模型兼容层,提供永久在线的API。用户可以无缝访问Ollama的完整模型库,进行图片和语音交互。Ollama免配置就能获得强大的AI能力,帮助开发者和创作者在Windows上构建AI应用。

探索AI对话的画布,将每次聊天分支视为可合并、比较和丢弃的实验。

Tangent是一个用于探索AI对话的平台,它允许用户在达到上下文限制后无缝恢复对话,轻松创建对话分支以测试多种方法或想法,并且完全由本地模型支持。它的目标是将与AI助手的交互转变为更视觉化/文本化的探索,而不仅仅是一个聊天界面。这个项目背景是为了让对话能够超越传统的聊天应用限制,成为一个可以自由实验、复活旧线程或深入探讨的话题的工作台。

macOS平台的Ollama模型聊天应用

Chital是一个为macOS平台设计的应用程序,它允许用户与Ollama模型进行聊天。这个应用具有低内存占用和快速启动的特点,支持多聊天线程,能够在不同的模型间切换,并支持Markdown格式。此外,它还能自动为聊天线程生成标题摘要。Chital的开发主要是为了满足开发者个人的使用需求,但也鼓励社区成员通过fork代码库来添加新功能。

利用本地 AI 模型为您提供网页浏览辅助

Page Assist 是一个为本地 AI 模型提供便捷的 Web 用户界面的辅助工具。您可以利用本地 AI 模型与浏览器交互,或者将其作为本地 AI 模型供应商(如 Ollama Repo)的 Web 用户界面。当前功能包括侧边栏任务支持、视觉模型支持、最小化的本地 AI 模型 Web 用户界面、互联网搜索功能、侧边栏上的 PDF 对话框、文档聊天(PDF、CSV、TXT、MD 格式)等。

本地AI管理、验证和推断

本地AI游乐场是一个本地AI模型管理、验证和推断的桌面客户端应用。它提供了零技术设置的AI实验环境,不需要GPU支持。用户可以在本地离线环境中运行AI模型,享受更高的隐私保护。该应用具有简洁易用的界面和强大的功能,支持CPU推断、模型下载和管理、模型完整性验证等功能。本地AI游乐场是免费开源的。

检测硬件,了解本地可运行的AI模型,支持GPU、CPU和RAM分析

CanIRun.ai是一个在线网站,其核心功能是检测用户硬件配置,并分析哪些AI模型可以在本地运行。这项技术的重要性在于,它解决了用户在选择AI模型时,因不确定硬件是否支持而产生的困扰。主要优点包括:方便快捷,用户无需进行复杂的手动配置和测试;信息全面,涵盖了众多主流的AI模型;实时更新,能及时反映最新的硬件和模型信息。产品背景方面,随着AI技术的快速发展,越来越多的用户希望在本地运行AI模型,但不同模型对硬件的要求差异较大,CanIRun.ai应运而生,为用户提供了一个简单易用的解决方案。目前未提及价格相关信息,其定位是为广大AI爱好者和开发者提供硬件与模型匹配的参考工具。

一键发起AI机器人对话,集成多款国产大模型。

AI对话鸭是一个领先的AI聊天对话平台,它集成了多款国产大模型,提供了丰富的对话场景和功能,满足不同用户的需求。该平台以其高效的对话生成能力和多样的应用场景,在提高工作效率和娱乐互动方面具有显著优势。

与私有自托管语言模型对话的iOS/macOS应用

Enchanted是一个开源的、兼容Ollama的macOS/iOS/visionOS应用,它允许用户与私有自托管的语言模型如Llama 2、Mistral、Vicuna等进行对话。它基本上是一个连接到私有模型的ChatGPT应用界面。Enchanted的目标是提供一个产品,允许在iOS生态系统(macOS、iOS、Watch、Vision Pro)的所有设备上提供无过滤、安全、私密和多模态的体验。

使用ollama Python客户端与ComfyUI工作流集成的大型语言模型(LLM)

ComfyUI Ollama是为ComfyUI工作流设计的自定义节点,它使用ollama Python客户端,允许用户轻松地将大型语言模型(LLM)集成到他们的工作流程中,或者仅仅是进行GPT实验。这个插件的主要优点在于它提供了与Ollama服务器交互的能力,使得用户可以执行图像查询、通过给定的提示查询LLM,以及使用精细调整参数进行LLM查询,同时保持生成链的上下文。

AI对话谜题游戏

ModelLe AI Games是一个基于AI大语言模型的对话谜题游戏。它通过与AI模型进行对话来解决谜题。玩家需要根据问题的要求构造合适的问题,并根据模型的回答来判断是否通过谜题。游戏涵盖了多个章节和题目,每个题目都有不同的要求和限制。通过游戏,玩家可以锻炼自己的思维能力和对语言模型的理解。

一个强大的本地文档问答工具,连接到你的本地Ollama模型,用于创建和管理RAG系统。

RLAMA是一个本地文档问答工具,通过连接本地Ollama模型,为用户提供文档索引、查询和交互功能。它支持多种文档格式,确保数据完全在本地处理,保障隐私安全。该工具主要面向开发者和技术用户,旨在提高文档管理和知识检索的效率,尤其适用于处理敏感文档和私有知识库。目前产品为开源免费版本,未来可能会有更多功能扩展。

本地运行的AI模型训练与部署工具,支持个性化训练和多平台使用。

Kolosal AI 是一款用于本地设备训练和运行大型语言模型(LLMs)的工具。它通过简化模型训练、优化和部署流程,使用户能够在本地设备上高效地使用 AI 技术。该工具支持多种硬件平台,提供快速的推理速度和灵活的定制能力,适合从个人开发者到大型企业的广泛应用场景。其开源特性也使得用户可以根据自身需求进行二次开发。

使用Groq或OpenAI或Ollama创建o1类推理链

o1是一个实验性的项目,旨在通过使用大型语言模型(LLM)来创建推理链,帮助模型解决通常难以处理的逻辑问题。它支持Groq、OpenAI和Ollama后端,通过动态推理链让模型能够“思考”并解决问题。o1展示了仅通过提示就能显著提高现有模型的逻辑推理能力,而无需额外训练。

智能角色模型,构建最优秀的大模型底座

百川角色大模型是百川智能提供的一款智能角色模型,融合了意图理解、信息检索以及强化学习技术,结合有监督微调与人类意图对齐,在知识问答、文本创作领域表现突出。该模型可实现角色扮演对话,提供高度开放的个性化角色定制能力,具备高度准确性和口语化的回答能力。

百度 UNIT 是一款领先的智能对话管理平台,助力企业定制专业、可控、稳定的对话系统。

百度 UNIT 搭载业界领先的对话理解和对话管理技术,提供灵活运营管理工具和可视化会话流程配置,助力企业智能化升级实现降本增效。

人工智能领域的多轮对话处理专家

汉王天地大模型是汉王科技推出的一款专注于人工智能领域的大语言模型,拥有30年的行业积累。它能够实现多轮对话,高效处理任务,并深耕办公、教育、人文等多个垂直细分领域。该模型通过从人类反馈中进行强化学习,不断优化自身智能,提供包括智能校对、自动翻译、法律咨询、绘画生成、文案生成等在内的多样化服务,以赋能法律、人文、办公、教育、医养等行业,提升效率和创意。

允许用户直接在浏览器本地运行Phi-3模型的AI工具。

Phi-3 WebGPU是一款结合了Transformers.js和onnxruntime-web的AI模型,它利用WebGPU加速技术,提供超过20t/s的处理速度,并且所有数据处理在本地完成,确保用户隐私安全。尽管在中文回答上存在一些不足,但其在浏览器中提供的AI模型运行能力仍然值得关注。

星辰语义大模型,智能对话助手

TeleChat是由中电信人工智能科技有限公司研发的星辰语义大模型,具备强大的对话生成能力,支持多轮对话,适用于多种场景的智能问答和内容生成。模型经过大量高质量中英文语料训练,具备优秀的通用问答、知识类、代码类、数学类问答能力。

基于AgentScope的开源个人AI助理工作站,支持多渠道和本地大模型运行。

CoPaw是基于AgentScope框架构建的开源AI助理工作站。它为用户提供了完全的隐私控制,可本地或云端部署,连接多种聊天应用并运行本地大语言模型。其技术架构结合Python和TypeScript,模型管理支持多种方式,核心模块解耦可独立扩展。主要优点包括多渠道集成、本地模型运行、模块化架构、可扩展技能系统、长期记忆和心跳机制等。产品定位是帮助用户实现自动化工作流程,提升工作和生活效率。价格方面,产品是开源的,可免费使用,无相关付费信息。

一款集成AI技术的智能对话系统,提供多语言翻译、编程代码生成等功能。

ChatMIX智能对话-AIGC系统是一款利用人工智能技术构建的在线聊天系统,旨在通过AI技术提升用户交互体验。产品支持智能翻译、工作周报生成、编程代码编写等功能,满足用户在不同场景下的需求。它的优势在于能够快速响应用户指令,提供准确、高效的服务,同时具备良好的用户界面和操作体验。

ZeroClaw是本地私人AI助理,可连多平台,数据不离开本地,无云无订阅。

ZeroClaw是一款由ZeroClaw Labs开发的私人AI助理,它能够100%在本地机器上运行,无需依赖云端服务。其重要性在于为用户提供了高度的数据隐私保护,用户数据不会离开自己的计算机,避免了数据泄露风险。该产品采用Rust语言开发,具有轻量级、高性能的特点,典型内存占用小于5MB,在低端硬件上也能实现近即时启动,冷启动时间小于10ms。它的定位是为个人用户和企业团队提供一个安全、高效、可定制的AI助理解决方案,且无需订阅费用,完全免费使用。

将AI本地化产品的对话数据转化为可行动的产品见解!

impaction.ai是一个用于AI本地化产品的分析工具,帮助产品团队轻松分析由LLM驱动的应用程序生成的对话数据。它提供强大的搜索功能,可通过自然语言查找特定对话,并通过Columbus Copilot提供定制的建议和分析结果。impaction.ai支持多种数据源,并且已获得SOC II Type 1认证。定价根据数据量和具体业务情况而定。

自动化AI网络研究助手,利用本地大型语言模型进行深入研究。

Automated-AI-Web-Researcher-Ollama是一个创新的研究助理工具,它通过Ollama运行的本地大型语言模型来对任何给定的主题或问题进行深入的自动化在线研究。与传统的大型语言模型互动不同,这个工具通过将查询分解为专注的研究领域,系统地通过网络搜索和相关网站的抓取来调查,并将发现自动保存到一个包含所有内容和每个来源链接的文本文件中。此外,用户可以随时输入命令停止研究,然后大型语言模型会审查所有找到的内容并提供对原始主题或问题的全面总结。用户还可以询问大型语言模型关于其研究发现的问题。这个工具的主要优点是它不仅仅是一个聊天机器人,而是一个自动化的研究助理,系统地调查主题并维护有记录的研究轨迹。

© 2026 AIbase 备案号:闽ICP备08105208号-14