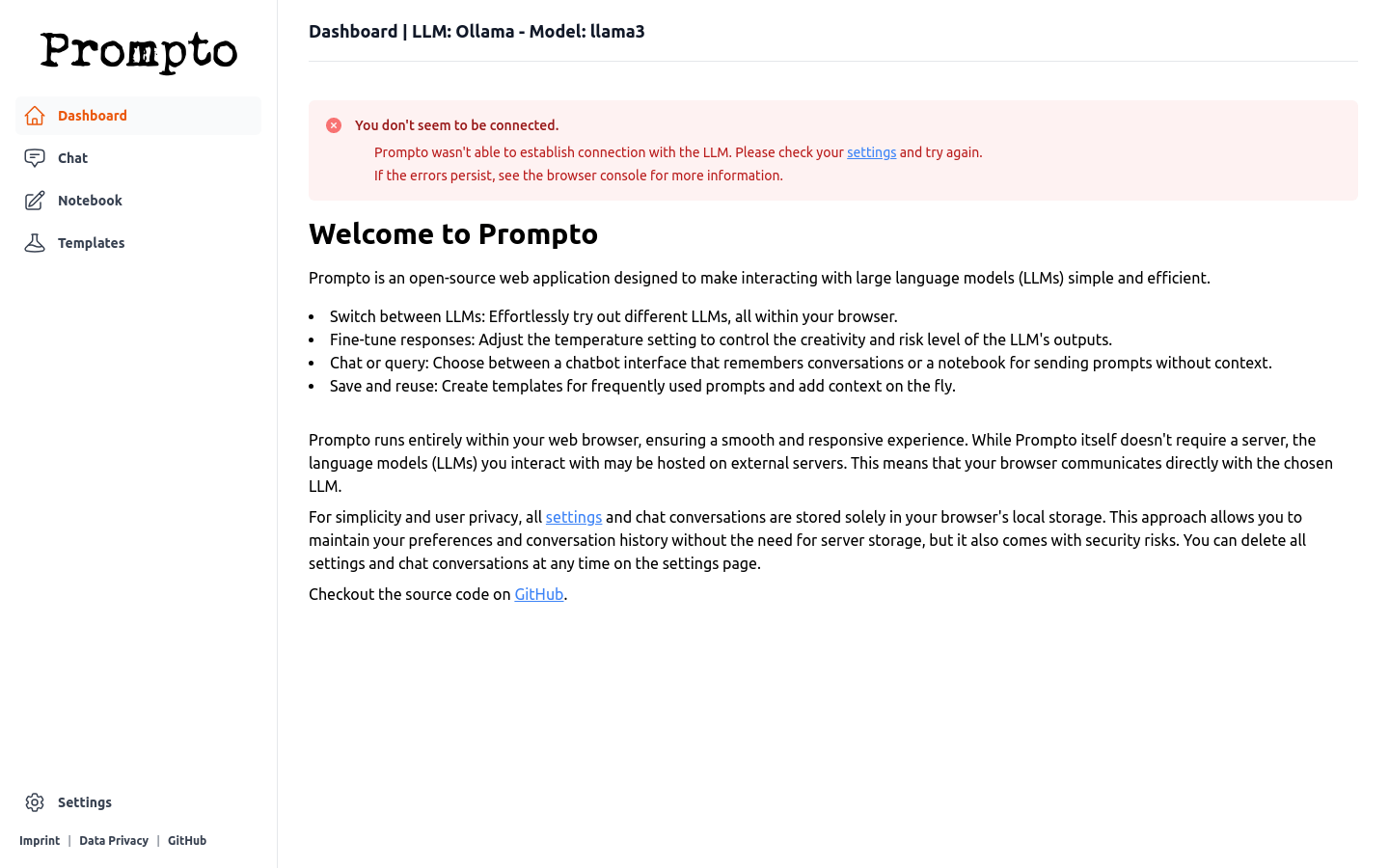

Prompto是一个开源的网页应用程序,旨在使与大型语言模型(LLMs)的交互简单高效。它可以轻松切换不同的LLMs,通过调整温度设置来调整LLM的创造力和风险水平,提供聊天机器人界面和笔记本界面,可以创建常用提示的模板,并且在浏览器中运行,确保流畅响应的体验。所有设置和聊天记录仅存储在浏览器的本地存储中,保护用户隐私。

需求人群:

Prompto适用于需要与大型语言模型进行交互的用户,例如研究人员、学生、写作人员和开发人员。它提供了简单、直观的界面,使用户可以轻松地与LLMs进行对话、提问和创作。

使用场景示例:

研究人员可以使用Prompto与语言模型进行交互,探索不同的研究方向。

学生可以使用Prompto进行写作辅助,获取灵感和帮助。

开发人员可以使用Prompto测试不同的语言模型,并集成到自己的应用中。

产品特色:

轻松切换不同的LLMs

通过调整温度设置来控制LLM的创造力和风险水平

提供聊天机器人界面和笔记本界面

创建常用提示的模板,并且在使用过程中添加上下文

在浏览器中运行,确保流畅响应的体验

使用教程:

打开Prompto网站

选择所需的语言参数

调整温度设置来控制LLM的创造力和风险水平

选择聊天机器人界面或笔记本界面

创建常用提示的模板

开始与LLM进行交互

浏览量:67

基于GPT算法的智能聊天机器人

Open-GPT 开放版·直连GPT聊天机器人,是一款基于的GPT算法开发的聊天机器人,具备较高的智能度和语言理解能力,可以进行智能问答、闲聊、教育咨询等多种交互,为用户提供更加便利和快捷的服务。系统聊天记录不会被上传到第三方服务器,用户的隐私得到了更好的保护。

利用AI为网站内容提供交互式聊天机器人

SiteCompanion是一个可以帮助用户将网站内容转换成交互式AI聊天机器人的在线服务。它可以让用户轻松创建自定义的聊天机器人,通过自然语言交互来回答用户的问题,为用户提供即时的指导和帮助。

聪明语言模型,交互式对话

TalkGPT是一种聪明的语言模型,可以进行交互式对话。它可以回答各种问题,并提供智能的回应。通过使用查询示例,您可以充分利用它的潜力。TalkGPT提供了一种无缝的对话体验,让您可以与模型进行自然而流畅的交流。

定制AI聊天机器人

Chat Data是一个使用您提供的数据创建AI聊天机器人的平台。您可以轻松地将聊天机器人集成到您的网站上,根据您提供的内容回答问题。上传文档或链接到您的网站进行机器人训练。提供专业的医疗聊天模型。自定义聊天机器人的个性和语言偏好。选择GPT-3.5 Turbo和GPT-4。支持多语言。与其他人共享您的聊天机器人。

云端AI聊天机器人服务

SymeChat是一个基于Llama2 7B语言模型的云端AI聊天机器人服务,能够以极低的成本为企业和开发者提供会话式AI能力,无需自行托管大型语言模型的基础设施成本。SymeChat利用Llama2 7B强大的自然语言理解和生成能力,为聊天机器人、虚拟助手等AI应用提供人类级别的对话技能。通过利用Llama2 7B云服务,SymeChat消除了客户购买昂贵GPU硬件或者维护升级神经网络的复杂性。客户只需根据每月使用情况付费,没有任何前期基础设施成本。我们的目标是通过经济实惠的选择普及AI访问,即使是小企业和非营利组织也能够以合理的成本为客户和社区提供有用的虚拟助手。

构建高效对话式聊天机器人

Enrol聊天机器人是您的在线销售专家,能够将网站访问者转化为付费客户。它拥有简单的拖放界面,支持通过API与后端系统集成,可以通过网页、Facebook Messenger以及Telegram进行全方位沟通,实现24小时不间断的客户服务、销售渠道构建,大大节省人力成本。

聊天机器人,让你不再孤单

豆包是一款智能聊天机器人,能够与用户进行自然语言交互,提供各种聊天话题,包括天气、新闻、笑话、音乐等。豆包还能够根据用户的喜好和习惯,推荐相关的内容和服务。豆包是你的私人聊天助手,让你不再孤单。

多语言聊天机器人

Giti多语言聊天机器人是一款智能聊天机器人,支持100多种语言,具备自然流畅的对话能力。它可以理解您的母语并与您进行智能对话。无论您想聊天、咨询问题还是寻求娱乐,Giti都能为您提供准确、有趣的回答。

利用大型语言模型生成交互式图表

Interactive Graph by LLM 是一个基于大型语言模型(LLM)的网站,它允许用户通过自然语言提示生成交互式图表。这项技术的重要性在于它简化了数据可视化的过程,使得非技术用户也能够轻松创建和理解复杂的数据。产品背景信息包括其创新的交互方式和对数据可视化的贡献。目前产品处于免费试用阶段,定位于希望简化数据展示流程的企业和个人。

语音交互式语言学习App

Natulang是一个语音交互式的语言学习App。它利用语音生成和识别技术,让用户可以通过大声朗读对话来学习语言。相比其他注重打字的语言学习App,Natulang更注重语音交流,让用户培养语言表达的自信心。

智能支持聊天机器人

Chattier是一款基于OpenAI GPT的智能支持聊天机器人。它能够提供优质的客户支持体验,帮助用户解决问题和回答相关主题的任何问题。Chattier支持标准聊天格式和3D头像,可轻松嵌入在任何网站上。试用免费!

智能AI聊天助手,提供多语言对话和个性化服务。

Ai Chat机器人Plus是一款基于人工智能技术的聊天机器人,它能够理解并流畅地与用户进行交流,提供信息查询、日常咨询、技术支持等服务。这款产品通过模仿人类的对话方式,为用户提供了一个直观、便捷的交互体验。它主要的优点包括快速响应、高准确率的语义理解以及个性化的服务体验。Ai Chat机器人Plus适用于需要快速、智能对话解决方案的个人和企业用户。

多语言聊天机器人,支持100多种语言

Giti多语言聊天机器人是一款先进的多语言AI聊天机器人,采用最新的GPT-3模型。支持100多种语言,可以自然流畅地进行对话。Giti.ai可以让您与能够理解您母语的智能聊天机器人对话。

定制化聊天机器人

ParrotChat是一款定制化聊天机器人工具,能够根据你的网站内容进行学习,并提供个性化的回答。它可以用于客户支持、电子商务、员工支持等多种场景。ParrotChat集成了Shopify、WordPress等主流平台,使用简单方便。欢迎免费试用!

AI聊天机器人,帮助您处理客户支持

Ping Parrot是一个AI聊天机器人平台,可以帮助您快速构建自定义的聊天机器人,并将其嵌入到您的网站上,帮助您处理客户支持。无需编码即可使用。聊天机器人可以根据您的数据进行训练,学习并提供最佳答案。您可以定制聊天机器人的外观以匹配您的品牌,并在80种语言中提供帮助。

智能AI聊天机器人

AidChat是一款智能AI聊天机器人,可以帮助您建立并培训适用于您的业务/网站的聊天机器人,并将其发布给全世界使用。这些聊天机器人可以回答与您的业务相关的任何问题。通过使用AidChat,您可以转变客户支持,提高效率,同时为客户提供更好的体验。

基于GPT的对话式网站聊天机器人

DialogGPT是一个基于GPT模型的对话式聊天机器人,能够帮助网站实时回答用户查询,提高用户参与度和转化率。它使用先进的AI技术,无需任何技术专长就可以为您的网站提供智能客服。DialogGPT可以自定义外观与行为,无缝集成到您的网站中,为用户提供流畅的交互体验。

构建定制的大型语言模型(LLM)以增强聊天机器人的能力。

ChatRTX 是 NVIDIA 提供的一个用于构建定制大型语言模型(LLM)的平台,旨在提升聊天机器人的智能水平和交互能力。它利用先进的 AI 技术,通过理解自然语言处理(NLP)来提供更加人性化的对话体验。ChatRTX 的主要优点包括高度的可定制性、强大的语言理解能力和高效的交互设计,适合需要高级对话系统的各种商业应用。

解放聊天机器人的束缚

1Chatbot通过提供聊天SDK、API、UI工具包和60多个消息功能,将来自不同平台的聊天机器人和技能融合在一个界面中。无需为用户与机器人的交互构建前端,也无需局限于使用单个自然语言理解(NLU)库。1Chatbot能够结合多个NLUs,快速开发,保持未来的可扩展性。价格从免费开始。

在线聊天机器人竞技场,比较不同语言模型的表现。

LMSYS Chatbot Arena 是一个在线平台,旨在通过用户与匿名聊天机器人模型的互动,对大型语言模型(Large Language Models, LLMs)进行基准测试。该平台收集了超过70万次人类投票,计算出LLM的Elo排行榜,以确定谁是聊天机器人领域的冠军。平台提供了一个研究预览,具有有限的安全措施,可能生成不当内容,因此需要用户遵守特定的使用条款。

高智商聊天机器人

Ivy.ai是一款使用聊天机器人回答学生问题的智能软件。每个聊天机器人都会根据您的学校网站上的数百万个问题和答案进行个性化训练,提供个性化的结果。Ivy.ai帮助高校在学生接触人工客服之前解答他们的问题。

聊天机器人,AI人物,AI语音聊天

Netwrck AI Chat是一个提供AI聊天机器人、AI人物和AI语音聊天功能的网站。它可以与AI进行文字和语音交流,具有多种语音和字符生成模式。Netwrck AI Chat可以用于各种场景,如娱乐、学习、工作等。它通过AI技术实现了智能对话和语音识别功能,让用户可以与AI进行有趣和实用的交互。

AI助手销售聊天机器人

Sale Whale是一款AI助手销售聊天机器人,帮助您更好地闭合交易,提高销售额。它能够根据客户需求提供个性化的销售建议和解决方案,提供实时的销售数据和分析报告,帮助您优化销售流程。定价灵活多样,可根据用户需求定制。Sale Whale能够自动回复客户的问题,提供产品信息,推荐相关产品,提高销售效率。

基于Groq的极速AI聊天机器人,提供实时交互式股票图表和信息。

StockBot是一款由Groq支持的AI聊天机器人,利用Llama3 70b在Groq上的Vercel AI SDK和TradingView的实时小部件,以对话形式回应实时、互动的图表和界面,专门针对您的请求。Groq的速度使得工具调用和提供近乎即时的响应成为可能,允许进行两次API调用,使用不同的专业提示返回响应。请注意:StockBot可能提供不准确的信息,不提供投资建议。它仅供娱乐和教学使用。

AI性感聊天机器人

Stripchats.ai是一个基于人工智能的性感聊天机器人。它可以与用户进行自然对话,模拟真人女友的交流体验。主要功能包括沟通互动、情感交流、个性化定制等。优势是 RESPONSE 24小时在线,支持文字和语音交流,大量自定义个性化内容,多样情景和角色扮演等。适合寻求在线娱乐和交流的用户。

© 2026 AIbase 备案号:闽ICP备08105208号-14