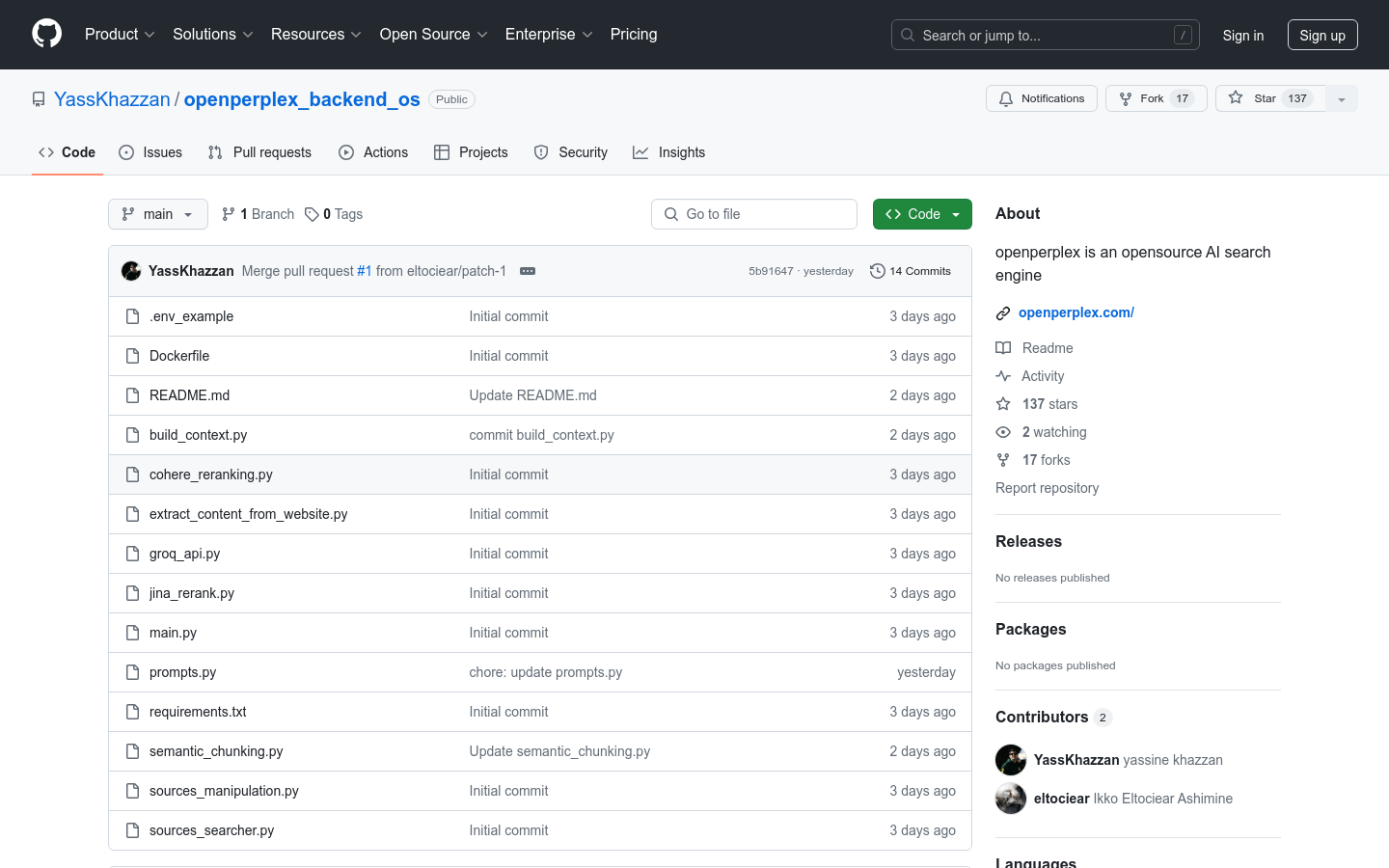

OpenPerPlex是一个开源AI搜索引擎,利用尖端技术提供网络搜索功能。它结合了语义分块、结果重排、谷歌搜索集成以及Groq作为推理引擎等技术,支持Llama 3 70B模型,以提高搜索的准确性和效率。

需求人群:

"目标受众为开发者和技术人员,特别是对搜索引擎技术、AI和机器学习有兴趣的用户。该产品适合他们因为它提供了一个开源平台,可以自定义和扩展搜索功能,同时促进技术交流和创新。"

使用场景示例:

开发者可以使用OpenPerPlex构建自定义的搜索解决方案。

企业可以集成OpenPerPlex到他们的产品中,以提供更智能的搜索服务。

研究人员可以利用OpenPerPlex进行语义分析和搜索算法的研究。

产品特色:

利用Cohere和semantic-chunkers库进行语义分块。

使用JINA API对搜索结果进行重排。

通过serper.dev实现谷歌搜索集成。

使用Groq作为推理引擎。

支持Llama 3 70B模型,提高搜索性能。

提供快速启动指南和环境变量配置说明。

欢迎社区贡献,包括提交问题、分叉仓库和发送拉取请求。

使用教程:

克隆仓库到本地:git clone https://github.com/YassKhazzan/openperplex_backend_os.git

安装所需的Python包:pip install -r requirements.txt

设置环境变量,复制.env_example文件到.env,并填写API密钥。

启动OpenPerPlex服务器:uvicorn main:app --port 8000

访问服务器:http://localhost:8000

浏览量:98

最新流量情况

月访问量

4.93m

平均访问时长

00:06:29

每次访问页数

6.10

跳出率

36.08%

流量来源

直接访问

54.82%

自然搜索

31.76%

邮件

0.04%

外链引荐

11.31%

社交媒体

1.86%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

12.56%

德国

3.93%

印度

9.82%

俄罗斯

5.43%

美国

18.51%

开源AI搜索引擎,提供网络搜索能力。

OpenPerPlex是一个开源AI搜索引擎,利用尖端技术提供网络搜索功能。它结合了语义分块、结果重排、谷歌搜索集成以及Groq作为推理引擎等技术,支持Llama 3 70B模型,以提高搜索的准确性和效率。

免费AI搜索引擎

iAsk.Ai是一款免费的AI搜索引擎,用户可以向AI提问并即时获得准确、详细的答案。它基于先进的自然语言处理模型,经过精心训练,能够客观、准确地回答各类问题,是ChatGPT的优秀替代品。

升级您的默认搜索引擎

使用该插件可以升级您的默认搜索引擎。它可以快速搜索互联网,找到您需要的答案,并告诉您答案的来源。适用于想节省时间、跳过搜索结果混乱的人群。 主要功能包括: - 与Copilot合作的协作AI搜索 - 搭载GPT-4的Perplexity Pro 定价:免费 定位:适用于任何想节省时间并跳过网络搜索混乱的人群。

企业资产搜索引擎

Mirage帮助企业实现更快、更准确的资产搜索引擎。企业使用Mirage帮助他们的用户在无需繁琐的标签、冗长的筛选或无尽的滚动的情况下找到正确的资产。Mirage支持40亿2D资源和1000万3D资源的搜索,使用AI进行搜索优化,提供99.99%的可用性和24/7的高级支持。Mirage由Sequoia支持。

个人文件搜索引擎

PocketLLM是一款个人文件搜索引擎,使用AI和LLM技术,能够记忆数千页的PDF和文档,并提供快速搜索功能。用户可以在自己的设备上进行训练,完全保护隐私,完全免费。用户可以轻松添加、更新或删除模型和文件,并可以通过语义搜索进行全文搜索,搜索整个段落、相似概念或多个主题。

AI工具搜索引擎,快速精准。

Ask AI Tools是一个专注于AI工具的搜索引擎,它旨在帮助用户快速找到所需的人工智能工具。该引擎通过智能算法优化搜索结果,确保用户能够获得最精准的搜索体验。产品背景信息显示,它是由专业的AI技术团队开发,致力于提高用户在AI领域的工作效率。目前,产品处于免费试用阶段,未来可能会推出付费服务。

AI艺术搜索引擎

Enterpix是一款AI艺术搜索引擎,通过Midjourney、DALL·E、Stable-diffusion、NovelAI等模型生成创意艺术作品。用户可以在搜索引擎中浏览并收藏自己喜欢的艺术作品。Enterpix可以帮助用户获取创作灵感。

极简AI搜索引擎,助你快速获取网络信息。

MiniPerplx是一个基于AI的极简搜索引擎,旨在帮助用户快速在互联网上找到所需信息。它使用了OpenAI、Anthropic和Tavily等AI服务提供商的API,通过集成这些技术,MiniPerplx能够提供快速、准确的搜索结果。产品使用TypeScript、CSS和JavaScript等技术栈开发,遵循MIT许可证。

AI艺术图片搜索引擎

Ai Prompt Search是一个AI艺术图片搜索引擎,可以根据Stable Diffusion、ChatGPT、Midjourney等模型搜索数百万张AI艺术图片。它提供了多种热门主题和分类,用户可以通过输入关键词进行搜索,以满足各种创作需求。无论您是需要寻找灵感、收集素材,还是进行商业或个人创作,Ai Prompt Search都能帮助您快速找到适合的AI艺术图片。

搜索引擎为AI助手

FreshFeed是专为GPT和其他LLMs设计的搜索引擎,旨在帮助它们使用最新信息并避免幻觉。它提供最新的数据和知识,以帮助AI助手提供更准确的答案。FreshFeed通过跟踪互联网上的新闻、博客和其他信息源,提供实时的数据和知识。

AI辅助的GPT搜索引擎

GPT Finder是一款基于AI技术的搜索引擎,帮助用户发现和使用OpenAI GPT。它提供智能的搜索和预览功能,让用户可以轻松找到适合自己需求的GPT模型。无论是客户服务、金融分析、教育等领域,都能找到专门的GPT模型。用户只需安装GPT Finder Chrome插件,就可以开始体验高效的AI辅助服务。

隐私保护的搜索引擎

PrivacyWall是一款隐私保护的搜索引擎插件,使用最新的人工智能技术保护您的数据和隐私。它不追踪您的搜索记录,不显示侵入式广告,为您提供安全、自由的搜索体验。插件内置PrivateView功能,可以在不暴露IP地址和个人信息的情况下实时预览网页。我们相信隐私是一项人权,致力于让网络成为一个更安全、更私密的地方。

构建您的AI搜索引擎

Linq是一款超准确的企业级搜索引擎,采用先进的AI技术,确保您始终获得最相关和精准的答案。它还提供直观的GUI,简化复杂数据的组织和检索。您可以快速实现向量搜索,并将多种数据格式整合到一个LLM强化向量搜索中。Linq可以将任何数据转化为可搜索的知识库。

AI搜索引擎,无广告

yoursearch是一款AI搜索引擎,提供无广告的搜索服务。它使用人工智能技术,为用户提供精准、高效的搜索结果,摆脱了传统搜索引擎的无尽滚动和广告干扰。yoursearch还提供精炼的搜索结果摘要,方便用户分享和传播。无论是日常生活还是工作学习,yoursearch都能帮助用户快速找到所需信息。

AI 搜索引擎,保护隐私

You.com 是一款基于人工智能的搜索引擎,提供个性化搜索体验,同时保护用户数据 100% 私密。其多维度界面和水平和垂直滚动功能可以帮助用户在更短的时间内发现更多内容。用户可以通过个性化搜索结果和 150 多个应用程序(如 StackOverflow,Medium 和 Twitter)定制他们的搜索体验。You.com 无追踪和侵入性广告,保护用户的隐私。

全网首个 AI 对话类影视搜索引擎

优酷上线一项全新的 AI 功能 ——AI 搜片,号称全网首个 AI 对话类影视搜索引擎。这款工具拥有强大的搜索功能,不仅覆盖了全网百万级的影视剧实体信息,还融合了万亿条文娱相关知识词条。用户可以通过多轮对话实现模糊搜索、影视问答、剧情检索等功能,无需具象化的问题就能完成。这一功能的推出将大大提升用户在优酷平台上的搜索体验,使影视内容的查找和推荐更加智能化和个性化。

超强AI搜索引擎

AI Keytalk是一款由人工智能驱动的深度搜索和推荐引擎,利用知识图谱和大数据技术,让您快速找到答案。它能理解人类语境,根据搜索意图提供最相关的结果。AI Keytalk可以嵌入现有系统,还支持与ChatGPT等新功能集成。通过AI Keytalk的深度搜索,您可以更好地利用AI提升工作效率。

使用AI技术实现的智能搜索引擎

AI搜索是一个使用先进的AI技术实现的智能搜索引擎。它可以深度理解用户的搜索意图,并提供精准的搜索结果。相比传统搜索引擎,AI搜索具有以下优势:1. 更准确理解搜索意图,满足个性化需求;2. 提供结构化和上下文相关的搜索结果;3. 支持多模态交互,包括语音、图像等;4. 自动分类和提取关键信息,提高搜索效率。AI搜索致力于提供更智能、更高效的搜索体验。

AI搜索引擎,瞬间回答,附带引用

Neeva AI搜索引擎是由AI驱动的,能够瞬间回答你的问题并提供引用,不同于ChatGPT。它不显示广告,确保搜索结果不受定向广告的影响。你可以免费尝试Neeva AI搜索引擎,并选择Neeva的高级套餐,获得更全面的搜索体验。高级套餐包括密码管理器、VPN、新功能的提前访问等。Neeva正在通过为你构建一个专属的搜索引擎来重新定义人们使用网络的方式,而不是面向广告商。要了解更多关于Neeva的信息,请访问www.neeva.com。

AI驱动的AI工具搜索引擎

DiscovAI-search 是一个基于AI技术的搜索引擎,专为AI工具和自定义数据设计。它利用向量搜索技术,将用户查询转换为向量,实现精确的相似性匹配。通过Redis缓存技术,显著提高了重复查询的响应速度。此外,它还拥有一个全面的AI产品数据库,涵盖了不同类别和行业的AI产品。利用大型语言模型(LLM)提供基于搜索结果的详细、上下文感知的答案。界面友好,易于使用,帮助用户高效地发现AI产品。

极速、高度相关的搜索引擎

Meilisearch是一个灵活且强大的用户为中心的搜索引擎,可以轻松添加到任何网站或应用程序中。它以其极速的搜索响应(小于50毫秒)和即插即用的特性(智能预设,零配置启动)著称。Meilisearch还提供了先进的全文搜索引擎,具有出色的相关性,适用于各种用例。此外,它是一个开源项目,拥有一个友好且快速增长的社区。

AI搜索引擎,快速总结今日新闻

World in Last 24 Hours 是一个利用人工智能技术快速总结当天新闻的搜索引擎。它通过视觉化的方式展示信息,帮助用户迅速了解全球最新动态。该产品的主要优点包括信息更新速度快、内容覆盖面广、易于理解和操作。它不仅适用于新闻工作者和研究人员,也适合普通用户快速获取信息。

一个由Together.ai驱动的开源AI搜索引擎。

TurboSeek是一个创新的AI搜索引擎,它通过结合Bing搜索API和先进的大型语言模型(LLMs)如Mixtral 8x7B和Llama-3,为用户提供快速、准确的搜索结果。该搜索引擎的特点是能够理解和处理自然语言查询,返回更加相关和深入的信息。它的重要性在于能够提高用户获取信息的效率,尤其是在需要处理大量数据和复杂查询时。TurboSeek的开发背景是受到Perplexity等先进搜索引擎的启发,旨在为用户提供一个更智能、更高效的搜索工具。目前,该产品是免费使用的,主要面向技术爱好者和需要处理大量信息的用户。

Omnisearch - 全网内容搜索引擎

Omnisearch是一款全网内容搜索引擎,支持搜索各种类型的内容,包括文字、音频、视频、文档和演示文稿等。使用Omnisearch,您可以轻松地搜索和管理您网站上的所有文件,无论其类型如何。借助先进的机器学习技术,Omnisearch能够从各种文件中提取内容,并为您提供最全面、最灵活的搜索体验。无论您是个人用户还是企业用户,Omnisearch都可以帮助您提高工作效率,提供更好的用户体验。

在搜索引擎结果中显示聊天助手响应

这是一个插件,可以在诸如Google、Bing、Yahoo等搜索引擎的结果中显示聊天助手的响应。它支持与ChatGPT进行对话并提供答案,支持使用官方OpenAI API,包括GPT 3.5 Turbo和GPT 4。可以直接从插件弹出窗口访问ChatGPT,支持Markdown渲染、代码高亮和暗黑模式。您可以通过自定义触发模式方便地将内容复制到剪贴板。

© 2026 AIbase 备案号:闽ICP备08105208号-14