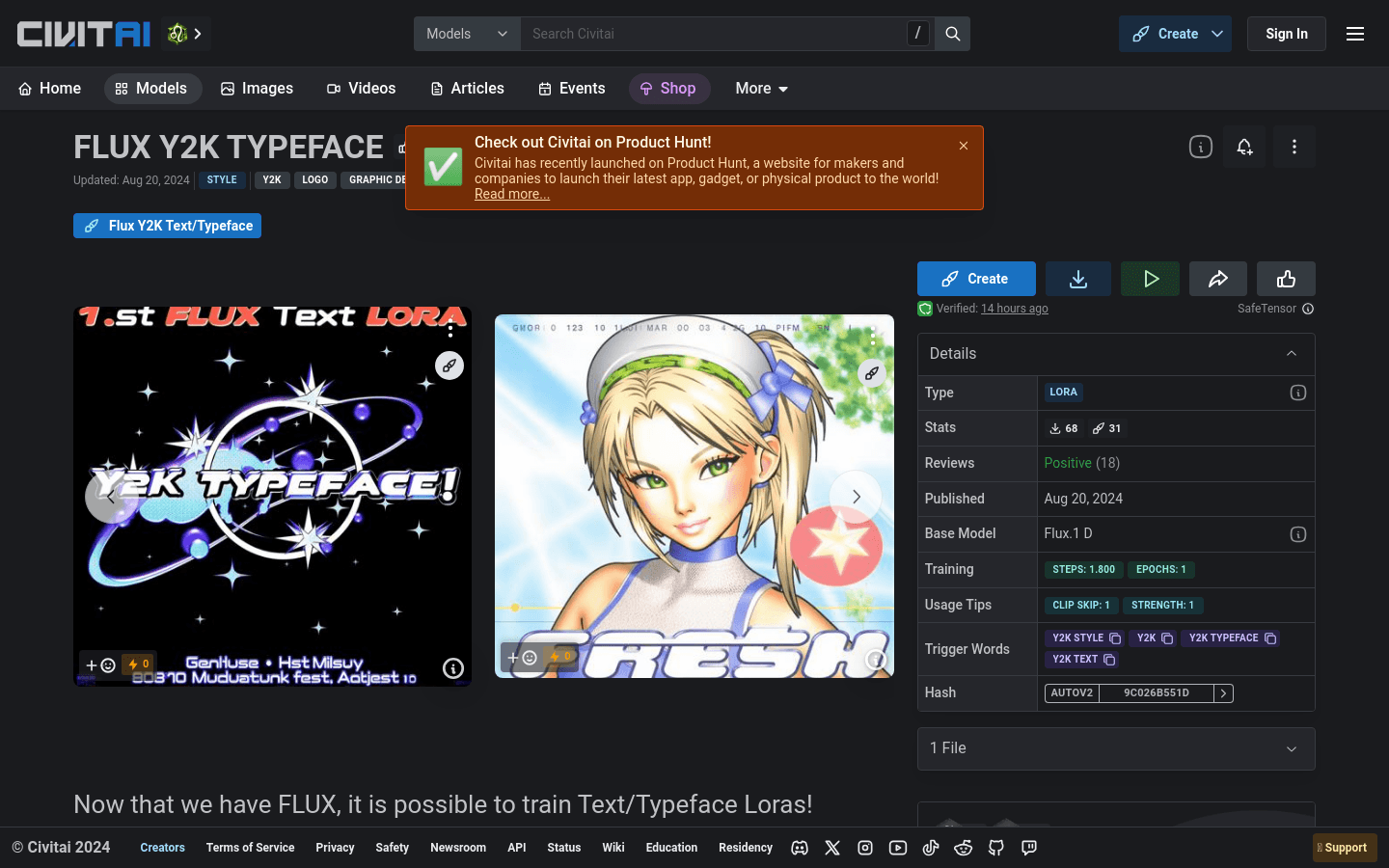

FLUX Y2K TYPEFACE是一个基于LoRA技术的文本/字体生成模型,能够以高精度生成Y2K风格的文本、字体、标志和徽章。该模型由Black Forest Labs, Inc.授权,代表了文本和字体生成技术的新进展,具有高度的创造性和实用性。

需求人群:

"该产品适合平面设计师、品牌设计师和创意工作者,他们需要快速生成具有特定风格的文本和字体设计,以提升工作效率和设计质量。"

使用场景示例:

设计师使用FLUX Y2K TYPEFACE为品牌创建独特的Y2K风格标志。

广告公司利用该模型快速生成符合Y2K风格的广告文案和字体。

创意工作室使用该模型为艺术展览设计具有时代特色的文本和字体。

产品特色:

生成Y2K风格的文本和字体

支持文本和特定字体风格的训练

能够创建高精度的Y2K风格标志和徽章

提供模型训练的详细步骤和参数设置

允许用户根据需要进行模型的Remix

提供详细的使用提示和触发词

使用教程:

1. 访问Civitai网站并找到FLUX Y2K TYPEFACE模型。

2. 阅读模型的详细信息和使用提示。

3. 下载模型文件并确保你的系统满足运行要求。

4. 根据提供的参数设置进行模型训练或Remix。

5. 使用触发词和文本提示生成所需的Y2K风格文本和字体。

6. 根据设计需求调整生成结果,以达到最佳视觉效果。

浏览量:138

最新流量情况

月访问量

18556.07k

平均访问时长

00:13:55

每次访问页数

16.31

跳出率

27.81%

流量来源

直接访问

74.06%

自然搜索

18.39%

邮件

0.03%

外链引荐

5.24%

社交媒体

2.23%

展示广告

0

截止目前所有流量趋势图

地理流量分布情况

中国

5.89%

日本

15.42%

韩国

4.94%

俄罗斯

8.69%

美国

22.10%

Y2K风格的文本/字体生成模型

FLUX Y2K TYPEFACE是一个基于LoRA技术的文本/字体生成模型,能够以高精度生成Y2K风格的文本、字体、标志和徽章。该模型由Black Forest Labs, Inc.授权,代表了文本和字体生成技术的新进展,具有高度的创造性和实用性。

免费在线一键生成受《惊声尖叫》启发、带Y2K风格的Gemini AI鬼面图像

该产品是一款基于Gemini AI的在线图像生成网站,用户可通过输入图像和设定提示词,一键生成带有鬼面元素的Y2K风格图像。其重要性在于为用户提供了一种简单、有趣的方式来创造独特的图像内容。主要优点包括免费使用、操作简单、能生成具备病毒式传播潜力的图像。产品背景是结合了当下流行的AI技术和Y2K复古潮流以及经典恐怖元素鬼面。价格方面,匿名用户每日可获2个免费积分,登录可获取更多。产品定位是面向广大用户,尤其是追求趣味和独特内容的创作者、社交媒体爱好者等。

Scream AI可将个人照片转为带Ghostface效果的Y2K风格恐怖电影海报

Scream AI是一款受《惊声尖叫》电影系列启发的创新照片转换工具,在TikTok上引发热潮。它结合了Y2K怀旧美学与现代恐怖元素,能将普通照片转化为令人毛骨悚然的恐怖电影海报。主要优点包括:使用先进AI技术,生成速度快;具有独特的Y2K恐怖美学;输出适合社交媒体分享;高质量输出可用于打印;保障用户照片隐私安全。该产品定位为满足用户对创意照片转换的需求,让用户轻松参与热门恐怖照片潮流。价格方面未提及是否收费,推测可能有免费使用模式。

人工智能在线设计字体

字体家AI神笔是一个利用人工智能技术实现在线设计字体的网站产品。用户可以通过该网站上传手写样例,AI系统会分析手写风格特点,自动生成出一套独特的字体。该产品具有定制化、智能化、高效率等特点,可以帮助用户快速获取独一无二的字体设计。

轻量级、先进的2B参数文本生成模型。

Gemma 2 2B是谷歌开发的轻量级、先进的文本生成模型,属于Gemma模型家族。该模型基于与Gemini模型相同的研究和技术构建,是一个文本到文本的解码器仅大型语言模型,提供英文版本。Gemma 2 2B模型适用于问答、摘要和推理等多种文本生成任务,其较小的模型尺寸使其能够部署在资源受限的环境中,如笔记本电脑或桌面电脑,促进了对最先进AI模型的访问,并推动了创新。

在线生成芭比风格字体效果的工具

Barbie Font Generator是一个在线工具,允许用户轻松快速地创建芭比风格的字体艺术图像。它非常适合社交媒体帖子、派对邀请函或创意作品。该工具以其标志性的芭比美学而闻名,用户可以自定义字体大小、颜色,并添加阴影、描边或发光效果,以增强文本的视觉效果。Barbie Font Generator完全免费,无需注册即可使用,支持移动设备,提供实时预览,并允许用户将设计以PNG格式下载,适用于数字和打印项目。

Image 2可创建2K精准视觉,支持多语言,风格稳定,助创意成成品

Image 2是一款用于生成AI图像的模型,其重要性在于为创意团队提供了高效、精准的图像生成解决方案。它具有以下优点:能够理解复杂指令,精准呈现2K视觉效果;支持多种语言,满足全球化设计需求;保持风格一致,减少返工;可处理复杂构图和小文本图标。该产品适用于创意团队,帮助他们快速将创意转化为高质量的视觉资产。价格方面提到有50%的折扣,但具体付费模式未详细说明。

Seedream 5.0 AI可根据文本提示生成逼真2K图像,支持多主题合成

Seedream 5.0是一款先进的AI图像生成工具,基于第五代扩散变压器模型。它为创作者、设计师和团队提供专业级图像生成服务,能够在数秒内生成高质量的2K图像。其重要性在于它极大地提高了图像生成的效率和质量,降低了创作门槛。当前有新年促销活动,限时50%折扣。该产品定位为满足各类创作者对于高质量图像生成的需求。

轻量级、先进的文本生成模型

Gemma-2-9b-it是由Google开发的一系列轻量级、最先进的开放模型,基于与Gemini模型相同的研究和技术构建而成。这些模型是文本到文本的解码器仅大型语言模型,以英文提供,适用于问答、摘要和推理等多样化文本生成任务。由于其相对较小的尺寸,可以在资源有限的环境中部署,如笔记本电脑、桌面或个人云基础设施,使先进的AI模型更加普及,促进创新。

更高级的设计字体、图形等

Creative Fabrica 是一个提供高级制作字体、图形和工艺等资源的平台。用户可以获取超过 1 百万种独特的高级设计资源,包括字体、图形、刺绣和工艺等,用于各种创作和设计需求。平台提供多种许可证选项,并提供每日更新的新设计资源。

轻量级、先进的文本生成模型

Gemma是由Google开发的一系列轻量级、先进的开放模型,基于与Gemini模型相同的研究和技术构建。它们是文本到文本的解码器仅大型语言模型,适用于多种文本生成任务,如问答、摘要和推理。Gemma模型的相对较小的尺寸使其能够在资源有限的环境中部署,如笔记本电脑、桌面或您自己的云基础设施,使每个人都能接触到最先进的AI模型,并促进创新。

轻量级、先进的文本生成模型

Gemma 2是Google开发的一系列轻量级、先进的开放模型,基于与Gemini模型相同的研究和技术构建。它们是文本到文本的解码器仅大型语言模型,仅提供英文版本,具有开放的权重,适用于预训练变体和指令调整变体。Gemma模型非常适合各种文本生成任务,包括问答、摘要和推理。其相对较小的体积使其能够部署在资源有限的环境中,如笔记本电脑、桌面或您自己的云基础设施,使先进的AI模型的访问民主化,并帮助为每个人促进创新。

Sora 2 AI可将文本和图像转化为4K分辨率、音画同步的专业视频

Sora 2 AI视频生成器是一款基于先进研究技术的视频生成工具。其重要性在于为内容创作者、营销人员和讲故事的人提供了高效、便捷的视频创作途径。主要优点包括能生成物理精确的多镜头4K视频,音视频完美同步,模型训练先进。产品背景依托于Sora 2的突破性研究。价格方面,有不同套餐:Lite套餐每月14美元(每年120美元);Pro套餐每月35美元(每年300美元);Premium套餐每月159美元(每年1428美元)。定位为满足不同用户群体的视频创作需求,从初学者到专业高产量用户都适用。

文本生成领域的先进模型

H2O Danube3 是由 h2oai 公司开发的一系列文本生成模型,这些模型专注于提供高质量的文本生成服务,广泛应用于聊天机器人、内容创作等领域。它们具备强大的语言理解和生成能力,能够根据给定的上下文生成连贯、准确的文本。

先进的文本生成模型

OLMo-2-1124-13B-SFT是由Allen AI研究所开发的一个大型语言模型,经过在特定数据集上的监督微调,旨在提高在多种任务上的表现,包括聊天、数学问题解答、文本生成等。该模型基于Transformers库和PyTorch框架,支持英文,拥有Apache 2.0的开源许可证,适用于研究和教育用途。

轻量级、先进的开放文本生成模型

Gemma-2-27b是由Google开发的一系列轻量级、先进的开放文本生成模型,基于与Gemini模型相同的研究和技术构建。这些模型专为文本生成任务设计,如问答、摘要和推理。它们相对较小的体积使得即使在资源有限的环境中,如笔记本电脑、桌面或个人云基础设施上也能部署,使先进的AI模型更易于访问,并促进创新。

强大的视频 - 文本生成模型

Twelve Labs 推出的 Pegasus-1 是一款强大的视频 - 文本生成模型,支持生成视频的标题、摘要和自定义文本输出。该模型具有 80B 个参数,相对于先前的视频 - 语言模型,Pegasus-1 在 MSR-VTT 数据集上的表现提升了 61%,在 Video Descriptions 数据集上提升了 47%。用户可以通过 API 调用 Pegasus-1 模型生成视频的文本输出,包括标题、摘要、章节和自定义格式。Pegasus-1 模型充分考虑了视频的视觉、音频和语音信息,相比于现有解决方案,其生成的文本更加全面和准确。

高性能英文文本生成模型

OLMo-2-1124-7B-SFT是由艾伦人工智能研究所(AI2)发布的一个英文文本生成模型,它是OLMo 2 7B模型的监督微调版本,专门针对Tülu 3数据集进行了优化。Tülu 3数据集旨在提供多样化任务的顶尖性能,包括聊天、数学问题解答、GSM8K、IFEval等。该模型的主要优点包括强大的文本生成能力、多样性任务处理能力以及开源的代码和训练细节,使其成为研究和教育领域的有力工具。

Seedance 2.0可快速生成2K画质AI视频,支持多模态输入与编辑。

Seedance 2.0是一款先进的AI视频生成产品。它具有多模态输入能力,允许用户自由组合图像、视频、音频和文本进行创作。主要优点在于能够提供高达2K的电影级画质,支持多镜头叙事,实现自然的动作合成,确保视频中角色和风格的一致性。产品定位为创作者、营销人员和电影制作人提供专业的视频生成解决方案。目前有限时优惠,年度计费可节省50%,价格模式为付费。

由Gempix2和Gemini 3 Pro驱动的专业4K AI图像生成器,注册送2积分。

Nano Banana 2(Gempix2)是一款由Google的Gemini 3 Pro模型驱动的专业AI图像生成与编辑工具。它具备原生4K分辨率输出、强大的文本渲染能力和多图融合功能,能满足不同用户的创作需求。该产品有免费试用机会,注册送2积分,无需信用卡。定价方案分为专业版和旗舰版,专业版每月29.9美元,有500积分;旗舰版每月79.9美元,有1600积分,适合不同规模的创作者和使用者。

大型语言模型,用于文本生成和分类

OLMo-2-1124-7B-RM是由Hugging Face和Allen AI共同开发的一个大型语言模型,专注于文本生成和分类任务。该模型基于7B参数的规模构建,旨在处理多样化的语言任务,包括聊天、数学问题解答、文本分类等。它是基于Tülu 3数据集和偏好数据集训练的奖励模型,用于初始化RLVR训练中的价值模型。OLMo系列模型的发布,旨在推动语言模型的科学研究,通过开放代码、检查点、日志和相关的训练细节,促进了模型的透明度和可访问性。

音乐文本生成

Mustango 是一款基于文本生成音乐的模型,可以根据用户输入的文本提示生成相应的音乐。该模型通过音乐领域的知识进行训练,可以生成高质量且可控的音乐作品。Mustango 支持从简单文本描述到具体音乐要素(如和弦、节拍、速度、调式)的控制,适用于多种场景和应用。

AI生成的图片、文本生成器

AltText.ai是一款利用人工智能自动生成图片Alt文本的工具。它可以集成到WordPress、Shopify、WooCommerce、Chrome和Contentful等平台中,为您的网站提供自动生成的Alt文本。AltText.ai支持超过130种语言,提供WordPress插件、CMS集成、开发者API和网页界面等多种方式使用。

一个免费的在线工具,可生成各种奇特、时尚的字体,适用于社交媒体和设计。

Freaky Font Generator 是一款基于 Unicode 技术的在线字体生成工具,能够快速将普通文本转换为多种奇特、时尚的字体风格。它无需安装或使用 CSS,用户可以直接复制生成的文本并粘贴到任何支持 Unicode 的平台上,如社交媒体、网站等。该工具完全免费,适合需要快速美化文本的用户。

GPT Image 2可秒级生成2K图像,支持文生图、图生图,文字渲染精准。

GPT Image 2是OpenAI推出的首款具备o系列推理能力的图像模型。它能在绘图前进行规划、研究和自我检查,输出高达2K分辨率的图像,支持多语言文字渲染,指令遵循能力优于DALL·E 3。该模型的主要优点包括文字渲染精准、世界知识推理准确、原生支持2K分辨率、单步生成速度快等。用户注册即可获得10个免费积分,无需信用卡,后续使用需购买积分。其定位是为创作者提供高效、精准的图像生成解决方案,满足多种生产工作流程需求。

通过文本生成高质量AI视频

Sora视频生成器是一个可以通过文本生成高质量AI视频的在线网站。用户只需要输入想要生成视频的文本描述,它就可以使用OpenAI的Sora AI模型,转换成逼真的视频。网站还提供了丰富的视频样例,详细的使用指南和定价方案等。

字体识别游戏,挑战你的字体知识

Font Guesser是一个在线互动游戏,旨在通过趣味的方式测试和提升用户对不同字体的识别能力。用户需要根据展示的字体样本猜测其类型,包括Display、Serif、Sans-Serif、Monospace、Handwriting和Decorative等。这个游戏不仅增加了用户对字体的认识,还能提升设计感和审美能力。产品背景信息显示,该游戏由Nitin设计并制作,旨在以趣味的方式教育用户识别和了解不同的字体。目前该游戏是免费的,适合所有对字体设计感兴趣的用户。

Sora 2是AI视频与音频生成平台,可依文本生成带声音的逼真视频

Sora 2是一款基于AI技术的视频与音频生成平台。其重要性在于为视频创作者提供了高效、便捷且高质量的视频创作解决方案。主要优点包括能够生成具有逼真物理效果和同步声音的视频,支持多种分辨率、宽高比和视频时长调整,还具备先进的控制功能。该平台提供免费、入门和专业三种定价方案,定位广泛,适合从初学者到专业人士的各类视频创作者。免费版可用于尝试AI视频生成,入门版适合建立视频内容库的创作者,专业版则为专业人士打造,提供高级功能和商业授权。

© 2026 AIbase 备案号:闽ICP备08105208号-14